O avanço acelerado das técnicas de aprendizado de máquina nas últimas décadas criou um paradoxo curioso: nunca foi tão fácil treinar um modelo sofisticado, mas colocá-lo em produção de forma confiável, escalável e segura continua sendo um dos maiores desafios da engenharia de software moderna. Pesquisas apontam que mais de 85% dos projetos de machine learning nunca chegam a produção, e uma parcela significativa dos que chegam falham por problemas de infraestrutura, não por limitações do modelo em si.

É nesse contexto que o conceito de model serving emerge como disciplina central dentro do universo de MLOps. Servir um modelo significa torná-lo acessível para consumo em tempo real ou em lote, geralmente por meio de uma interface de programação de aplicações (API), de forma que sistemas externos possam enviar dados e receber predições sem precisar conhecer os detalhes internos do modelo.

Este artigo percorre de forma aprofundada todos os aspectos relevantes do model serving: desde os fundamentos conceituais até os frameworks mais utilizados pela indústria, passando por padrões arquiteturais, protocolos de comunicação, estratégias de escalabilidade, monitoramento e segurança. O objetivo é oferecer um guia técnico e ao mesmo tempo acessível para engenheiros de machine learning, arquitetos de software e times de dados que desejam construir pipelines de serving robustos e prontos para produção.

O que é model serving

Model serving, também chamado de model deployment ou inference serving, é o processo pelo qual um modelo de machine learning previamente treinado e validado é disponibilizado para receber entradas de dados e retornar predições em um ambiente de produção. Em termos práticos, é a etapa que transforma um arquivo de modelo, como um arquivo .pkl, .pt ou SavedModel, em um serviço funcional capaz de responder a requisições de outros sistemas.

A distinção entre treinamento e serving é fundamental. Durante o treinamento, o objetivo é ajustar os parâmetros do modelo para minimizar uma função de perda sobre um conjunto de dados históricos. Durante o serving, o modelo já está fixo e o objetivo é executar a inferência, ou seja, aplicar o modelo a novos dados com a menor latência possível, com alta disponibilidade e de forma reproduzível.

Segundo Singh (2021), a exposição de modelos como endpoints REST é a abordagem mais comum para integrar modelos de machine learning a aplicações de negócio existentes, pois permite desacoplar completamente a lógica de inferência do restante do sistema. Isso significa que o modelo pode ser atualizado, substituído ou versionado sem impactar as aplicações consumidoras, desde que o contrato da API seja mantido.

Kolltveit e Li (2022) definem o processo de operacionalização de modelos como a transição de um modelo treinado e avaliado para um estado de serving, onde ele passa a ser acessado tipicamente via REST API ou gRPC. Os autores destacam que esse processo envolve não apenas a exposição técnica do modelo, mas também a gestão de versões, o monitoramento contínuo e a capacidade de rollback em caso de degradação de performance.

Diferença entre inferência e serving

É comum que os termos inferência e serving sejam usados de forma intercambiável, mas há uma distinção importante. A inferência é o ato computacional de passar dados por um modelo para obter uma saída. O serving é o conjunto completo de infraestrutura, processos e padrões que tornam essa inferência acessível, confiável e escalável em produção. O serving engloba a inferência, mas vai muito além dela: inclui gerenciamento de requisições, autenticação, versionamento, logging, monitoramento e recuperação de falhas.

Modalidades de serving

Existem três modalidades principais de model serving, cada uma adequada a diferentes casos de uso:

- Online serving (real-time inference): o modelo responde a requisições individuais com baixíssima latência, geralmente abaixo de 100 milissegundos. É a modalidade usada em sistemas de recomendação em tempo real, detecção de fraudes, assistentes de voz e chatbots.

- Batch serving: o modelo processa grandes volumes de dados de forma assíncrona, sem requisito de latência imediata. É comum em pipelines de ETL com predições, geração de relatórios analíticos e sistemas de scoring periódico.

- Streaming serving: o modelo processa dados em fluxo contínuo, integrando-se a plataformas como Apache Kafka ou Apache Flink. É utilizado em monitoramento de sensores IoT, análise de logs em tempo real e sistemas de alerta.

Model serving no ciclo de MLOps

MLOps, abreviação de Machine Learning Operations, é a disciplina que aplica os princípios de DevOps ao ciclo de vida de modelos de machine learning. O model serving ocupa uma posição central nesse ciclo, sendo o ponto de convergência entre o trabalho dos cientistas de dados e as demandas dos sistemas de produção.

O ciclo típico de MLOps pode ser dividido nas seguintes etapas: coleta e preparação de dados, treinamento e experimentação, avaliação e validação, empacotamento do modelo, serving e monitoramento contínuo. O serving não é uma etapa final e estática; ao contrário, é um processo dinâmico que se retroalimenta com o monitoramento para disparar novos ciclos de retreinamento quando o modelo apresenta degradação de performance.

Islam (sem data) descreve o model serving como o elo crítico entre a experimentação científica e o valor de negócio gerado pelo machine learning. Sem uma infraestrutura de serving robusta, os modelos permanecem como artefatos acadêmicos sem impacto real. O autor destaca que frameworks modernos de serving, como Flask e FastAPI para casos simples, e TensorFlow Serving para cenários de alta demanda, são os pontos de entrada mais comuns para essa transição.

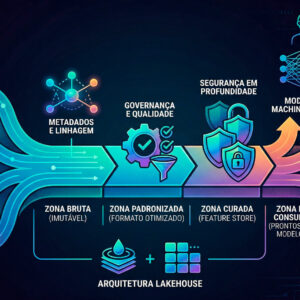

O problema do gap entre treinamento e produção

Um dos desafios mais documentados em MLOps é o chamado training-serving skew, ou desvio entre treinamento e serving. Esse fenômeno ocorre quando os dados que o modelo recebe em produção diferem, em distribuição ou formato, dos dados usados durante o treinamento. As causas são variadas: mudanças no comportamento do usuário, sazonalidade, falhas em pipelines de dados upstream ou simples diferenças na forma como as features são calculadas em tempo de treinamento versus tempo de inferência.

Mitigar esse problema exige que o pipeline de serving inclua as mesmas transformações de pré-processamento aplicadas durante o treinamento, idealmente empacotadas junto com o modelo como um artefato único. Ferramentas como MLflow, BentoML e Seldon Core facilitam esse empacotamento ao permitir que transformadores de dados e o modelo sejam versionados e implantados conjuntamente.

Versionamento de modelos

O versionamento é um pilar fundamental do model serving em produção. Assim como aplicações de software possuem versões que podem ser implantadas e revertidas, modelos de machine learning precisam de mecanismos equivalentes. O TensorFlow Serving, por exemplo, foi projetado desde sua concepção com suporte nativo a múltiplas versões simultâneas de um mesmo modelo, permitindo que novas versões sejam carregadas sem interrupção do serviço e que versões antigas sejam mantidas como fallback.

Olston et al. (2017) descrevem o TensorFlow Serving como um sistema projetado para servir modelos de machine learning dentro do Google, com foco em flexibilidade de plataformas de ML suportadas e integração com pipelines de treinamento para atualização contínua de versões. Os autores destacam que os caminhos críticos de lookup e inferência foram cuidadosamente otimizados para evitar gargalos de performance observados em implementações ingênuas.

Padrões de arquitetura para serving

A escolha da arquitetura de serving tem implicações profundas sobre a escalabilidade, a manutenibilidade e o custo operacional de um sistema de machine learning em produção. Não existe uma solução universal; a arquitetura ideal depende do volume de requisições, dos requisitos de latência, da complexidade do modelo e das capacidades da equipe de engenharia.

Modelo como microsserviço

O padrão mais amplamente adotado é expor o modelo como um microsserviço independente, com sua própria API, ciclo de vida e recursos computacionais. Esse padrão oferece isolamento completo entre o modelo e as demais partes do sistema, facilita o escalonamento independente e permite que diferentes modelos sejam implantados com diferentes configurações de hardware, como CPUs versus GPUs.

Xu (2020) descreve esse padrão como a abordagem dominante para implantação de modelos em produção, citando a exposição do modelo como uma API RESTful em infraestrutura gerenciada na AWS como exemplo concreto. O autor argumenta que o padrão de microsserviço para modelos resolve o problema de acoplamento entre a lógica de negócio e a lógica de inferência, permitindo que cada componente evolua de forma independente.

Modelo embarcado na aplicação

Em cenários onde a latência de rede é crítica ou onde a conectividade é limitada, como em dispositivos de borda (edge devices) e aplicações móveis, o modelo pode ser embarcado diretamente na aplicação. Frameworks como TensorFlow Lite e ONNX Runtime permitem executar modelos otimizados diretamente no dispositivo, eliminando a necessidade de chamadas de rede para um servidor de inferência.

Serving multi-modelo

Em organizações com múltiplos modelos em produção, manter um servidor de inferência separado para cada modelo é ineficiente em termos de recursos. O padrão de serving multi-modelo permite que um único servidor hospede e sirva múltiplos modelos simultaneamente, compartilhando recursos de hardware como memória GPU e CPUs.

Joshi (2024) avaliou frameworks de serving com foco específico em suporte a múltiplos modelos em ambientes de produção reais, comparando TensorFlow Serving, Triton Inference Server, BentoML, TorchServe e FastAPI. O estudo destaca que o suporte a múltiplos modelos é um critério diferenciador importante entre os frameworks, com o Triton Inference Server apresentando as melhores capacidades nesse aspecto.

Padrão de shadow deployment e A/B testing

Antes de promover uma nova versão de modelo para produção completa, é uma prática recomendada validá-la em condições reais sem impactar os usuários. O shadow deployment consiste em enviar cópias das requisições de produção para a nova versão do modelo em paralelo, comparando as predições sem expor os resultados ao usuário final. O A/B testing vai além e divide o tráfego real entre versões, permitindo medir métricas de negócio como taxa de conversão e engajamento.

McCall (2025) descreve como frameworks modernos de serving baseados em Kubernetes, como o KServe, implementam nativamente estratégias de A/B testing e canary deployment, dividindo o tráfego entre diferentes versões de modelo de forma configurável e monitorada.

Protocolos de comunicação: REST e gRPC

A escolha do protocolo de comunicação entre o cliente e o servidor de inferência é uma decisão arquitetural com impacto direto na latência, no throughput e na facilidade de integração. Os dois protocolos dominantes no contexto de model serving são REST (Representational State Transfer) e gRPC (Google Remote Procedure Call).

REST e HTTP/JSON

REST é o protocolo mais amplamente utilizado para exposição de modelos como APIs, principalmente por sua universalidade e facilidade de consumo. Qualquer linguagem de programação e praticamente qualquer ferramenta de desenvolvimento suporta chamadas HTTP, tornando a integração trivial. O formato JSON, usado para serialização dos dados de entrada e saída, é legível por humanos e facilita o debugging.

Gowda e Narayana Gowda (2024) identificam as melhores práticas para design de APIs RESTful com foco em escalabilidade e segurança, destacando a importância de versionamento de endpoints, uso correto de códigos de status HTTP, paginação de respostas, autenticação via tokens JWT e limitação de taxa de requisições (rate limiting) como elementos essenciais para APIs de modelos robustas.

As principais limitações do REST para serving de alta performance são a verbosidade do JSON, que aumenta o tamanho dos payloads, e o overhead do protocolo HTTP/1.1 para requisições de alta frequência. Para casos de uso com centenas de milhares de requisições por segundo, essas limitações podem se tornar gargalos significativos.

gRPC e Protocol Buffers

gRPC é um framework de chamada de procedimento remoto desenvolvido pelo Google que utiliza HTTP/2 como protocolo de transporte e Protocol Buffers (protobuf) como formato de serialização. Em comparação com REST/JSON, o gRPC oferece payloads significativamente menores, suporte nativo a streaming bidirecional e multiplexação de requisições sobre uma única conexão TCP.

No contexto de model serving, o gRPC é especialmente relevante para comunicação entre microsserviços internos, onde a latência é crítica e o overhead de serialização JSON é indesejável. O TensorFlow Serving e o Triton Inference Server suportam ambos os protocolos, permitindo que clientes externos usem REST enquanto a comunicação interna entre componentes usa gRPC.

Critérios de escolha

A decisão entre REST e gRPC deve considerar os seguintes fatores: se a API será consumida por clientes externos e heterogêneos, REST é geralmente a escolha mais prática; se a comunicação é entre serviços internos com requisitos de alta performance, gRPC é superior; se o payload inclui tensores de alta dimensionalidade, como imagens ou embeddings, o gRPC com protobuf reduz significativamente o tamanho dos dados transmitidos.

Principais frameworks de model serving

O ecossistema de ferramentas para model serving cresceu substancialmente nos últimos anos, com opções que variam desde frameworks minimalistas para prototipagem rápida até sistemas de serving industrial projetados para escala de hiperescaladores. A seguir, uma análise aprofundada dos principais frameworks disponíveis.

TensorFlow Serving

O TensorFlow Serving é o sistema de serving de modelos desenvolvido pelo Google, originalmente para uso interno e posteriormente disponibilizado como open source. Ele foi projetado especificamente para servir modelos TensorFlow em produção, com suporte a versionamento automático, carregamento dinâmico de novas versões sem downtime e otimizações de performance nos caminhos críticos de inferência.

Olston et al. (2017) descrevem a arquitetura do TensorFlow Serving como composta por três componentes principais: o Source, responsável por monitorar o sistema de arquivos em busca de novos modelos; o Loader, que gerencia o ciclo de vida dos modelos na memória; e o Manager, que coordena qual versão do modelo deve estar ativa para atender requisições. Essa arquitetura permite atualizações de modelo sem interrupção de serviço, um requisito crítico para sistemas de produção de alta disponibilidade.

A principal limitação do TensorFlow Serving é seu acoplamento ao ecossistema TensorFlow. Embora suporte modelos no formato SavedModel, não é adequado para servir modelos PyTorch nativos sem conversão prévia para um formato intermediário como ONNX.

NVIDIA Triton Inference Server

O Triton Inference Server, desenvolvido pela NVIDIA, é atualmente considerado o framework de serving mais completo e versátil disponível. Ele suporta modelos de múltiplos frameworks, incluindo TensorFlow, PyTorch, ONNX, TensorRT e modelos customizados via backends Python e C++. Sua arquitetura foi projetada para maximizar a utilização de GPUs em ambientes de produção.

Beck et al. (2025), em avaliação publicada na IEEE/ACM International Conference on Software Engineering in Practice, identificaram o Triton como um dos frameworks mais robustos para serving em produção, destacando seu suporte a múltiplos backends, capacidades avançadas de batching dinâmico e integração nativa com o ecossistema NVIDIA para otimização de inferência em GPU.

Brako, Kunkel e Decker (2024) realizaram uma comparação quantitativa e qualitativa entre TensorFlow Serving, TorchServe e Triton Inference Server, concluindo que o Triton apresentou a melhor capacidade de aumentar a throughput de predições sob carga crescente, especialmente em cenários com modelos de visão computacional em GPU.

TorchServe

O TorchServe é o framework de serving oficial para modelos PyTorch, desenvolvido em colaboração entre Meta (Facebook) e AWS. Ele oferece uma interface de gerenciamento de modelos via API REST, suporte a handlers customizados para pré e pós-processamento, e integração com o ecossistema PyTorch, incluindo suporte a TorchScript e modelos exportados via torch.export.

Uma característica distintiva do TorchServe é seu sistema de handlers, que permite encapsular a lógica de pré-processamento, inferência e pós-processamento em um único artefato deployável. Isso facilita a reprodutibilidade e reduz o risco de training-serving skew ao garantir que as mesmas transformações aplicadas durante o treinamento sejam executadas durante a inferência.

BentoML

O BentoML é um framework de serving de código aberto que se diferencia por sua abordagem agnóstica em relação ao framework de machine learning. Ele suporta modelos de scikit-learn, TensorFlow, PyTorch, XGBoost, Hugging Face e outros, empacotando o modelo junto com suas dependências, transformadores de dados e configurações em um artefato chamado Bento.

Joshi (2024) destaca o BentoML como uma das opções mais acessíveis para equipes que precisam de serving multi-framework sem a complexidade operacional do Triton. O framework oferece geração automática de APIs REST e gRPC a partir de definições de serviço em Python, além de integração com plataformas de nuvem para deploy automatizado.

FastAPI como servidor de inferência customizado

Para casos de uso mais simples ou quando se necessita de controle total sobre a lógica da API, o FastAPI emergiu como a escolha preferida para construir servidores de inferência customizados em Python. Sua performance superior ao Flask, suporte nativo a tipagem com Pydantic, geração automática de documentação OpenAPI e suporte a operações assíncronas o tornam adequado para serving de modelos com requisitos moderados de throughput.

Islam descreve o FastAPI como o ponto de entrada mais prático para equipes que estão iniciando sua jornada de model serving, oferecendo uma curva de aprendizado suave e flexibilidade para evoluir a arquitetura conforme as demandas crescem.

KServe e plataformas de serving em Kubernetes

O KServe, anteriormente conhecido como KFServing, é uma plataforma de serving construída sobre Kubernetes que abstrai a complexidade de deployment, escalonamento e monitoramento de modelos. Ele suporta múltiplos runtimes de serving, incluindo TensorFlow Serving, TorchServe e Triton, e oferece funcionalidades avançadas como canary deployments, inferência em pipeline e explainability integrada.

Shaik (2025) descreve a combinação de KServe com Triton Inference Server em Amazon EKS como uma arquitetura de referência para serving de modelos de deep learning em GPU em escala, destacando as capacidades de escalonamento automático baseado em métricas de GPU e a integração com sistemas de monitoramento como Prometheus e Grafana.

Escalabilidade e orquestração com Kubernetes

Escalar um serviço de inferência para atender picos de demanda sem desperdiçar recursos em períodos de baixa utilização é um dos desafios mais complexos do model serving em produção. O Kubernetes tornou-se a plataforma de orquestração de referência para esse problema, oferecendo mecanismos sofisticados de escalonamento horizontal e vertical.

Escalonamento horizontal com HPA

O Horizontal Pod Autoscaler (HPA) do Kubernetes permite que o número de réplicas de um servidor de inferência seja ajustado automaticamente com base em métricas como utilização de CPU, memória ou métricas customizadas como requisições por segundo e latência média. Para servidores de inferência em GPU, o KEDA (Kubernetes Event-Driven Autoscaling) permite escalonamento baseado em métricas de GPU como utilização e memória disponível.

McCall (2025) analisa estratégias de orquestração baseadas em Kubernetes para serving de modelos de IA em escala, destacando que a combinação de HPA com métricas customizadas de inferência permite reduzir custos de infraestrutura em até 40% em comparação com clusters de tamanho fixo, sem impacto na latência do percentil 99.

Serverless inference

Uma alternativa ao serving baseado em contêineres persistentes é o serving serverless, onde instâncias do servidor de inferência são criadas sob demanda e destruídas após um período de inatividade. Plataformas como AWS Lambda, Google Cloud Run e Azure Functions suportam esse modelo, que é especialmente adequado para modelos com tráfego irregular ou baixo volume.

Sousa (2025) avalia o desempenho de infraestrutura serverless com Knative para cargas de trabalho de inferência, concluindo que o modelo serverless oferece vantagens significativas de custo para cargas baixas, mas introduz latência adicional de cold start que pode ser problemática para aplicações com requisitos de latência estrita abaixo de 100 milissegundos.

Service mesh e comunicação entre serviços

Em arquiteturas com múltiplos modelos e serviços de pré-processamento, o uso de um service mesh como Istio ou Linkerd facilita o gerenciamento do tráfego entre componentes, oferecendo funcionalidades como circuit breaking, retry automático, balanceamento de carga sofisticado e observabilidade de tráfego sem modificações no código da aplicação.

Rapôso (2025) destaca em revisão sistemática sobre arquiteturas baseadas em células na nuvem que tecnologias como service mesh são fundamentais para garantir resiliência e escalabilidade seletiva em sistemas distribuídos, princípios diretamente aplicáveis a plataformas de model serving de grande escala.

Batching dinâmico e otimização de inferência

Uma das técnicas mais impactantes para aumentar o throughput de um servidor de inferência sem aumentar proporcionalmente os recursos de hardware é o batching dinâmico. Em vez de processar cada requisição individualmente, o servidor agrupa múltiplas requisições recebidas em um intervalo de tempo curto e as processa como um único batch, aproveitando as capacidades de paralelismo massivo das GPUs modernas.

Como o batching dinâmico funciona

O servidor de inferência mantém uma fila de requisições pendentes e, a cada ciclo de processamento, seleciona um conjunto de requisições para formar um batch. O tamanho do batch e o tempo máximo de espera são parâmetros configuráveis que determinam o equilíbrio entre latência e throughput: batches maiores aumentam o throughput mas também aumentam a latência de cada requisição individual.

Samarasinghe Arachchige (2025) realizou um estudo sistemático sobre estratégias de batching dinâmico para serving eficiente em termos energéticos, utilizando os modelos ResNet50 e MobileNet no Triton Inference Server. O estudo concluiu que configurações agressivas de batching dinâmico podem minimizar o consumo médio de energia e aumentar a utilização de GPU, mas introduzem penalidades de latência especialmente relevantes para modelos leves e cenários de baixo tráfego.

Otimização de modelos para inferência

Além do batching, diversas técnicas de otimização do próprio modelo podem reduzir significativamente a latência e os requisitos de memória durante a inferência:

- Quantização: reduz a precisão dos pesos do modelo de 32 bits para 16 ou 8 bits, diminuindo o uso de memória e acelerando operações de multiplicação de matrizes em hardware compatível.

- Pruning: remove conexões ou neurônios com baixa contribuição para as predições, reduzindo o tamanho e a complexidade computacional do modelo.

- Compilação de modelo: ferramentas como TensorRT da NVIDIA e torch.compile do PyTorch compilam o grafo computacional do modelo para o hardware alvo, gerando código otimizado que pode ser ordens de magnitude mais rápido que a execução interpretada.

- Destilação de conhecimento: treina um modelo menor (estudante) para imitar o comportamento de um modelo maior (professor), resultando em um modelo mais leve e rápido para serving.

Gerenciamento de memória GPU

Em ambientes de serving multi-modelo com GPU compartilhada, o gerenciamento eficiente da memória GPU é crítico. Piao e Kim (2024) propõem o sistema GMM (GPU Memory Management) para serving de múltiplos modelos DNN, demonstrando que uma gestão inteligente da memória GPU permite hospedar significativamente mais modelos simultaneamente em comparação com TorchServe e Triton, sem degradação de performance.

Monitoramento, observabilidade e drift

Um modelo em produção não é um artefato estático. O mundo real muda continuamente, e os dados que o modelo recebe em produção inevitavelmente divergem dos dados de treinamento ao longo do tempo. Sem monitoramento adequado, essa degradação passa despercebida até que cause impactos negativos mensuráveis nos resultados de negócio.

Métricas de infraestrutura

O primeiro nível de monitoramento é o de infraestrutura, que inclui métricas como latência de requisição (média, percentil 95 e percentil 99), throughput (requisições por segundo), taxa de erros, utilização de CPU e GPU, uso de memória e tamanho da fila de requisições. Essas métricas devem ser coletadas continuamente e visualizadas em dashboards, com alertas configurados para anomalias.

A combinação de Prometheus para coleta de métricas e Grafana para visualização tornou-se o padrão de facto para monitoramento de servidores de inferência em Kubernetes. O Triton Inference Server expõe nativamente métricas no formato Prometheus, facilitando a integração com esse stack.

Monitoramento de qualidade do modelo

Além das métricas de infraestrutura, é essencial monitorar a qualidade das predições do modelo ao longo do tempo. Isso inclui o monitoramento de data drift (mudanças na distribuição dos dados de entrada), concept drift (mudanças na relação entre entrada e saída) e métricas de negócio como taxa de acerto, precisão e recall quando labels de ground truth estão disponíveis.

Grilo (2025) descreve em sua plataforma de AutoML um mecanismo de detecção de drift baseado em shadow models que monitora continuamente a distribuição dos dados de entrada e dispara retreinamento automático quando desvios significativos são detectados. Essa abordagem fecha o loop do ciclo de MLOps, transformando o monitoramento em um gatilho para melhoria contínua do modelo.

Logging e rastreabilidade

O logging de requisições e respostas é fundamental tanto para debugging quanto para auditoria e retreinamento. Em sistemas de alta escala, o logging de todas as requisições pode ser inviável em termos de armazenamento; nesses casos, técnicas de amostragem estratificada permitem capturar uma representação estatisticamente significativa do tráfego sem armazenar cada requisição individualmente.

A rastreabilidade distribuída, implementada com ferramentas como Jaeger ou Zipkin, permite acompanhar o caminho de uma requisição através de todos os microsserviços envolvidos no pipeline de inferência, facilitando a identificação de gargalos e a correlação de problemas de latência com componentes específicos.

Segurança e governança de APIs de modelos

APIs de modelos de machine learning em produção são alvos de ataques específicos que não existem em APIs tradicionais. Além das ameaças comuns a qualquer API web, como injeção de dados maliciosos e ataques de negação de serviço, APIs de modelos enfrentam riscos únicos como ataques adversariais, extração de modelo e inferência de dados de treinamento.

Autenticação e autorização

Toda API de modelo em produção deve implementar autenticação robusta. O padrão mais comum é o uso de tokens JWT (JSON Web Tokens) para autenticação stateless, combinado com OAuth 2.0 para autorização baseada em escopos. Em ambientes corporativos, a integração com sistemas de identidade como Azure Active Directory ou AWS IAM é frequentemente necessária.

Gowda e Narayana Gowda (2024) enfatizam que a segurança de APIs RESTful vai além da autenticação e inclui validação rigorosa de inputs, sanitização de dados, uso de HTTPS com TLS 1.3, implementação de rate limiting para prevenir abusos e cabeçalhos de segurança HTTP como Content Security Policy e X-Frame-Options.

Rate limiting e proteção contra abuso

O rate limiting é especialmente importante para APIs de modelos porque a inferência é computacionalmente cara. Sem limitação de taxa, um único cliente malicioso ou com bug pode consumir todos os recursos do servidor, causando degradação de serviço para outros clientes. O rate limiting deve ser implementado em múltiplos níveis: por cliente, por endpoint e globalmente.

Ataques adversariais e robustez do modelo

Ataques adversariais consistem em modificações sutis nos dados de entrada, imperceptíveis para humanos, que causam predições incorretas no modelo. Em aplicações críticas como detecção de fraudes, diagnóstico médico e veículos autônomos, a robustez contra ataques adversariais é um requisito de segurança, não apenas de qualidade.

Mitigações incluem validação de schema rigorosa dos inputs, detecção de anomalias na distribuição dos dados de entrada antes de passá-los ao modelo, e técnicas de treinamento adversarial que tornam o modelo intrinsecamente mais robusto a perturbações.

Privacidade e conformidade

APIs de modelos que processam dados pessoais estão sujeitas a regulamentações como LGPD no Brasil, GDPR na Europa e CCPA nos Estados Unidos. Isso implica requisitos de minimização de dados (não logar mais informações do que o necessário), direito ao esquecimento (capacidade de remover dados de treinamento e retreinar o modelo), e explicabilidade das predições para decisões automatizadas que afetam indivíduos.

Boas práticas consolidadas

A partir da literatura científica e da experiência acumulada da indústria, é possível consolidar um conjunto de boas práticas que distinguem um sistema de model serving robusto de uma implementação frágil. Essas práticas não são opcionais em sistemas de produção de alta criticidade; são requisitos fundamentais.

Contrato de API estável e versionado

A API do modelo deve ter um contrato claro e estável, documentado em formato OpenAPI/Swagger, com versionamento explícito nos endpoints. Mudanças incompatíveis com versões anteriores devem sempre resultar em uma nova versão da API, nunca em modificação silenciosa da versão existente. Isso protege os consumidores da API de quebras inesperadas.

Validação de inputs e outputs

Todo dado que entra no servidor de inferência deve ser validado contra um schema definido antes de ser passado ao modelo. Isso inclui verificação de tipos, ranges válidos, ausência de valores nulos em campos obrigatórios e consistência entre features. Da mesma forma, os outputs do modelo devem ser validados antes de serem retornados ao cliente, detectando predições anômalas que podem indicar problemas no modelo ou nos dados.

Circuit breaker e graceful degradation

Em sistemas distribuídos, falhas são inevitáveis. O padrão de circuit breaker previne que falhas em cascata derrubem todo o sistema ao detectar quando um serviço downstream está falhando e interromper temporariamente as chamadas a ele, retornando uma resposta de fallback. Para APIs de modelos, o fallback pode ser uma predição padrão, um modelo mais simples e robusto, ou uma mensagem de erro informativa.

Testes de carga e chaos engineering

Antes de colocar um servidor de inferência em produção, é essencial realizar testes de carga para identificar o ponto de saturação do sistema e validar que os mecanismos de escalonamento automático funcionam conforme esperado. Ferramentas como Locust, k6 e Apache JMeter são comumente usadas para esse fim. O chaos engineering, popularizado pela Netflix com o Chaos Monkey, vai além e introduz falhas intencionais em produção para validar a resiliência do sistema.

Documentação e contratos de SLA

Toda API de modelo em produção deve ter documentação clara sobre seus requisitos de input, formato de output, latência esperada (SLA), disponibilidade garantida (SLO) e procedimentos de escalação em caso de incidentes. Contratos de nível de serviço (SLAs) formalizados com os times consumidores criam responsabilidade e facilitam o planejamento de capacidade.

Pipeline de CI/CD para modelos

Assim como código de software, modelos de machine learning devem passar por um pipeline de integração e entrega contínua antes de chegar a produção. Esse pipeline inclui testes automatizados de qualidade do modelo em datasets de validação, testes de regressão para garantir que a nova versão não degrada métricas existentes, testes de performance para validar latência e throughput, e aprovação automática ou manual antes do deploy em produção.

O model serving representa a fronteira entre a ciência de dados e a engenharia de software, exigindo competências profundas em ambas as disciplinas. Expor um modelo de machine learning como uma API robusta não é uma tarefa trivial; é um problema de engenharia complexo que envolve escolhas arquiteturais, otimização de performance, gestão de infraestrutura, segurança e monitoramento contínuo.

A boa notícia é que o ecossistema de ferramentas para model serving amadureceu enormemente nos últimos anos. Frameworks como TensorFlow Serving, Triton Inference Server, TorchServe e BentoML resolvem grande parte dos problemas de infraestrutura de baixo nível, permitindo que as equipes foquem em aspectos de mais alto valor como a qualidade do modelo, a experiência do usuário e a integração com sistemas de negócio.

O caminho para um sistema de model serving verdadeiramente robusto passa pela adoção de princípios de MLOps, pelo investimento em observabilidade e monitoramento, pela implementação de práticas de segurança desde o início e pela construção de pipelines de CI/CD que automatizem a validação e o deploy de novas versões de modelos. Organizações que dominam essas práticas transformam o machine learning de uma capacidade experimental em uma vantagem competitiva sustentável.

À medida que modelos de linguagem de grande porte (LLMs) e sistemas de IA multimodal se tornam cada vez mais presentes em produção, os desafios de serving se intensificam: modelos maiores, requisitos de hardware mais exigentes, latências mais longas e custos operacionais mais elevados. As fundações descritas neste artigo, no entanto, permanecem válidas e essenciais independentemente da escala ou da complexidade do modelo servido.

Fontes

- Olston, C., Fiedel, N., Gorovoy, K., Harmsen, J., Lao, L., Li, F., Rajashekhar, V., Ramesh, S., Soyke, J. (2017).

TensorFlow-Serving: Flexible, High-Performance ML Serving.

arXiv preprint arXiv:1712.06139. Apresentado no NIPS 2017 Workshop on ML Systems.

Disponível em: https://arxiv.org/abs/1712.06139 - Xu, R. (2020).

A design pattern for deploying machine learning models to production.

California State University. ScholarWorks.

Disponível em: https://scholarworks.calstate.edu/downloads/1v53k296v - Kolltveit, A. B., Li, J. (2022).

Operationalizing machine learning models: A systematic literature review.

Proceedings of the 1st Workshop on Software Engineering for Responsible AI. ACM Digital Library.

Disponível em: https://dl.acm.org/doi/abs/10.1145/3526073.3527584 - Joshi, D. (2024).

Evaluation of Model Serving Frameworks for Machine Learning.

HAW Hamburg Repository.

Disponível em: https://reposit.haw-hamburg.de/handle/20.500.12738/18245 - Beck, N., Stein, B. J., Helmer, L., et al. (2025).

Evaluation of Tools and Frameworks for Machine Learning Model Serving.

2025 IEEE/ACM 47th International Conference on Software Engineering in Practice (ICSE-SEIP). IEEE Xplore.

Disponível em: https://ieeexplore.ieee.org/abstract/document/11121713/ - Brako, E., Kunkel, J., Decker, J. (2024).

A Quantitative and Qualitative Comparison of Machine Learning Inference Frameworks.

SCALABILITY 2024 Conference Proceedings.

Disponível em: https://personales.upv.es/thinkmind/dl/conferences/scalability/scalability_2024/scalability_2024_1_20_20010.pdf - Samarasinghe Arachchige, S. (2025).

Evaluating Dynamic Batching Strategies for Energy-Efficient Inference Serving: A Performance Study.

Aalto University, School of Electrical Engineering. Master’s Thesis.

Disponível em: https://aaltodoc.aalto.fi/items/1c789253-5579-40a5-945f-cac09770b5f5 - Shaik, B. (2025).

Productionizing GPU Inference on EKS with KServe and NVIDIA Triton.

American International Journal of Computer Science and Technology (AIJCST).

Disponível em: https://aijcst.org/index.php/aijcst/article/view/123 - McCall, A. (2025).

AI Model Serving at Scale: Kubernetes-Based Orchestration and Optimization for High-Performance Inference.

ResearchGate.

Disponível em: https://www.researchgate.net/publication/390701823 - Piao, X. Y., Kim, J. K. (2024).

GMM: An Efficient GPU Memory Management-Based Model Serving System for Multiple DNN Inference Models.

Proceedings of the 53rd International Conference on Parallel Processing. ACM Digital Library.

Disponível em: https://dl.acm.org/doi/abs/10.1145/3673038.3673122 - Singh, P. (2021).

Deploy Machine Learning Models to Production.

Springer, Cham, Switzerland.

Disponível em: https://link.springer.com/content/pdf/10.1007/978-1-4842-6546-8.pdf - Gowda, P., Narayana Gowda, A. (2024).

Best Practices in REST API Design for Enhanced Scalability and Security.

Journal of Artificial Intelligence, Machine Learning and Data Science.

ResearchGate. - Grilo, J. G. L. (2025).

Desenvolvimento de uma plataforma de AutoML.

Universidade do Porto. ProQuest Dissertations and Theses.

Disponível em: https://search.proquest.com/openview/f01a459288eda13fc65cde4879d886d4/1 - Sousa, A. C. (2025).

Avaliação de desempenho de infraestrutura serverless.

Universidade Federal de Sergipe. Mestrado em Ciência da Computação.

Disponível em: https://ri.ufs.br/jspui/handle/riufs/23080 - Rapôso, C. F. L. (2025).

Arquitetura Celular na Computação em Nuvem: Uma Revisão Sistemática Sobre Resiliência, Escalabilidade e Tendências Emergentes.

Revista Tópicos, v. 3, n. 23. DOI: 10.5281/zenodo.16474011.

Disponível em: https://revistatopicos.com.br/artigos/arquitetura-celular-na-computacao-em-nuvem - Islam, M. J. (sem data).

Machine Learning Model Serving Patterns and Best Practices.

Sciendo / Packt Publishing.

Disponível em: https://sciendo.com/chapter/9781803242538

“`