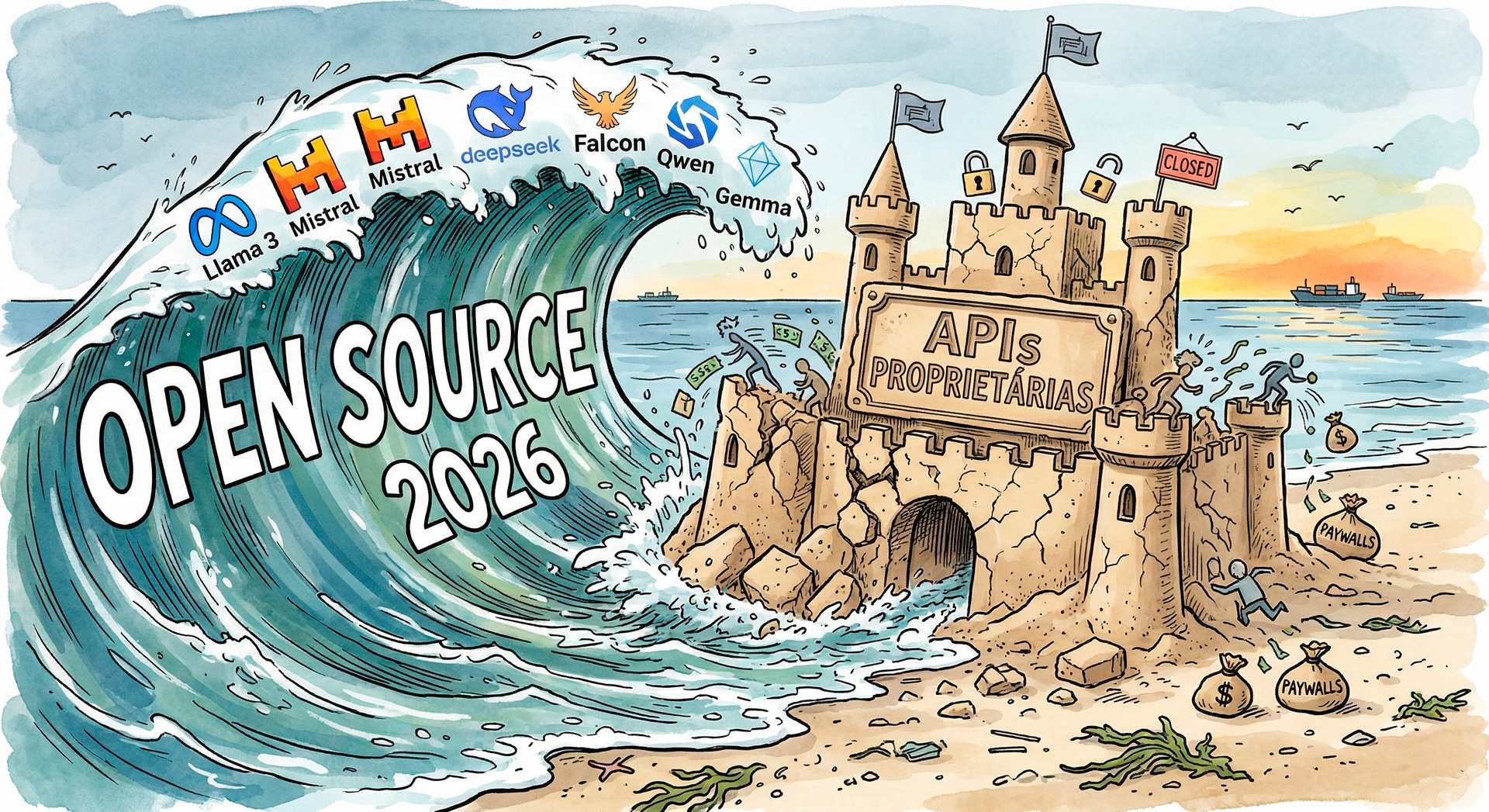

O jogo mudou — E mudou rápido

Dois anos atrás, falar de IA open source para empresas soava como falar de Linux em 1998: promissor, mas arriscado. Hoje, mais de 60% de todos os novos deployments de IA empresarial lançados no Q4 de 2025 e Q1 de 2026 usam modelos e frameworks open source. Modelos fechados como GPT-4 ainda têm seus fiéis, mas o paradigma se inverteu — o ônus da prova agora está do lado proprietário.

O catalisador foi a chegada de novos players que desafiaram verdades assumidas: que você precisa de bilhões de dólares para treinar um modelo competitivo, que modelos open source são sempre inferiores, e que eficiência e inteligência são opostos. DeepSeek, Qwen e Gemma destruíram esses três mitos ao mesmo tempo.

A questão para empresas, portanto, não é mais “se” usar open source. É “qual” — e essa pergunta ficou muito mais complexa e muito mais interessante.

Os seis protagonistas de 2026

1. Meta Llama 3.3 / 4 — O Ecossistema imbatível

O Llama continua sendo o modelo com a maior comunidade do mundo e o ecossistema mais maduro de ferramentas, adapters e integrações. O Llama 3.3 70B atingiu performance equivalente ao GPT-4 em muitas tarefas, consolidando dois anos de desenvolvimento acelerado. Em 2025, a Meta lançou o Llama 4 com arquitetura Mixture of Experts e variantes Scout e Maverick — embora os primeiros testes tenham sinalizado inconsistências em raciocínio comparado ao 3.3, gerando um ciclo de updates emergenciais.

O Llama roda em infraestrutura completamente on-premise, com suporte nativo em Ollama, vLLM, HuggingFace TGI e praticamente qualquer framework relevante. Para empresas que precisam de soberania total de dados — saúde, finanças, defesa — ele continua sendo a referência de ecossistema.

Casos de uso ideais:

- Plataformas de saúde digital com RAG sobre prontuários (os dados nunca saem do servidor hospitalar)

- Assistente jurídico interno que lê contratos e legislação proprietária

- Motores de busca semântica sobre bases de conhecimento corporativas extensas

- Chatbot de suporte técnico em empresas de infraestrutura e TI

- Sistemas de compliance financeiro com auditoria de documentos regulatórios

Ideias de projetos concretos:

- Motor de Q&A sobre documentos internos (RAG + Llama 70B on-premise)

- Gerador de relatórios de análise médica a partir de dados estruturados

- Sistema de resumo automático de atas e documentos jurídicos

- Plataforma de onboarding inteligente para novos funcionários

2. Mistral AI — A soberania europeia com Apache 2.0

A Mistral francesa consolidou uma família completa de 10 modelos open source, todos sob licença Apache 2.0, cobrindo desde dispositivos de borda até deployments enterprise em cloud. Sua arquitetura MoE no Mixtral reduz o custo de inferência em até 60% comparado a modelos densos equivalentes. Para empresas com exigências de compliance europeu — GDPR em primeiro lugar — a Mistral é a escolha natural como fornecedor europeu.

O diferencial competitivo da Mistral não é apenas técnico: é filosófico. A empresa foi fundada com manifesto explícito contra vendor lock-in. Você pode hospedar, modificar, vender e derivar produtos sem pedir permissão a ninguém — algo que nenhum modelo da OpenAI, Google ou Anthropic permite.

Casos de uso ideais:

- Customer support multilíngue para e-commerce com alto volume de tickets

- Geração de conteúdo (SEO, copy, artigos técnicos) com fine-tuning de tom de voz

- Assistentes de código para times de desenvolvimento — geração, revisão e documentação

- Sistemas de triagem automática de e-mails e chamados de suporte

- Chatbots para portais de governo e prefeituras dentro da UE

Ideias de projetos concretos:

- API de geração de conteúdo fine-tunada para a voz editorial de uma marca

- Bot de suporte em SaaS B2B com integração a CRM (Mistral 7B + function calling)

- Sistema de geração automática de briefings semanais a partir de relatórios internos

- Assistente de produtividade para times de marketing — pauta, copy e revisão em loop

- Motor de extração de informações de notas fiscais e documentos fiscais (fine-tuning LoRA leve)

3. Falcon 2 (TII) — O velocista de hardware único

Desenvolvido pelo Technology Innovation Institute de Abu Dhabi, o Falcon 2 11B roda eficientemente em uma única GPU, tem suporte multimodal nativo (visão + linguagem) desde o lançamento, e foi construído com pipeline de dados completamente próprio — sem derivar do Llama. Para latência mínima e hardware modesto, é uma escolha sólida com custo operacional baixo.

O Falcon 2 se diferencia também por sua arquitetura de dados: o TII construiu o RefinedWeb, um dos pipelines de curadoria de dados mais rigorosos do setor, o que resulta em um modelo com menos ruído e viés em tarefas factuais — uma vantagem silenciosa que raramente aparece em benchmarks, mas aparece no mundo real.

Casos de uso ideais:

- Bots de atendimento multi-tenant em plataformas com milhares de usuários simultâneos

- Análise de imagens industriais em tempo real (Falcon 2 VLM — identifica defeitos visuais em linha de produção)

- Sistemas embarcados em kiosques, terminais e dispositivos de ponto de venda

- Assistentes de campo para técnicos que trabalham offline ou com conectividade limitada

- Classificação e roteamento automático de tickets em centrais de atendimento

Ideias de projetos concretos:

- Sistema de inspeção visual de qualidade em fábrica com câmera + Falcon 2 VLM

- Kiosk de autoatendimento em varejo físico (hardware modesto, resposta em menos de 200ms)

- App mobile de suporte técnico com modelo rodando localmente no dispositivo

- Monitor de ativos industriais que descreve imagens capturadas por sensores IoT

4. DeepSeek R1 / V3 — O terremoto chinês do raciocínio

Janeiro de 2025: uma startup chinesa publica os pesos de um modelo com 671 bilhões de parâmetros (MoE, ativando ~37B na inferência) e afirma custo de treinamento de $5,6 milhões — quando equivalentes americanos custaram centenas de milhões. O R1 demonstrou performance equivalente ao o1 da OpenAI em benchmarks de raciocínio, com custo de API 90–95% menor. Usa licença MIT — a mais permissiva do mercado.

O DeepSeek foi pré-treinado em 14,8 trilhões de tokens usando 2,788 milhões de horas de GPU. Para raciocínio profundo em cadeia — análise de múltiplas variáveis, debugging complexo, modelagem matemática — o DeepSeek R1 é o modelo open source de raciocínio mais poderoso disponível hoje.

⚠️ Atenção enterprise: Para dados sensíveis, use os pesos on-premise — isso elimina qualquer preocupação com envio de dados para servidores externos chineses.

Casos de uso ideais:

- Detecção de fraude financeira — análise de padrões complexos em séries de transações

- Revisão de contratos jurídicos com identificação de cláusulas de risco

- Customer service avançado para telecomunicações: diagnostica falhas cruzando dados técnicos e histórico do cliente

- Suporte de nível 2/3 em helpdesk — questões que exigem raciocínio em múltiplas etapas

- Assistentes para quants em fundos de investimento — debugging de modelos e análise de relatórios

Ideias de projetos concretos:

- Motor de análise de risco de crédito com raciocínio explicável (output estruturado + CoT)

- Sistema de auditoria de código fonte para identificar vulnerabilidades de segurança

- Plataforma de análise de editais e licitações governamentais com mapeamento de riscos

- Agente de pesquisa autônoma que lê artigos científicos, cruza dados e gera sínteses

- Dashboard inteligente de análise de demonstrações financeiras para escritórios contábeis

5. Qwen3 (Alibaba) — O multilingual com Hybrid Thinking

O Alibaba lançou o Qwen3 em 2025 como a família open source mais versátil: modelos de 0,6B a 235B (MoE, ~22B ativos na inferência), licença Apache 2.0, suporte a 119 idiomas e um Hybrid Thinking Mode que alterna entre raciocínio profundo e respostas rápidas conforme a complexidade da tarefa. A versão Qwen3-235B-A22B-2507 superou o DeepSeek-R1 em 17 de 23 benchmarks em julho de 2025.

O Qwen3-Coder-480B-A35B é especialmente potente para desenvolvimento de software — geração de código em múltiplas linguagens, debugging e refatoração em escala. O Hybrid Thinking Mode é uma inovação real: em vez de sempre “pensar devagar” (como o R1) ou sempre “responder rápido” (como o Mistral), o Qwen3 decide dinamicamente qual modo usar — economizando tokens e latência em questões simples sem sacrificar profundidade nas complexas.

Casos de uso ideais:

- Plataformas de educação com tutores inteligentes de matemática, ciências e programação

- Aplicações globais que precisam servir usuários em português, inglês, árabe, mandarim, espanhol e mais 114 idiomas com a mesma qualidade

- Assistentes médicos de pesquisa — resumo de artigos científicos, explicação de guidelines clínicos

- Desenvolvimento acelerado de software em times que precisam de copilot poderoso sem custo de API proprietária

- Simulações e cálculos científicos — o Qwen3-Coder gera código de simulação complexa

Ideias de projetos concretos:

- Plataforma de tutor de matemática e vestibular com IA (Qwen3-72B fine-tunado em currículo brasileiro)

- Sistema de atendimento ao paciente em clínicas com suporte em múltiplos idiomas (imigrantes, turistas)

- Copilot de código para times de desenvolvimento interno — review, geração de testes e documentação

- Ferramenta de tradução e localização inteligente para produtos SaaS entrando em mercados globais

- Agente de pesquisa científica para equipes de R&D em farmacêuticas e biotechs

6. Gemma 3 (Google) — O gigante discreto

Lançado em março de 2025, o Gemma 3 é construído com a mesma tecnologia do Gemini 2.0 — disponibilizado como open-weight. Em 4 tamanhos (1B, 4B, 12B e 27B), o Gemma 3 27B numa única GPU superou Llama 3 405B, DeepSeek-V3 e o3-mini nas avaliações de preferência humana do LMArena. Um destaque especial é o MedGemma — variante especializada para aplicações médicas que lê raios-X e interpreta dados clínicos.

Google investiu em otimizações diretas com NVIDIA para GPUs (da Jetson Nano até os chips Blackwell), AMD via ROCm e TPUs do Google Cloud. Fine-tuning com LoRA, PyTorch, JAX e Keras é suportado nativamente. Para empresas que já têm infraestrutura GCP, o Gemma 3 tem integração nativa com Vertex AI — reduzindo o atrito de deployment para perto de zero.

Casos de uso ideais:

- Aplicações mobile e embarcadas — o Gemma 3 1B e 4B rodam em smartphones

- Telemedicina e saúde digital — MedGemma analisa imagens médicas e oferece suporte a diagnóstico

- Empresas com stack GCP — deployment zero-atrito no Vertex AI com créditos existentes

- Assistentes de voz e interfaces conversacionais com baixa latência

- Análise multimodal de documentos — textos + imagens em um único pipeline

Ideias de projetos concretos:

- App de saúde preventiva que analisa fotos de exames laboratoriais e explica resultados (MedGemma)

- Assistente de acessibilidade para apps mobile que descreve imagens para deficientes visuais

- Sistema de análise de currículos com comparação visual de documentos (texto + layout)

- Motor de moderação de conteúdo multimodal para redes sociais e fóruns

- Plataforma de teleorientação médica com triagem inteligente antes da consulta

Hardware: O orçamento real de cada modelo

A decisão de hardware é onde projetos morrem silenciosamente. Você escolhe o modelo certo para o problema mas errado para sua infra — e três meses depois ainda está tentando rodar o primeiro fine-tuning.

| Categoria / Modelos | GPU / VRAM | RAM Mínima | Valor Est. (Hardware) |

|---|---|---|---|

| Edge / Mobile Gemma 3 1B, Qwen3 0.6B | CPU-only ou iGPU (Apple M2/M3, Snapdragon 8 Gen 5) | 8GB – 16GB | R$ 4.000 – R$ 8.000 (Smartphone/Laptop) |

| Prosumer Base Mistral 7B, Llama 3 8B | NVIDIA RTX 3060 / 4060 (8GB – 12GB VRAM) | 32GB DDR5 | R$ 2.200 – R$ 3.500 (Apenas GPU) |

| High-End Desktop Gemma 3 27B, Qwen3 32B, Mixtral 8x7B | RTX 3090 / 4090 / 5080 (24GB VRAM) | 64GB DDR5 | R$ 12.000 – R$ 18.000 (Apenas GPU) |

| Workstation / Multi-GPU Llama 3.3 70B, DeepSeek R1 (70B) | RTX A6000 ou 2x RTX 3090/4090 (48GB VRAM) | 128GB DDR5 | R$ 35.000 – R$ 55.000 (Sistema Completo) |

| Enterprise / Cluster DeepSeek V3, Qwen3 235B (Full MoE) | Cluster 8x H100 / A100 (640GB+ VRAM) | 512GB – 1TB ECC | Acima de R$ 1.500.000 (Infraestrutura) |

A arquitetura MoE do DeepSeek V3 e do Qwen3-235B é crucial aqui: apesar de terem centenas de bilhões de parâmetros totais, eles ativam apenas uma fração na inferência — reduzindo VRAM efetiva necessária em até 70% comparado a modelos densos equivalentes.

Custo de Fine-Tuning por plataforma

Fine-tuning gerenciado via plataformas como Together AI, Fireworks e serviços oficiais de cada empresa:

| Modelo / Família | Plataforma Principal | Custo Estimado ($/M Tokens) | Perfil de Uso / Vantagem |

|---|---|---|---|

| Mistral 7B (v3/v4) | Together AI / Fireworks | $0.45 – $0.80 | Alta Performance e Eficiência |

| Llama 3.1 8B | Together / Fireworks | ~$0.50 | Padrão de Mercado (Open Source) |

| Llama 3.1 70B | AWS Bedrock / Together | $2.90 – $3.20 | Raciocínio Complexo (Enterprise) |

| DeepSeek (Distilled) | DeepSeek API / SiliconFlow | $0.05 – $0.15 | Custo Disruptivo (Low-Cost) |

| Qwen3 (7B – 32B) | DashScope / Together | $0.35 – $0.90 | Multilíngue e Programação |

| Gemma 3 (Native) | Google Vertex AI | $0.30 – $1.20 | Integração Nativa Google Cloud |

Licenças: A armadilha invisível

| Modelo | Licença | Restrição Comercial |

|---|---|---|

| Mistral (toda família) | Apache 2.0 | Nenhuma |

| Qwen3 (Alibaba) | Apache 2.0 | Nenhuma |

| DeepSeek V3/R1 | MIT License | Nenhuma (mais permissiva do mercado) |

| Gemma 3 (Google) | Gemma Terms of Use | Proibido usar para treinar outros LLMs |

| Llama 3/4 (Meta) | Meta Llama License | Restrição para empresas com mais de 700M MAU |

| Falcon 2 (TII) | Falcon LLM License | Comercial permitido |

A grande tabela de decisão empresarial

| Critério | Llama 3.3/4 | Mistral | Falcon 2 | DeepSeek R1/V3 | Qwen3 | Gemma 3 |

|---|---|---|---|---|---|---|

| Origem | Meta (EUA) | França | UAE | China | China | Google (EUA) |

| Melhor para | On-premise, soberania de dados, RAG | Eficiência, GDPR, SaaS | Edge/IoT, latência mínima | Raciocínio profundo, finanças, jurídico | Multilingual, educação, código | Mobile, saúde, 1 GPU |

| Projetos típicos | Saúde, fintech, defesa | Chatbots, conteúdo, e-commerce | Indústria, kiosks, IoT | Análise de risco, auditoria, quant | EdTechs, global SaaS, R&D | Telemedicina, apps mobile, moderação |

| Tamanho flagship | 70B / 405B | 7B–22B (MoE) | 11B | 671B MoE (~37B ativo) | 235B MoE (~22B ativo) | 27B |

| GPU mínima viável | RTX 3060 (8B) | RTX 3060 (7B) | 1 GPU qualquer | RTX 3090 (distil 32B) | RTX 3060 (8B) | RTX 3060 (12B) |

| Licença | Meta License | Apache 2.0 ✅ | Falcon License | MIT ✅ (irrestrita) | Apache 2.0 ✅ | Gemma ToU* |

| Fine-tuning custo | $0,50–$3,00/M tk | $0,48–$2,00/M tk | Menor cobertura gerenciada | 90% abaixo GPT-4 | Competitivo | Via GCP |

| Ecossistema | 🥇 Maior do mundo | 🥈 Muito maduro | 🥉 Menor | 🥈 Crescendo rápido | 🥈 Sólido | 🥈 Google-backed |

| Raciocínio | ⭐⭐⭐⭐ | ⭐⭐⭐½ | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| Eficiência hardware | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ (MoE) | ⭐⭐⭐⭐⭐ (MoE) | ⭐⭐⭐⭐⭐ |

| Multilingual | ⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ (119 idiomas) | ⭐⭐⭐⭐ |

| Multimodal | ✅ Llama 4 | ❌ Limitado | ✅ Falcon 2 VLM | ✅ V3.1+ | ✅ Qwen-VL | ✅ MedGemma |

| PRO principal | Ecossistema imbatível + comunidade | Apache 2.0 + GDPR + eficiência | 1 GPU + velocidade de inferência | Raciocínio nível o1 com MIT License | Hybrid thinking + 119 idiomas | Desempenho/parâmetro + saúde (MedGemma) |

| CONTRA principal | Modelos grandes exigem infra cara | Pode perder em raciocínio profundo | Ecossistema menor = menos suporte | Compliance para dados sensíveis | Empresa chinesa (mesmo cuidado do DeepSeek) | Proíbe usar pesos para treinar outros LLMs |

*Gemma Terms of Use: outputs e pesos não podem ser usados para treinar outros LLMs.

Guia rápido de decisão por setor

- Saúde / Telemedicina: Gemma 3 (MedGemma) para triagem e análise de imagens; Llama 3.3 para dados on-premise com LGPD

- Fintechs e análise de risco: DeepSeek R1 para raciocínio profundo e detecção de fraude

- E-commerce e suporte global: Qwen3 para 119 idiomas + Mistral para tickets em alta velocidade

- Startups SaaS: Mistral 7B (API barata, Apache 2.0) ou Gemma 3 12B (1 GPU)

- EdTech / Tutoria inteligente: Qwen3-72B fine-tunado em currículo local

- Manufatura / IoT / Edge: Falcon 2 11B ou Gemma 3 4B — uma GPU, resposta rápida

- Research, R&D, farmacêutica: DeepSeek R1 + Qwen3 para capacidade de fronteira sem custo de cloud proprietário

- Stack GCP: Gemma 3 no Vertex AI — zero atrito de deployment

O que 2026 deixou claro é que a corrida open source saiu da fase “promissor” para a fase “produção”. Modelos open source representam 62,8% do mercado por contagem de modelos, com paridade total com modelos fechados projetada para o Q2 de 2026. Para qualquer empresa que ainda está esperando para avaliar essa stack — o momento não é futuro. É agora.

Fontes

- Meta AI Blog – Llama 3

- First AI Movers – Mistral AI 2025

- TII – Falcon 2 Official Release

- DeepSeek GitHub V3

- InfoQ – DeepSeek V3 Specs

- Intuition Labs – DeepSeek Inference Cost

- Zartis – DeepSeek R1 Enterprise

- BardAI – DeepSeek R1 Launch

- BytePlus – DeepSeek R1 Enterprise Use Cases

- Qwen3 Official – Alibaba

- Qwen3 Use Cases

- NoteGPT – Qwen3 Overview

- Google Blog – Gemma 3

- Google AI Dev – Gemma 3 Model Card

- Belsterns – Gemma 3 Analysis

- Dasroot – LLM Selection Guide 2026

- Swfte – Open Source AI Models Frontier 2026

- Apex Logic – Enterprise Open Source AI 2026

- ProxPC – Llama 3 Hardware Requirements

- PricePerToken – Fine-tuning Pricing 2026

- Latitude.so – LLM Cost Comparison

- Avichala – Falcon vs Mistral vs Llama

- Novalogiq – Mistral 3 Launch

- TMCNet – Qwen3-2507 Benchmarks