O erro que custa milhões

A maioria das empresas começa um projeto de IA pensando em resolver o problema de hoje. Constroem um protótipo que funciona. Ficam empolgadas. Escalam. E então, quando o sistema começa a crescer de verdade — mais usuários, mais dados, mais modelos — descobrem que a arquitetura que parecia sólida é, na verdade, uma bomba-relógio.

O custo dessa descoberta é devastador. Refatorar uma aplicação monolítica que já está em produção custa entre 3× e 10× mais do que teria custado construí-la modular desde o início. Pior: enquanto a refatoração acontece, o produto para. A equipe paralisa. Os clientes reclamam.

“Design for ~10X growth, but plan to rewrite before ~100X.”

Esse princípio, documentado por Jeff Dean — um dos maiores engenheiros de infraestrutura da história da computação — resume a tensão central da escalabilidade: você não precisa construir para o Google no dia um, mas precisa construir de uma forma que não force um reescrever completo quando o crescimento chegar.

Este artigo mostra como a Volcano pensa e projeta infraestrutura de IA para crescer 10× sem custos excessivos — com base em arquitetura técnica real, não em promessas de slides de vendas.

Por que isso nunca foi tão urgente

O crescimento da infraestrutura de IA não é linear. É exponencial — e a maioria das organizações está subestimando a velocidade dessa curva.

- 10× — Crescimento projetado em demanda de compute por AI agents nos próximos 3 anos (Cockroach Labs, 2026)

- 83% — Das empresas esperam que sua infraestrutura falhe sem upgrades maiores nos próximos 24 meses

- 85% — Dos modelos de machine learning nunca chegam à produção — geralmente por problemas de infraestrutura

- 51% — Das organizações gastam mais de 25% do orçamento de TI em remediação de dívida técnica arquitetural

A aceleração de IA não está esperando ninguém se preparar. Agentes de IA — diferente de usuários humanos — não clicam uma vez a cada dois segundos. Eles podem fazer 5.000 requisições por segundo. A infraestrutura pensada para tráfego humano simplesmente não sobrevive a isso.

63% dos times executivos subestimam a velocidade com que a demanda de IA vai superar a infraestrutura existente — segundo relatório de 2026 da Cockroach Labs. Esse é o gap entre o que a liderança imagina e o que a engenharia enfrenta.

Os 6 Princípios de uma Arquitetura que Escala

Não existe mágica. Existe design. Projetos de IA que escalam de forma eficiente compartilham os mesmos padrões arquiteturais — e projetos que colapsam sob crescimento compartilham os mesmos anti-padrões. A diferença entre os dois é decisão de design, feita antes de escrever a primeira linha de código.

01 — Modularidade desde o Dia Zero

Arquiteturas modulares — baseadas em microserviços e containers — permitem escalar apenas os componentes que estão sob pressão, sem tocar no resto. Cada serviço com responsabilidade única, deployável e escalável de forma independente.

02 — Interfaces Estáveis, Implementações Voláteis

O contrato entre serviços deve ser estável. A implementação por trás pode mudar livremente. Quando a lógica de negócio permanece estável mas os modelos de IA evoluem, a interface garante que nada quebre na cadeia.

03 — Dados como Primeiro Cidadão

Pipelines de dados escaláveis, com validação de esquema na ingestão e feature stores compartilhadas, eliminam o “training-serving skew” — a causa número um de falhas silenciosas em produção.

04 — Observabilidade Nativa

Monitoramento não é afterthought. Métricas, traces e logs são instrumentados desde o design. Sem visibilidade profunda, escalar é navegar no escuro — e os problemas só aparecem quando já viraram incêndios.

05 — Automação como Infraestrutura

CI/CD, testes automáticos, deploy de modelos e rollback automático não são “luxos de empresa grande”. São requisitos de qualquer sistema que precise escalar sem escalar o time na mesma proporção.

06 — Sem Lock-in Arquitetural

Dependências profundas de um único provedor ou framework criam prisões. Arquiteturas abertas, usando padrões como ONNX para portabilidade de modelos e Kubernetes para orquestração, preservam a liberdade de evoluir.

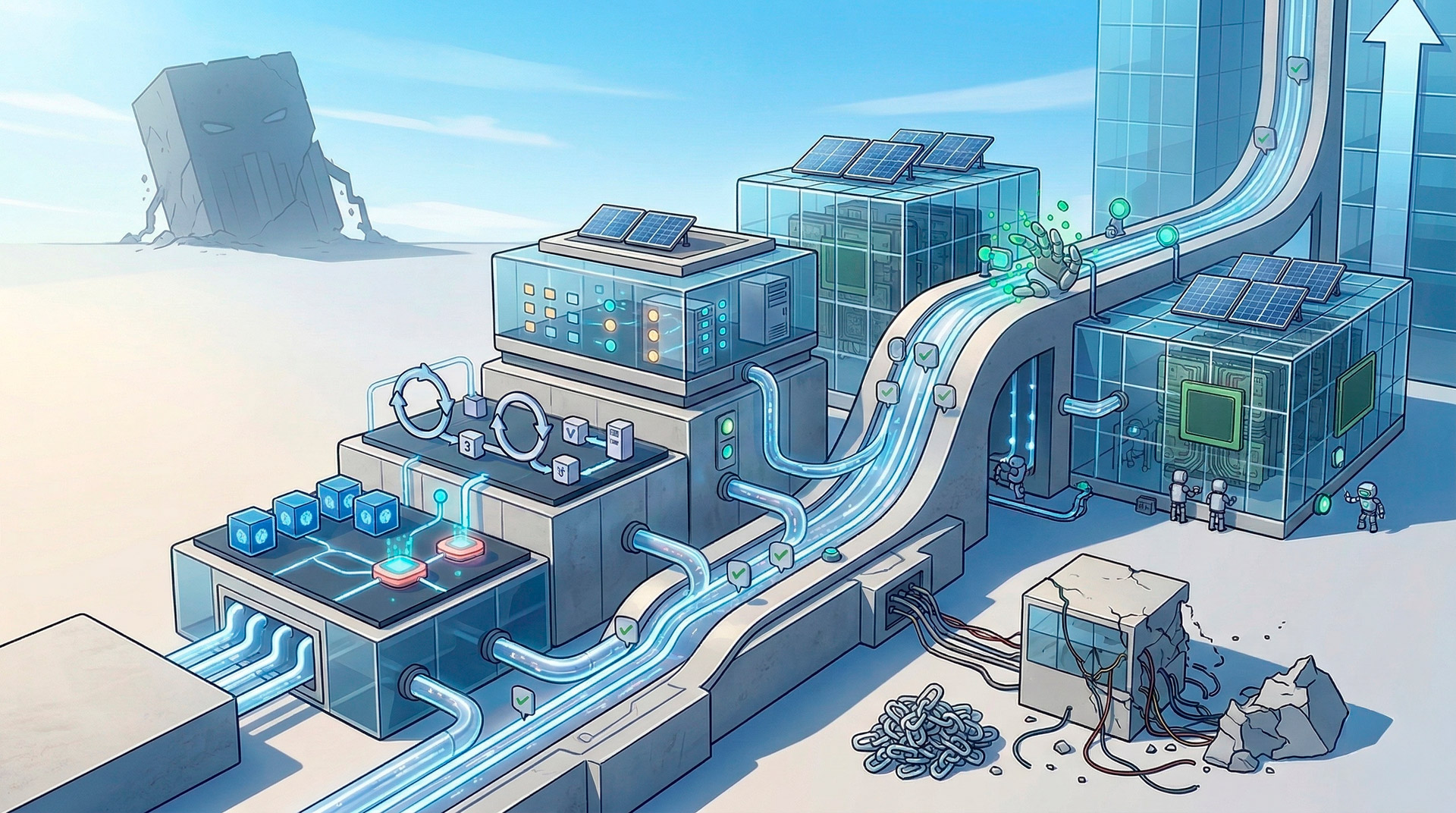

A Stack que Escala

Uma infraestrutura de IA que cresce 10× sem refatoração crítica é construída em camadas — cada uma com responsabilidade clara, contratos bem definidos e capacidade de escalar de forma independente.

- Interface / API — Gateway, Rate Limiting, Auth: contratos estáveis com o mundo externo

- Orquestração — Kubernetes + Kubeflow: deploy, rollback, auto-scaling de workloads

- Serving / Inferência — Microserviços de modelo: escalagem horizontal por demanda real

- MLOps Pipeline — MLflow, DVC, CI/CD: versionamento de código, dados e modelos

- Feature Store — Feast / Tecton: features consistentes entre treino e produção

- Data Foundation — Pipelines validados, schema enforcement, data quality gates

Por que cada camada importa

A camada de dados é a fundação. A McKinsey estima que até 90% das falhas em desenvolvimento de ML vêm não de modelos ruins, mas de práticas ruins de produtização — especialmente na integração com dados de produção. Validar dados na entrada, versionar datasets com ferramentas como DVC e garantir feature stores compartilhadas elimina a classe mais comum de falhas silenciosas em produção.

A Feature Store é o segredo que poucos falam. O “training-serving skew” — quando as features usadas no treino são diferentes das usadas na inferência — é apontado como a causa número um de falhas silenciosas em modelos em produção. Uma feature store centralizada resolve isso estruturalmente.

Orquestração com Kubernetes não é overhead, é seguro. A elasticidade da nuvem sozinha não resolve o problema de escala. O que determina se um sistema vai sobreviver a um pico de demanda é a arquitetura de dados e orquestração em cima do compute — e não o compute em si.

Dívida Técnica: O juros composto que quebra empresas

Dívida técnica arquitetural não é um problema de código. É um problema financeiro. E assim como dívida financeira, ela tem juros compostos — quanto mais tempo você espera para pagar, mais caro fica.

Um estudo publicado na ScienceDirect, que conduziu 25 entrevistas com engenheiros de sete grandes empresas trabalhando com microserviços, identificou 16 tipos de dívida técnica arquitetural — cada um com seu custo de remediação e impacto no negócio. O padrão é sempre o mesmo: o que parece uma decisão pragmática no começo se transforma em grilhão conforme o sistema cresce.

Arquitetura sem escalabilidade planejada

- Monolito que escala apenas verticalmente — mais hardware, mais custo

- Acoplamento forte entre serviços — mudança em um quebra outros

- Sem versionamento de dados e modelos — impossível reproduzir resultados

- Monitoramento reativo — problemas descobertos pelos usuários

- Deploy manual — riscos humanos, velocidade baixa

- Feature engineering duplicada — inconsistência entre treino e produção

- Refatoração total necessária a cada crescimento relevante

Arquitetura com escalabilidade by design

- Microserviços escaláveis horizontalmente — custo proporcional ao uso

- Interfaces estáveis, implementações independentes

- MLflow + DVC: todo artifact versionado, experimentos reproduzíveis

- Observabilidade nativa — problemas detectados antes de virar crise

- CI/CD automatizado — deploy confiável, rollback em segundos

- Feature store centralizada — consistência garantida end-to-end

- Escala incremental — crescimento sem reescrita

Organizações saudáveis alocam entre 10% e 30% do orçamento de TI para remediação proativa de dívida técnica. Organizações que negligenciam isso frequentemente veem essa proporção se inverter — gastando 70% em manutenção e apenas 30% em inovação.

A decisão de construir certo desde o início não é sobre perfecionismo. É sobre matemática simples: construir modular desde o primeiro dia custa mais 20-30% no começo. Refatorar um monolito em produção custa de 3× a 10× o custo original — mais o custo do downtime, da perda de oportunidade e do moral destruído da equipe.

MLOps: o Sistema Nervoso da IA em Produção

Um modelo de IA que funciona no laptop de um cientista de dados é um experimento. Um modelo que funciona em produção, para milhares de usuários, sob pressão, com monitoramento, versionamento e capacidade de rollback — esse é um produto. A diferença entre os dois é MLOps.

A pesquisa é direta: 85% dos modelos de machine learning nunca chegam à produção. E os que chegam sem práticas sólidas de MLOps frequentemente falham silenciosamente — degradando sem que ninguém perceba, até que o problema já é grande demais para ignorar.

O Stack MLOps essencial

- Versionamento triplo: código (Git), dados (DVC) e modelos (MLflow Model Registry) — toda decisão rastreável, todo experimento reproduzível.

- Feature Store (Feast ou Tecton): elimina o training-serving skew estruturalmente, garantindo que o modelo em produção veja exatamente os mesmos dados que aprendeu.

- CI/CD para ML: cada commit dispara validação automática de dados, testes de modelo e pipeline de deploy — reduzindo incidentes em até 40%.

- Monitoramento de drift: modelos degradam conforme os dados do mundo real mudam. Monitoramento de data drift e concept drift detecta isso antes que vire problema de negócio.

- Rollback automático: se uma nova versão de modelo degrada métricas além do threshold, o sistema reverte automaticamente para a versão anterior.

- Containerização: Docker + Kubernetes garante que o modelo funciona da mesma forma em qualquer ambiente.

Segundo a McKinsey, quando empresas adotam boas práticas de MLOps, a diferença não é incremental. É a diferença entre experimentar com IA e transformar a posição competitiva da empresa com IA. A operacionalização correta é o que separa projetos piloto de vantagem competitiva real.

Dicas

Fase 1 — Arquitetura antes de código

Antes de escrever a primeira linha de código, mapeamos os vetores de crescimento: quais componentes vão escalar mais? Onde estão os gargalos potenciais? Quais interfaces precisam ser estáveis? Essa fase de design evita que decisões de conveniência de curto prazo se transformem em prisões arquiteturais.

Fase 2 — Infraestrutura como produto

A infraestrutura não é só “o lugar onde o modelo roda”. É um produto em si, com requisitos de confiabilidade, observabilidade e escalabilidade. Implementamos desde o início: feature stores, monitoramento de drift, pipelines de CI/CD para ML, e versionamento completo de dados, código e modelos.

Fase 3 — Governança Contínua

Escalar não é um evento. É um processo. Implementamos dashboards de saúde arquitetural, métricas de dívida técnica e rituais de revisão que previnem o acúmulo de debt antes que ele se torne catastrófico.

Checklist Volcano de Escalabilidade

- Design modular com microserviços e containers desde o dia zero — sem monolitos

- Feature Store implementada antes da primeira versão de produção

- CI/CD para ML configurado antes do primeiro deploy real

- Observabilidade nativa: métricas de modelo, dados e infraestrutura em um único painel

- Estratégia de deploy com canary releases e rollback automático

- Revisões de dívida técnica arquitetural como parte do ciclo de desenvolvimento

- Plano de capacidade projetando crescimento 10× — compute, storage e rede

Planejando capacidade sem explodir o budget

Escalar 10× não significa gastar 10× mais. Uma arquitetura bem projetada escala de forma sub-linear — você cresce 10× em capacidade enquanto cresce talvez 3× ou 4× em custo. Isso é possível porque componentes diferentes têm perfis de crescimento radicalmente diferentes.

A OpenAI usa scaling laws para projetar crescimento de compute de 10× ao ano até 2030 — mas com separação clara entre workloads de treino (imensos durante o treino, zero depois) e workloads de inferência (crescimento contínuo com padrões diários e sazonais).

As três categorias de crescimento

Treino de modelos escala de forma não-linear com o tamanho do modelo, seguindo as Chinchilla Scaling Laws. O planejamento correto evita over-provisioning de GPU por meses — um dos maiores desperdícios de budget em projetos de IA.

Inferência escala linearmente com volume de requisições, mas varia 100× com base no tamanho da sequência e batch size. Configurar auto-scaling inteligente, baseado em métricas reais de uso, evita pagar por capacidade ociosa na maior parte do tempo.

Dados e storage crescem de forma mais previsível — mas pipelines mal projetados criam gargalos que não são de compute, mas de throughput de I/O. Arquitetura correta de storage é frequentemente mais impactante do que adicionar mais GPUs.

O custo de inferência de IA caiu 280× entre 2022 e 2024. Planejar a infraestrutura com essa trajetória em mente — e não apenas com o custo de hoje — é parte do planejamento de capacidade inteligente.

Organizações maduras mantêm 20% de capacidade de flexibilidade para absorver disrupções inesperadas: um breakthrough algorítmico, uma aplicação nova que cria pico de demanda, ou uma oportunidade de mercado que exige escala rápida.

A escolha que define o futuro do projeto

Toda empresa que constrói IA enfrenta essa decisão no começo: construir rápido hoje e pagar depois, ou investir em arquitetura agora e crescer sem fricção amanhã.

A evidência é clara. Estudos acadêmicos, dados de mercado e a experiência de empresas que escalaram — e de outras que colapsaram tentando — apontam para a mesma direção: a arquitetura certa desde o início não é um custo. É o maior investimento que um projeto de IA pode fazer.

O mundo está se movendo mais rápido do que os ciclos de refatoração permitem. Agentes de IA geram 5.000 requisições por segundo onde antes havia uma por usuário. A demanda vai dobrar, triplicar, crescer 10×. A questão não é se isso vai acontecer — é se a arquitetura vai aguentar quando acontecer.

A diferença entre experimentar com IA e transformar a posição competitiva de uma empresa com IA é, quase sempre, uma decisão arquitetural tomada antes do primeiro deploy em produção.

Fontes

- The Hidden Architecture Behind AI Systems That Don’t Break Under Growth — TechTalks (2025)

- AI Agents Could Crush Enterprise Infrastructure — SiliconANGLE / Cockroach Labs (2026)

- AI Infrastructure Capacity Planning — Introl Blog (2025)

- MLOps: So AI Can Scale — McKinsey & Company (2024)

- Identifying Architectural Technical Debt in Microservices: A Multiple-Case Study — ScienceDirect (2021)

- Architectural Modernization Meets AI-Assisted Development — Efficiently Connected (2025)

- MLOps Best Practices, Challenges and Maturity Models: A Systematic Literature Review — ScienceDirect (2025)

- Best Practices for Building Scalable AI Infrastructure — TechTarget

- 10X Backbone: How Meta Is Scaling Backbone Connectivity for AI — Meta Engineering (2025)

- How to Prevent AI from Scaling Technical Debt — Future Processing (2025)

- When Intelligence Overloads Infrastructure: A Forecast Model for AI-Driven Bottlenecks — arXiv (2025)

- AI Infrastructure Engineering: Building Enterprise-Scale Machine Learning Systems — Wevolver

- MLOps Best Practices: Building Robust ML Pipelines — Clarifai (2025)