Segurança em primeiro lugar

O que os bancos, as seguradoras e os hospitais precisam saber — e o que os algoritmos não contam para você.

Protocolos para Projetos de IA em Ambientes Regulamentados — Segurança e Conformidade na IA para Bancos, Seguradoras e Setor de Saúde

O dia em que o algoritmo decidiu

São Paulo, 14h32. Um homem de 43 anos, motorista de aplicativo há seis anos, entra pela terceira vez no aplicativo do banco. Sua ficha é impecável — nunca atrasou uma parcela, paga IPTU em dia, tem renda mensal estável. Mas o sistema retorna a mesma resposta: crédito negado. Sem explicação. Sem recurso. Sem nome. Apenas um algoritmo que, em frações de segundo, leu padrões em seus dados e concluiu que ele era um risco.

A mesma semana. Chicago. Uma paciente de 67 anos aguarda o resultado de um sistema de triagem baseado em inteligência artificial implantado no hospital onde está internada. O modelo, treinado predominantemente com dados de pacientes brancos de renda média-alta, subestima a urgência do seu quadro. A cirurgia é adiada. As consequências, irreversíveis.

Esses não são cenários hipotéticos de ficção científica. São os riscos reais, documentados e crescentemente litigados que emergem quando sistemas de inteligência artificial são implantados em ambientes de alto impacto — financeiro e de saúde — sem os protocolos adequados de segurança, conformidade e governança. E os números não mentem:

- USD 9,77 milhões

- custo médio de uma violação de dados no setor de saúde em 2024 — o maior de qualquer indústria

- USD 6,08 milhões

- custo médio de uma violação no setor financeiro em 2024 — alta de 3% sobre o ano anterior

- 275 milhões

- registros de pacientes expostos em 725 violações massivas de dados de saúde em 2024

Este artigo foi escrito para as pessoas que tomam decisões: CTOs que precisam justificar investimentos em conformidade para conselhos céticos, juristas que precisam entender o que o código faz quando seus clientes são processados, executivos de saúde que apostam na IA para transformar o SUS e para os profissionais que, no dia a dia, constroem os sistemas que decidirão sobre crédito, saúde e liberdade de milhões de pessoas.

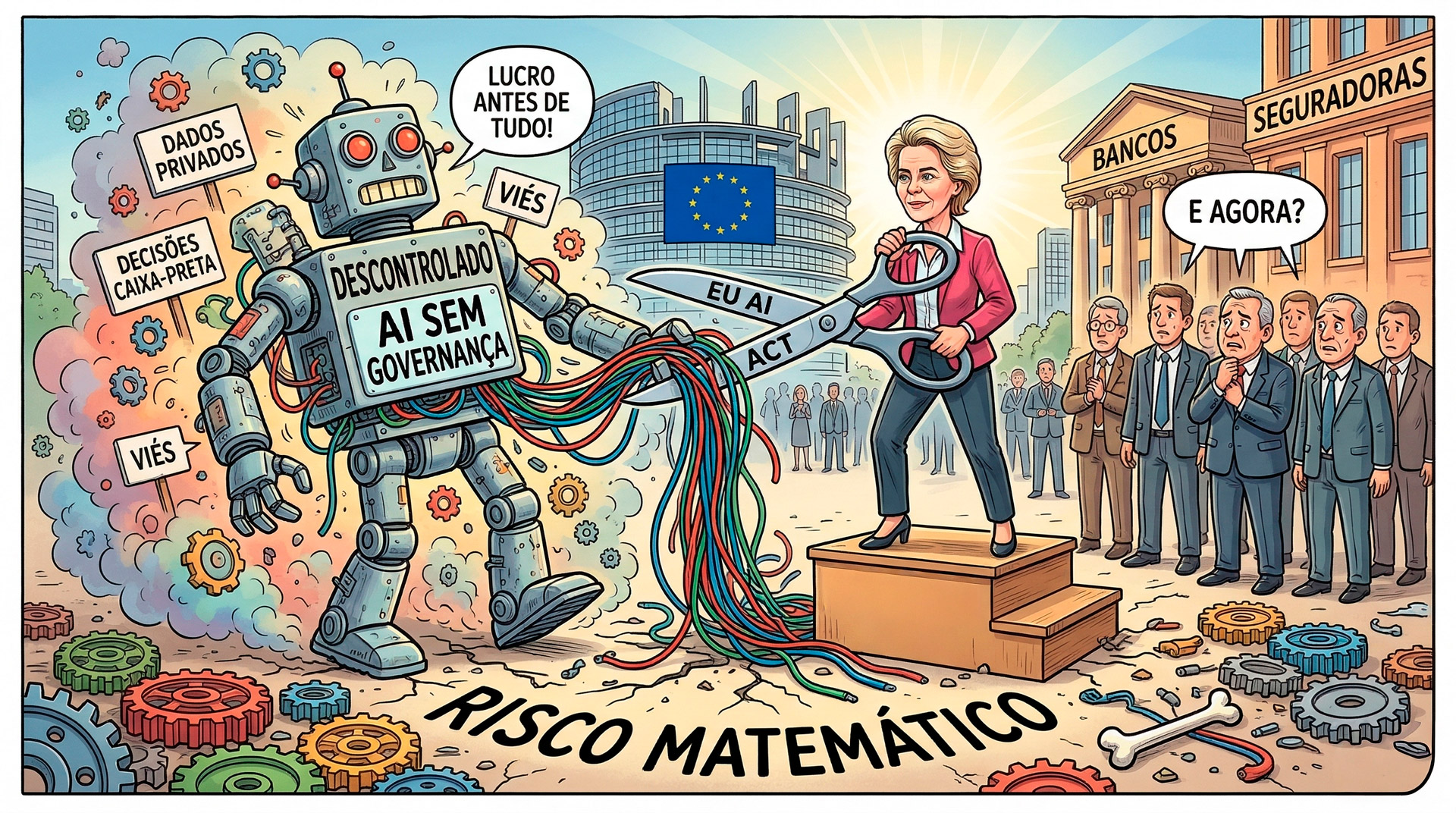

“Um algoritmo sem governança não é inovação. É risco embalado em matemática.”

A grande virada: Quando os reguladores acordaram

Durante décadas, as empresas de tecnologia operaram com uma convicção inabalável: mover rápido e quebrar coisas. Então, em 2024, o mundo inteiro começou a enviar a conta.

Há algo de inevitável na história que estamos vivendo. Por anos, algoritmos tomaram decisões que afetavam vidas — negavam crédito, fixavam prêmios de seguro, priorizavam listas de espera médica — com uma opacidade que nenhum funcionário humano poderia impunemente invocar. A regulação estava atrasada. E os legisladores, finalmente, correram para compensar o tempo perdido.

O resultado é um dos momentos mais intensos de produção regulatória da história recente. Em menos de dezoito meses, o mundo ganhou o EU AI Act (agosto de 2024), o Financial Services AI Risk Management Framework americano (fevereiro de 2025), a Portaria ANPD nº 5/2024 no Brasil, e a retomada das auditorias HIPAA pelo HHS americano com foco explícito em IA. Pela primeira vez na história, os algoritmos têm nomes nas leis — e as leis têm dentes.

O regulamento europeu que mudou tudo

O Regulamento (UE) 2024/1689 — batizado de EU AI Act — é a primeira legislação abrangente sobre inteligência artificial no mundo. Entrou em vigor em 1º de agosto de 2024 e tem alcance extraterritorial: se sua empresa usa IA que toca a vida de um cidadão europeu, você está sob sua jurisdição. Não importa se sua sede é em São Paulo, Pequim ou Nova York.

A lógica do regulamento é elegante em sua brutalidade: quanto maior o risco, maior a obrigação. Sistemas de IA são classificados em quatro camadas — risco inaceitável (proibidos), alto risco, risco limitado e risco mínimo. E atenção para o detalhe que muda tudo para bancos e seguradoras: o próprio Anexo III da lei lista explicitamente como sistemas de alto risco os algoritmos de pontuação de crédito e os sistemas de underwriting para seguros de vida e saúde.

O que isso significa na prática? Que esses sistemas precisam de documentação técnica exaustiva antes da implantação, supervisão humana obrigatória, registro em banco de dados europeu e monitoramento contínuo pós-lançamento. Penalidades pelo descumprimento podem chegar a EUR 35 milhões ou 7% do faturamento global anual — o que for maior. Não é multa simbólica. É extinção.

“O EU AI Act não proibiu a IA nos bancos. Ele proibiu a IA irresponsável nos bancos. A diferença é tudo.”

Uma pesquisa da European Insurance and Occupational Pensions Authority (EIOPA) de 2023–2024 revelou que 50% das seguradoras de ramos gerais já utilizam modelos de IA em produção. Desses, a maioria ainda não havia iniciado, quando da publicação do relatório, os processos de conformidade exigidos pelo regulamento — o que significa que a indústria de seguros europeia está correndo contra um relógio que ela própria escolheu ignorar por tempo demais.

Os EUA e o framework que virou lei na prática

Os americanos não têm, até o momento, uma lei federal unificada sobre IA. Mas constroem paredes com tijolos, e cada tijolo tem peso regulatório real. Em janeiro de 2023, o National Institute of Standards and Technology (NIST) publicou o AI Risk Management Framework 1.0 — um documento voluntário que rapidamente deixou de ser voluntário, porque reguladores como o CFPB, a SEC e o OCC passaram a usá-lo como padrão implícito de due diligence esperado das instituições financeiras.

Em fevereiro de 2025, o Departamento do Tesouro foi além e lançou o Financial Services AI Risk Management Framework (FS AI RMF): 230 objetivos de controle, organizados por estágio de maturidade de adoção de IA, cobrindo instituições desde a fase piloto até implantações em escala empresarial. Para quem estava esperando clareza, era isso: um manual operacional de conformidade para IA financeira, com granularidade cirúrgica.

No mesmo período, estados americanos avançaram com legislações próprias. A California Senate Bill 24-205, efetiva a partir de fevereiro de 2026, obriga instituições financeiras a divulgar como decisões de crédito baseadas em IA são tomadas — incluindo as fontes de dados e as métricas de avaliação dos modelos. Illinois expandiu a supervisão de sistemas de análise preditiva para crédito ao consumidor. O mosaico regulatório americano começa a ganhar coerência.

HIPAA: A velha lei que aprendeu a civer na era da IA

Promulgada em 1996, a HIPAA foi escrita quando a internet ainda engatinhava. E ainda assim, em 2024, ela permanece a espinha dorsal da proteção de dados de saúde nos Estados Unidos — reinterpretada, a cada novo ciclo, para cobrir realidades que seus redatores não poderiam imaginar.

Para sistemas de IA que processam Protected Health Information (PHI), a HIPAA impõe um conjunto de exigências que vai muito além da criptografia básica. Exige que cada fornecedor externo de IA assine um Business Associate Agreement (BAA) com cláusulas específicas para IA — um contrato que distribui responsabilidade legal e define o que o algoritmo pode e não pode fazer com os dados dos pacientes.

Em dezembro de 2024, o Departamento de Saúde e Serviços Humanos (HHS) anunciou a retomada das auditorias HIPAA com foco explícito em IA, após constatar que 725 violações massivas de dados de saúde expuseram mais de 275 milhões de registros em 2024 sozinho. O sinal é claro: a era das auditorias superficiais acabou. O regulador chegou para ficar — e para verificar, linha a linha, se os seus algoritmos respeitam a privacidade dos pacientes.

Bancos e seguradoras: O preço da confiança algorítmica

O setor financeiro foi o primeiro a abraçar a inteligência artificial em escala industrial. Agora, é o primeiro a enfrentar as consequências de ter corrido mais rápido que a sua própria governança.

Existe uma ironia perturbadora no coração da revolução da IA financeira. Os mesmos sistemas que prometem democratizar o crédito, detectar fraudes em milissegundos e tornar os seguros mais justos são também os mais propensos a reproduzir e amplificar as desigualdades históricas que deveriam corrigir. Um modelo de concessão de crédito treinado em dados históricos aprende, inevitavelmente, os preconceitos históricos embutidos nesses dados. E ele os executa em escala industrial, sem sono, sem hesitação, sem compaixão.

O Bank for International Settlements (BIS), em relatório do Financial Stability Institute publicado em dezembro de 2024, foi direto ao ponto: embora a IA não introduza riscos fundamentalmente novos, há enorme espaço para fortalecer os frameworks regulatórios em três áreas críticas — governança de modelos, gestão de riscos e dependência de fornecedores externos. Essas três áreas têm em comum o fato de serem exatamente onde a maioria das instituições financeiras está mais vulnerável.

O Modelo que Ninguém Consegue Explicar

Imagine ser o diretor jurídico de um banco médio brasileiro. Um cliente processou sua instituição porque o algoritmo de crédito negou seu empréstimo. O juiz pede que você explique, com detalhes, como a decisão foi tomada. E você descobre que ninguém na sua empresa sabe responder. O fornecedor externo do modelo diz que é propriedade intelectual. O cientista de dados diz que é uma rede neural com 47 camadas e que a interpretação é matematicamente impossível. O atendimento ao cliente repete o script: “nossa análise é automatizada e sigilosa”.

Esse cenário não é hipotético. Ele acontece — e vai acontecer cada vez mais, à medida que GDPR, LGPD e EU AI Act impõem o direito à explicação de decisões automatizadas. Para o setor financeiro, isso tem uma consequência técnica concreta e urgente: sistemas de caixa-preta pura — redes neurais profundas sem instrumentos de interpretação — tornaram-se juridicamente problemáticos. Técnicas como SHAP (SHapley Additive exPlanations) e LIME (Local Interpretable Model-agnostic Explanations) deixaram de ser diferenciais técnicos para se tornarem ferramentas de defesa em litígios.

“No tribunal da conformidade, ‘o algoritmo decidiu’ não é uma resposta. É uma confissão.”

Cinco camadas que separam o banco seguro do banco vulnerável

A implantação segura de IA em instituições financeiras exige ao menos cinco camadas de proteção interconectadas. Não basta ter uma e imaginar que as outras virão naturalmente — elas não virão.

Governança e propriedade de modelos

Todo modelo de IA em produção precisa de um dono — uma pessoa com nome, cargo e responsabilidade formal pelo seu comportamento. Esse owner define os limiares de alerta de deriva de modelo (model drift), aciona o processo de validação quando o desempenho cai e responde, diante do conselho e dos reguladores, pelo que o algoritmo faz. Parece óbvio. É sistematicamente ignorado.

Segurança de dados e controle de acesso

O princípio do menor privilégio precisa governar cada acesso a dados em sistemas de IA financeiros. Controles de acesso baseados em funções (RBAC), autenticação multifator para dados sensíveis, criptografia AES-256 em repouso e TLS 1.3 em trânsito — e registros imutáveis de auditoria que permitam reconstruir qualquer decisão do passado, linha por linha.

Validação independente antes da implantação

Nenhum modelo de IA com impacto sobre clientes deveria ir a produção sem uma rodada de validação conduzida por uma equipe separada do time de desenvolvimento. Isso significa testes de performance, testes de viés demográfico, testes de adversarial robustness e uma análise formal de riscos. Na maioria das empresas, essa etapa é pulada porque “o prazo é curto”. Essa é a razão pela qual a maioria dos escândalos de IA financeira existe.

Monitoramento contínuo pós-implantação

Um modelo aprovado hoje pode estar errado amanhã. Condições econômicas mudam, comportamentos de clientes evoluem, padrões de fraude se adaptam. Sistemas robustos de IA financeira monitoram continuamente métricas de performance, equity e calibração — com alertas automáticos quando qualquer indicador cai abaixo de limiares predefinidos.

Gestão de fornecedores externos de IA

A terceirização da IA não terceiriza a responsabilidade. Bancos e seguradoras que compram sistemas de IA de fintechs ou big techs continuam plenamente responsáveis pelo cumprimento das normas — e por tudo que o algoritmo fizer. Contratos com fornecedores precisam incluir direitos de auditoria, exigências de divulgação de incidentes e garantias de continuidade operacional. O risco de concentração em fornecedores sistêmicos de IA é hoje uma das principais preocupações do BIS e das autoridades de supervisão financeira globais.

O viés que custa bilhões — e vidas

Um estudo publicado em 2025 no Harvard Data Science Review (HDSR/MIT Press) analisou 12,4 milhões de observações de cotações, apólices e sinistros de quatro seguradoras pan-europeias. O resultado foi perturbador: em cenários de estresse regulatório, prêmios cobrados do quintil de renda mais baixa excediam os benchmarks de precificação justa em 5,8% nos seguros de vida e 7,2% nos seguros de saúde. Ou seja: os mais pobres pagam mais — não por julgamento humano, mas por herança estatística de um algoritmo.

O estudo concluiu que o debias adversarial proativo — integrar explicitamente a correção de viés no processo de treinamento dos modelos, em vez de tentar corrigi-lo depois — oferece às seguradoras uma via eficiente em termos de capital para conformidade com o EU AI Act. Não é só ética. É estratégia.

A IA na sala de cirurgia: Quando os dados são vidas

Existe uma categoria de dados mais sensível do que a sua conta bancária. É o histórico das suas doenças. E nunca tantos algoritmos tiveram acesso a tantos deles.

Em 2024, 92% das organizações de saúde sofreram ao menos um ciberataque. Desse total, 69% reportaram interrupções diretas no atendimento a pacientes. Isso não é apenas uma estatística de TI. É uma sentença sobre a fronteira entre segurança digital e segurança clínica — uma fronteira que, no setor de saúde, não existe.

Quando o sistema de triagem de um hospital cai porque um ransomware criptografou seus servidores, o paciente que aguardava diagnóstico espera mais. Quando o modelo de diagnóstico por imagem tem um viés de treinamento, o paciente do grupo sub-representado recebe um diagnóstico menos preciso. A IA na saúde não é IA em uma planilha. É IA na vida — e na morte — de pessoas reais.

O problema dos dados que sabem demais

Dados de saúde são o petróleo do século XXI — mas com a densidade de um acidente nuclear. Eles revelam condições físicas e psicológicas íntimas, predisposições genéticas, histórico de vícios e transtornos, e podem ser usados para discriminação em empregos, seguros e crédito. Um histórico de depressão no prontuário errado pode custar um emprego. Um diagnóstico de HIV, um relacionamento.

É por isso que a legislação de proteção de dados de saúde — HIPAA nos EUA, GDPR na Europa, LGPD no Brasil — classifica esses dados na categoria mais sensível e impõe as restrições mais severas. E é por isso que, quando sistemas de IA os processam, o nível de diligência necessário é proporcionalmente mais alto do que em qualquer outro setor.

Os números confirmam a gravidade. O custo médio de uma violação de dados de saúde atingiu USD 9,77 milhões por incidente em 2024 — o mais alto de qualquer setor, pelo décimo quarto ano consecutivo. A Ponemon Healthcare Cybersecurity Review registrou que 81,2% das grandes violações foram causadas por ataques de hacking e incidentes de TI. O dado mais revelador: 98% das organizações com criptografia adequada foram capazes de se recuperar de ataques de ransomware. A proteção técnica funciona. O problema é que ela ainda não é universal.

“Uma violação de dados em uma seguradora custa dinheiro. Uma violação de dados em um hospital pode custar vidas.”

O framework HIPAA na era da IA generativa

A HIPAA foi escrita quando ainda não existiam Large Language Models, chatbots médicos ou sistemas de geração de notas clínicas por IA. E ainda assim, ela permanece a principal referência regulatória americana — reinterpretada, com frequência crescente, por advogados e reguladores que tentam aplicar um framework de 1996 a uma tecnologia de 2024.

A Professora Stacey A. Tovino, em artigo publicado no Houston Journal of Health Law & Policy em 2025, mapeou as lacunas mais críticas: a IA generativa pode coletar Protected Health Information (PHI) de formas não antecipadas na concepção original do sistema, gerando riscos de divulgação não autorizada que a HIPAA técnica cobre, mas cujos mecanismos de prevenção ainda não estão suficientemente claros para os desenvolvedores.

O caso do Health Bot da Microsoft em 2024 é emblemático: um sistema certificado como HIPAA-compliant precisou de correção emergencial para uma vulnerabilidade de elevação de privilégio que poderia permitir acesso não autorizado a outros recursos. Mesmo sistemas auditados e certificados falham. A conformidade não é um destino. É uma prática contínua.

As novas propostas regulatórias do HHS, anunciadas em janeiro de 2025, tornaram isso explícito: entidades cobertas devem realizar scanning de vulnerabilidades a cada seis meses e testes de penetração ao menos anualmente. Planos de recuperação de desastres devem prever restauração de sistemas críticos em 72 horas. O regulador não está mais aceitando “estávamos tentando” como resposta.

Equidade clínica: O viés que a medicina não pode tolerar

Há uma diferença crucial entre o viés algorítmico no crédito e o viés algorítmico na saúde. No crédito, o viés nega acesso a recursos. Na saúde, o viés pode negar acesso à vida. Sistemas de diagnóstico por imagem treinados predominantemente com dados de grupos demográficos específicos produzem resultados sistematicamente menos precisos para grupos sub-representados — perpetuando, em código, as desigualdades históricas da medicina.

O framework publicado no arXiv em abril de 2025 propõe uma arquitetura robusta para IA clínica HIPAA-compliant, com três mecanismos centrais: Attribute-Based Access Control (ABAC) para governança granular de PHI; um pipeline híbrido de sanitização de dados combinando padrões regex e modelos de linguagem para minimizar exposição em fluxos de inferência; e trilhas de auditoria imutáveis para verificação retrospectiva de conformidade. É técnica a serviço da ética — e da lei.

O Brasil na corrida regulatória: entre a ambição e a urgência

O Brasil tem uma das legislações de proteção de dados mais modernas do mundo. O que ainda falta é a maturidade do ecossistema para honrá-la.

A Lei Geral de Proteção de Dados (LGPD, Lei nº 13.709/2018) entrou em vigor em setembro de 2020. Em menos de cinco anos, ela passou de lei ignorada a diploma regulatório com dentes. A Autoridade Nacional de Proteção de Dados (ANPD) saiu da inércia inicial e começou a autuar — e o mercado acordou. A multa de R$ 8 milhões aplicada ao Banco Pan em 2023 por violação das regras de consentimento no uso de dados pessoais para marketing foi o sinal que o setor financeiro precisava para levar a LGPD a sério.

Mas a LGPD foi escrita antes da explosão da IA generativa. E uma análise publicada na Revista de Fiscalização Tecnológica em 2024 identificou as lacunas: a lei fornece uma base principiológica sólida, mas é insuficiente para aspectos técnicos específicos dos sistemas de machine learning — particularmente quando a finalidade do tratamento de dados evolui conforme o algoritmo é treinado, sem que o titular tenha sido consultado sobre o novo uso.

A portaria ANPD nº 5/2024: O primeiro ato específico para IA

Em 2024, a ANPD deu um passo historicamente significativo: publicou a Portaria nº 5/2024, o primeiro ato normativo da autoridade diretamente voltado para inteligência artificial. Três exigências estruturais definem o novo regime:

Documentação de fontes de treinamento: empresas que desenvolvem ou utilizam IA devem manter logs do uso de bases de dados pessoais nos processos de treinamento. A ideia é simples e revolucionária: rastrear, do dado ao modelo, a cadeia de custódia da informação que gerou o algoritmo que toma decisões sobre pessoas.

Sistemas explicáveis: algoritmos que tomam ou influenciam decisões com efeitos sobre titulares devem fornecer justificativas em linguagem acessível. Isso tem uma implicação técnica direta: arquiteturas de caixa-preta pura tornaram-se regulatoriamente problemáticas no Brasil.

Auditorias periódicas de viés: as organizações devem demonstrar, de forma proativa e documentada, que estão monitorando e mitigando discriminação automatizada. Não basta dizer que o sistema é justo. Precisa provar.

O cenário de enforcement em 2024–2025 confirmou que os setores mais autuados são exatamente os que mais adotam IA: serviços de saúde, e-commerce e fintechs. E o STJ consolidou um entendimento que coloca as empresas em alerta máximo: a responsabilidade civil por vazamento de dados independe de culpa (Art. 42, LGPD). Se o dado vazou e o titular foi prejudicado, a empresa responde. Mesmo que não tenha sido negligente.

O PL 2338/2023 e o futuro da regulação de IA no Brasil

O projeto de lei 2338/2023, em tramitação no Congresso Nacional, é o principal esforço brasileiro para criar um marco regulatório específico para IA. Inspirado parcialmente no EU AI Act, o projeto adota uma abordagem baseada em risco, com obrigações graduadas conforme o potencial de impacto dos sistemas sobre direitos fundamentais. Não por acidente, os setores de saúde e financeiro figuram entre os de mais alta classificação de risco no texto.

Paralelamente, o Plano Brasileiro de Inteligência Artificial 2024–2028 (PBIA) prevê investimentos de R$ 23 bilhões até 2028, com aproximadamente um terço dos 31 projetos previstos focados em saúde — diagnósticos pelo SUS, teleconsultas automatizadas, dispositivos preditivos para doenças complexas. O Brasil não está assistindo à revolução da IA: está apostando nela, em escala de política pública.

A análise da International Bar Association (IBA) de 2025 aponta que o Brasil conta com mais de 500 produtos de software registrados para fins diagnósticos ou terapêuticos — dezenas deles com funcionalidades de IA —, todos sob regime de dupla conformidade: LGPD/ANPD para governança de dados e ANVISA para segurança e eficácia do dispositivo. A janela para consolidar esse framework antes que o volume de produtos torne o caos incontrolável está se fechando.

Os protocolos: O que fazer na segunda-feira de manhã

Chega de diagnóstico. Aqui está o tratamento.

Existe uma tentação, ao final de um artigo sobre regulação, de concluir com abstração: “as organizações devem investir em governança”, “é necessária uma cultura de conformidade”, “o equilíbrio entre inovação e regulação é essencial”. Tudo verdade. Tudo inútil sem ação concreta.

O que se segue são os protocolos práticos, derivados dos marcos regulatórios analisados e das melhores práticas documentadas pela academia e pelo mercado. São a resposta para a pergunta que todo CTO, jurista e executivo de saúde deve fazer a si mesmo: o que eu faço agora?

Protocolo 1: Privacy by Design Não é filosofia — É arquitetura

O GDPR cunhou o termo. A LGPD o incorporou. O EU AI Act o transformou em obrigação legal. Privacy by Design significa que privacidade e segurança são incorporadas antes da primeira linha de código ser escrita — não como camada adicional depois que o produto já existe.

Na prática: threat modeling na fase de arquitetura (antes do desenvolvimento); data minimization rigorosa — coletar apenas os dados estritamente necessários para a função do sistema; e técnicas de federated learning e differential privacy quando os dados são especialmente sensíveis. Federated learning permite treinar modelos em dados distribuídos sem transferi-los para um servidor central — múltiplos hospitais treinando um modelo diagnóstico compartilhado sem que um paciente saia de sua instituição de origem.

Protocolo 2: O ciclo de vida do modelo é uma obrigação legal

Todo modelo de IA em produção em um ambiente regulamentado precisa de um ciclo de vida formal e documentado. Seis fases, sem exceção:

- Coleta e pré-processamento — com documentação de proveniência e representatividade dos dados

- Desenvolvimento e treinamento — com rastreabilidade de versões

- Validação independente — com testes de viés e segurança por equipe separada

- Aprovação e deployment — com registro formal e comunicação regulatória quando exigida

- Monitoramento contínuo — com alertas de deriva e degradação

- Descomissionamento — com destruição certificada de dados e documentação de encerramento

A ausência de qualquer dessas fases não é uma lacuna de processo. É uma lacuna de conformidade — com as consequências legais que isso implica.

Protocolo 3: Criptografia e controles técnicos mínimos

AES-256 para dados em repouso. TLS 1.3 para dados em trânsito. Gestão segura de chaves criptográficas com rotação periódica. Controles específicos para ambientes de nuvem. Isso não é opcional — é o patamar mínimo exigido pelos regulamentos analisados. E o dado é eloquente: 98% das organizações de saúde com criptografia adequada recuperaram-se de ataques de ransomware em 2024. A criptografia não é custo. É seguro de vida.

Protocolo 4: Trilhas de auditoria que sobrevivem ao tempo

Reguladores exigem conformidade retrospectiva: a capacidade de reconstruir o processo decisório de qualquer sistema de IA em qualquer ponto do passado. Isso exige logs imutáveis de todos os acessos a dados e decisões do sistema, retidos pelo período exigido por cada jurisdição, com protocolos documentados para cooperação com autoridades durante inspeções. Nos tribunais, a ausência de logs é evidência de culpa.

Protocolo 5: O fator humano que nenhum algoritmo resolve

Trinta por cento das grandes violações de dados de saúde em 2024 foram causadas por ameaças internas ou uso indevido por pessoal autorizado. Trinta e um por cento dos casos de perda de dados foram causados por erros humanos. Os algoritmos podem ser perfeitos; os humanos que os operam não são.

Programas eficazes de conformidade para IA treinam distintas audiências com linguagens distintas: desenvolvedores precisam entender as implicações de privacidade de cada arquitetura técnica; equipes jurídicas precisam entender o que os modelos efetivamente fazem; liderança executiva precisa compreender os riscos estratégicos e reputacionais. O treinamento precisa ser contínuo, atualizado e testado — não um slide deck anual que ninguém lembra.

O algoritmo que nós escolhemos ser

No final, a questão não é técnica. É moral. Que tipo de decisão queremos que os algoritmos tomem em nosso nome?

Volte ao motorista de 43 anos que abriu este artigo — o que teve crédito negado por um algoritmo sem rosto. E à paciente de 67 anos cujo diagnóstico foi atrasado por um modelo com viés de treinamento. Eles não são vítimas de tecnologia. São vítimas de decisões humanas sobre como a tecnologia deveria — ou não deveria — ser construída.

A inteligência artificial em setores de alto impacto não é boa nem má por natureza. É neutra no design, carregada nas escolhas. Cada decisão sobre quais dados coletar, como treinar o modelo, quem validar o sistema, que limiares aceitar — é uma decisão moral com consequências reais para pessoas reais. A conformidade regulatória não é o teto dessas escolhas. É o piso.

Cinco lições emergem desta análise como imperativos irrefutáveis. Primeiro: a era da conformidade voluntária para IA em setores regulamentados acabou — o EU AI Act, o FS AI RMF americano e a Portaria ANPD nº 5/2024 são apenas os primeiros instrumentos de uma nova arquitetura normativa global. Segundo: o custo de uma violação de dados — em média USD 6,08 milhões no financeiro e USD 9,77 milhões na saúde — incorpora não apenas remediação técnica, mas multas regulatórias que podem ser igualmente devastadoras. Segurança não é custo: é mitigação de passivo. Terceiro: a explicabilidade algorítmica migrou de diferencial técnico para requisito legal — sistemas de caixa-preta que decidem sobre crédito e saúde são juridicamente incompatíveis com GDPR, LGPD e EU AI Act. Quarto: o Brasil vive uma janela crítica — R$ 23 bilhões previstos em IA até 2028, com 500+ produtos de IA clínica já registrados na ANVISA, exigem a urgente consolidação de um framework regulatório robusto antes que o volume supere a capacidade de governança. Quinto: conformidade e inovação não são opostos. São complementos — e as organizações que investem em governança robusta de IA constroem um ativo que vale mais do que qualquer modelo: confiança.

“A pergunta não é se a sua IA está otimizada. A pergunta é se ela é justa, explicável e segura — para as pessoas cujas vidas ela decide.”

O motorista de 43 anos ainda está esperando uma resposta. A paciente de 67 anos talvez não possa mais esperar. Os algoritmos que construímos hoje são a infraestrutura moral de amanhã. Temos a tecnologia, o conhecimento regulatório e os protocolos necessários para construí-los bem.

A questão é se escolhemos fazê-lo.

Fontes

Todas as fontes abaixo foram verificadas em março de 2026. Os links são diretos às publicações originais.

Regulação Global — EU AI Act

- Regulamento (UE) 2024/1689 — EU AI Act. Official Journal, junho 2024. https://artificialintelligenceact.eu/annex/3/

- EIOPA. Regulatory Framework Applicable to AI Systems in Insurance. Julho 2024. https://www.eiopa.europa.eu/document/download/b53a3b92-08cc-4079-a4f7-606cf309a34a_en

- Goodwin Law. EU AI Act: Key Points for Financial Services. Agosto 2024. https://www.goodwinlaw.com/en/insights/publications/2024/08/alerts-practices-pif-key-points-for-financial-services-businesses

- Goodwin Law. The Evolving Landscape of AI Regulation in Financial Services. Junho 2025. https://www.goodwinlaw.com/en/insights/publications/2025/06/alerts-finance-fs-the-evolving-landscape-of-ai-regulation

- Eurofi. AI Act: Key Measures and Implications for Financial Services. Dezembro 2024. https://www.eurofi.net/wp-content/uploads/2024/12/ii.2-ai-act-key-measures-and-implications-for-financial-services.pdf

- Skadden. How Regulators Worldwide Are Addressing AI in Financial Services. Dezembro 2023. https://www.skadden.com/insights/publications/2023/12/how-regulators-worldwide-are-addressing-the-adoption-of-ai-in-financial-services

- Harvard Data Science Review (MIT Press). Credit Underwriting and Insurance Under the EU AI Act. 2025. https://hdsr.mitpress.mit.edu/pub/19cwd6qx

- MDPI Risks. Algorithmic Bias Under the EU AI Act: Life and Health Insurance. Agosto 2025. https://www.mdpi.com/2227-9091/13/9/160

- Blue Arrow. How the EU AI Act Will Impact Insurance. Dezembro 2025. https://bluearrow.ai/ai-act-and-insurance/

- Browne Jacobson. EU AI Act: What Does It Mean for Insurers? Abril 2024. https://www.brownejacobson.com/insights/the-word-april-2024/eu-ai-act

NIST e Frameworks de Risco

- NIST. AI Risk Management Framework 1.0. Janeiro 2023. https://www.nist.gov/itl/ai-risk-management-framework

- NIST AI 100-1. Artificial Intelligence Risk Management Framework. 2023. https://nvlpubs.nist.gov/nistpubs/ai/nist.ai.100-1.pdf

- U.S. Department of the Treasury. Treasury Releases FS AI RMF. Fevereiro 2025. https://home.treasury.gov/news/press-releases/sb0401

- American Banker. Treasury Issues New AI Risk Tools for Banks. Fevereiro 2025. https://www.americanbanker.com/news/treasury-issues-new-ai-risk-tools-for-banks

- BIS Financial Stability Institute. Regulating AI in the Financial Sector. FSI Insights No. 63. Dezembro 2024. https://www.bis.org

HIPAA e IA na Saúde

- Foley & Lardner. HIPAA Compliance for AI in Digital Health. Maio 2025. https://www.foley.com/insights/publications/2025/05/hipaa-compliance-ai-digital-health-privacy-officers-need-know/

- Konnoth, C. AI and Data Protection Law in Health. NCBI Bookshelf, 2024. https://www.ncbi.nlm.nih.gov/books/NBK613196/

- arXiv. Towards a HIPAA Compliant Agentic AI System in Healthcare. Abril 2025. https://arxiv.org/html/2504.17669v1

- arXiv. Implications of AI on Health Data Privacy. 2025. https://arxiv.org/pdf/2501.01639

- PMC / Royal Society. Ethical and Legal Considerations in Healthcare AI. Maio 2025. https://pmc.ncbi.nlm.nih.gov/articles/PMC12076083/

- Tovino, Stacey A. Artificial Intelligence and the HIPAA Privacy Rule. Houston Journal of Health Law & Policy, 2025. https://digitalcommons.law.ou.edu/cgi/viewcontent.cgi?article=1648&context=fac_articles

- Censinet. The Future of HIPAA Audits: AI, APIs and Automation. Dezembro 2025. https://censinet.com/perspectives/the-future-of-hipaa-audits-are-you-ready-for-ai-apis-and-automation

LGPD, ANPD e Marco Brasileiro

- LEC. LGPD em 2024: O Que Mudou e o Que Está Por Vir. Junho 2024. https://lec.com.br/lgpd-em-2024-o-que-mudou-nos-ultimos-anos-e-o-que-esta-por-vir/

- Revista de Fiscalização Tecnológica. Proteção de Dados e Privacidade na Era da IA sob a LGPD. 2024. https://revistaft.com.br/protecao-de-dados-e-privacidade-na-era-da-inteligencia-artificial-desafios-normativos-no-tratamento-de-dados-pessoais-por-sistemas-de-ia-sob-a-perspectiva-da-lgpd/

- International Bar Association. AI and Digital Health in Brazil. 2025. https://www.ibanet.org/ai-digital-health-brazil

- GRS Advocacia. Proteção de Dados em 2025: Panorama da LGPD no Brasil. 2025. https://grsadv.com.br/protecao-de-dados-em-2025-o-panorama-atual-da-lgpd-no-brasil/

- DPOnet. Regulação e IA na Saúde: Desafios Legais e Conformidade. Junho 2025. https://blog.dponet.com.br/regulacao-e-inteligencia-artificial-na-saude-desafios-legais-e-conformidade/

- DPOnet. Proteção de Dados: Avanços em 2024 e Tendências para 2025. 2025. https://blog.dponet.com.br/protecao-de-dados-avancos-2024-tendencias-2025/

Custos de Violações e Relatórios Setoriais

- IBM. Cost of a Data Breach 2024: Financial Industry. Novembro 2024. https://www.ibm.com/think/insights/cost-of-a-data-breach-2024-financial-industry

- Compunnel. AI and Data Security Compliance in 2024. Fevereiro 2025. https://www.compunnel.com/blogs/the-intersection-of-ai-and-data-security-compliance-in-2024/

- Wolters Kluwer. Building Trustworthy AI Governance. Janeiro 2026. https://www.wolterskluwer.com/en/expert-insights/building-trustworthy-ai-governance

- Corporate Compliance Insights. 2026 Guide to Cybersecurity and AI Governance. Janeiro 2026. https://www.corporatecomplianceinsights.com/2026-operational-guide-cybersecurity-ai-governance-emerging-risks/

- InnReg. AI in Financial Services: Use Cases and Compliance. 2024. https://www.innreg.com/blog/ai-in-financial-services

- GDPR Local. The Future of Finance: AI and Data Privacy Laws. Janeiro 2025. https://gdprlocal.com/the-future-of-finance-adapting-to-ai-and-data-privacy-laws/

- TechMagic. HIPAA Compliance AI: Using LLMs Safely in Healthcare. Julho 2025. https://www.techmagic.co/blog/hipaa-compliant-llms