O problema da operacionalização do aprendizado de máquina

A inteligência artificial deixou de ser uma disciplina predominantemente acadêmica para se tornar uma tecnologia pervasiva adotada por indivíduos e organizações em todos os setores. Análises de mercado recentes apontam que o número de usuários diários de IA cresceu de 116 milhões em 2020 para 314 milhões em 2024, com projeções estimando cerca de 730 milhões de usuários diários até 2030. Esse crescimento vertiginoso é impulsionado pela disponibilidade massiva de dados, pelo aumento do poder computacional e pelo desenvolvimento de algoritmos cada vez mais eficientes.

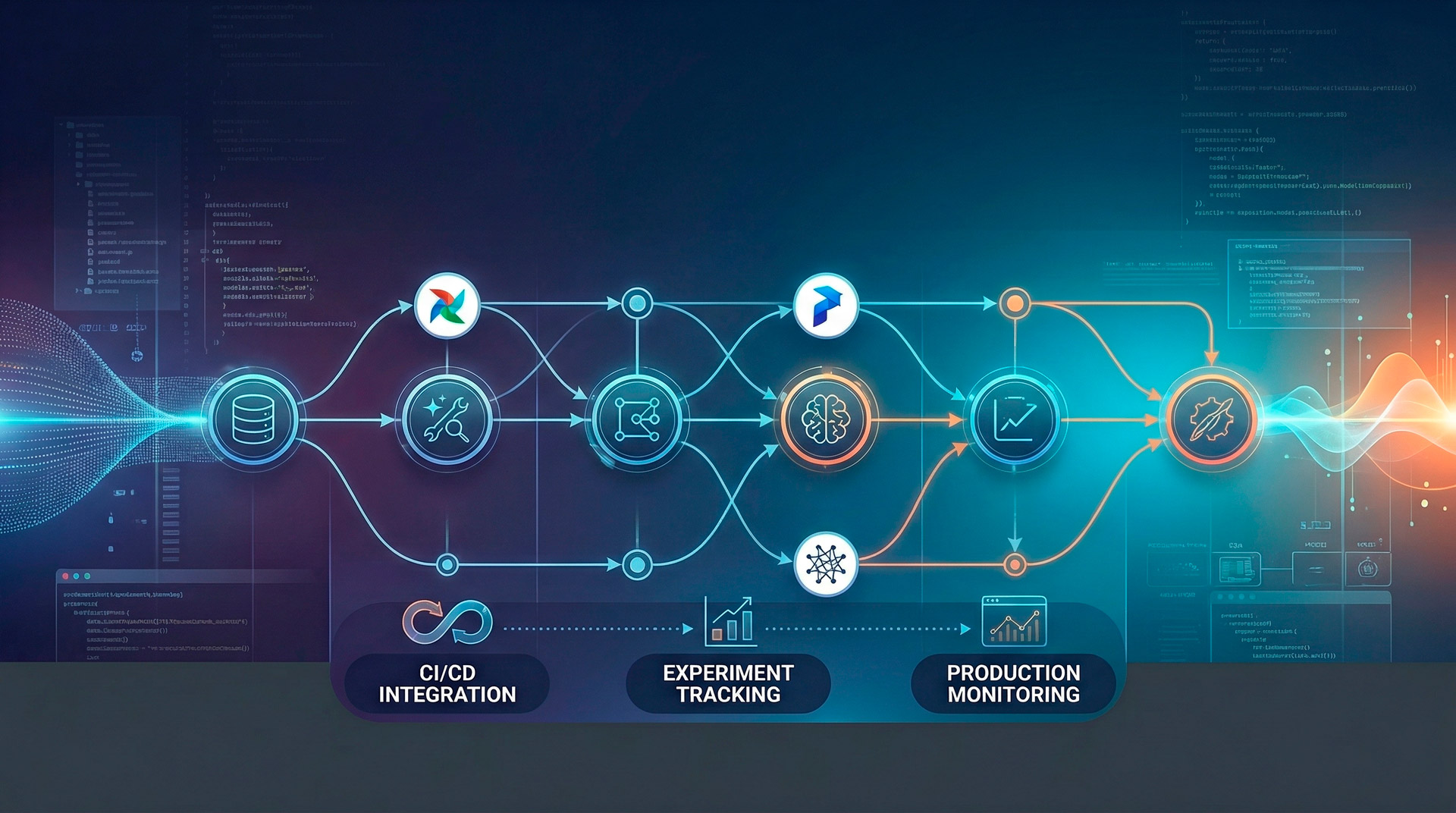

Entretanto, construir modelos de machine learning (ML) em ambiente de experimentação é apenas uma pequena fração do trabalho real. A grande dificuldade reside em levar esses modelos para produção de forma confiável, reprodutível e escalável. É nesse ponto que o campo de Machine Learning Operations (MLOps) emerge como disciplina fundamental, estendendo os princípios do DevOps ao ciclo completo de vida dos modelos de ML. O MLOps visa padronizar, automatizar e escalar o desenvolvimento, a validação, o deployment e o monitoramento de modelos em produção, incorporando práticas como integração e entrega contínua (CI/CD), rastreabilidade de experimentos e gestão de ambiente.

No centro de qualquer estratégia de MLOps sólida está a orquestração de pipelines. Um pipeline de ML é, em essência, uma cadeia de transformações sobre dados que culmina na geração ou atualização de um modelo preditivo. Sem orquestração adequada, esses processos tornam-se frágeis, difíceis de reproduzir e lentos para iterar. As ferramentas de orquestração fornecem as estruturas e interfaces para criar e gerenciar a infraestrutura de workflows e seus pipelines.

Neste artigo, examinamos em profundidade três das ferramentas mais relevantes nesse espaço: Apache Airflow, Prefect e Metaflow. Cada uma delas representa uma filosofia diferente sobre como os pipelines de ML devem ser definidos, executados e monitorados. Compreender essas diferenças é essencial para equipes que buscam construir infraestrutura de ML robusta e duradoura.

O conceito de DAG e sua centralidade nos pipelines de ML

Antes de mergulhar nas ferramentas, é preciso entender a estrutura matemática que as sustenta: o Grafo Acíclico Dirigido, ou DAG (do inglês Directed Acyclic Graph). Em ciência da computação, um grafo é uma estrutura de dados não linear composta por nós e arestas. Nós representam entidades individuais, enquanto arestas conectam esses nós e representam relações entre eles.

Um DAG é um grafo dirigido sem ciclos. “Dirigido” significa que as arestas têm direção, indicando que uma operação deve ser concluída antes que outra comece. “Acíclico” significa que uma vez que você parte de um nó, só pode avançar, nunca retornando a um nó anterior. Essa propriedade é o que garante que os pipelines possam ser executados sem loops infinitos ou dependências recursivas.

Em aprendizado de máquina, um pipeline ou workflow nada mais é do que um DAG. Considere uma sequência típica: ingestão de dados brutos, limpeza e pré-processamento, engenharia de atributos, treinamento do modelo, avaliação e, finalmente, deployment. Cada etapa depende da anterior, e nenhuma etapa posterior pode acontecer sem que as anteriores tenham sido concluídas. Essa estrutura se encaixa perfeitamente na definição de DAG.

Pesquisas recentes em sistemas distribuídos destacam que os workflows de ML modernos são naturalmente expressos como DAGs de tarefas interdependentes de granulação fina, incluindo preparação de dados, fine-tuning supervisionado, modelagem de recompensa, ajuste de política e avaliação. Essa estrutura gráfica inerente facilita otimizações significativas no nível de sistema, herdadas de décadas de trabalho em compiladores e otimizadores de consultas.

A importância dos DAGs vai além da organização visual. Eles permitem a execução paralela de tarefas independentes, o gerenciamento preciso de dependências e a reproducibilidade, já que cada execução segue o mesmo grafo de transformações. Ferramentas como Apache Airflow, Prefect e Metaflow adotam o paradigma de DAG como princípio organizador central, embora com diferentes graus de rigidez e diferentes mecanismos de definição.

Apache Airflow: O padrão consolidado da indústria

Origem e arquitetura

O Apache Airflow foi criado originalmente na Airbnb em 2014 para resolver o problema de agendamento e monitoramento de workflows complexos de engenharia de dados. Posteriormente, foi doado à Apache Software Foundation, onde é atualmente mantido como projeto de nível superior sob a licença Apache 2.0. Hoje, o Airflow é usado por empresas como PayPal, Twitter, Google e muitas outras organizações de grande escala.

A principal força do Airflow reside na definição declarativa de workflows complexos por meio de DAGs escritos em Python. Isso confere ao usuário controle total sobre dependências, execução e agendamento. Cada workflow é um DAG no qual os nós representam tarefas e as arestas definem dependências. Essa declaração explícita de dependências garante que as tarefas se executem na ordem correta e permite padrões sofisticados de agendamento.

O modelo de operadores do Airflow oferece flexibilidade notável para a execução de tarefas. A plataforma inclui operadores para tarefas comuns como execução de funções Python, execução de consultas SQL ou acionamento de sistemas externos. O extenso ecossistema de operadores cobre os principais provedores de nuvem, bancos de dados e plataformas de ML. O agendador do Airflow monitora continuamente as definições de DAG e aciona tarefas quando suas dependências são satisfeitas, tratando cenários complexos como reexecuções de tarefas, timeouts e monitoramento de SLA.

Em termos de escalabilidade, o Airflow escala horizontalmente usando executores como Celery ou Kubernetes para gerenciar tarefas concorrentes. O estado e as dependências das tarefas são gerenciados por meio de um sistema de metadados armazenado em banco de dados relacional, tipicamente PostgreSQL ou MySQL. Cada tarefa armazena informações como seu estado (sucesso, falha, reexecução), duração e logs.

Integração com o ecossistema MLOps

O Apache Airflow se posiciona como o coração do stack moderno de MLOps, orquestrando todo o ciclo de vida do aprendizado de máquina. Por ser agnóstico a ferramentas, o Airflow pode orquestrar todas as ações em qualquer ferramenta de MLOps que possua uma API. Combinado ao fato de já ser o padrão de fato para orquestrar pipelines de dados, o Airflow se torna uma escolha natural para engenheiros de dados e de ML padronizarem seus workflows e colaborarem nos pipelines.

Entre os recursos especialmente úteis para MLOps estão o monitoramento e alertas de produção, que incluem módulos extensivos de logging e listeners; o suporte a dependências complexas e lógica de ramificação; e a capacidade de tornar pipelines dinâmicos. O Airflow permite também definir tarefas de setup e teardown que criam e removem recursos utilizados para o aprendizado de máquina, estendendo o conceito de infraestrutura como código ao ambiente de ML.

A ramificação condicional é outro recurso valioso: o Airflow permite bifurcar o DAG com base no resultado de uma tarefa. Por exemplo, é possível ramificar com base no desempenho de um modelo em um conjunto de teste e só fazer o deployment se o modelo superar determinado limiar de desempenho. Isso é fundamental em pipelines de ML reais, onde a decisão de promover um modelo para produção depende de métricas dinâmicas.

A avaliação empírica publicada no arXiv em janeiro de 2026 destaca que o Airflow se destaca por suas fortes capacidades de integração. Como orquestrador de workflows amplamente adotado em ambientes empresariais, inclui um grande número de operadores nativos para interagir com serviços como PostgreSQL, MySQL, Amazon S3, Docker e Spark. A sincronização de DAGs com sistemas de CI/CD como GitHub Actions é alcançada sem dificuldades, demonstrando boa compatibilidade. Graças à sua arquitetura modular e suporte a extensões, o Airflow é especialmente adequado para ambientes empresariais complexos.

Limitações e críticas

Apesar de sua popularidade, o Airflow apresenta limitações importantes. A curva de aprendizado para iniciantes é íngreme, e a plataforma não é adequada para processamento de dados em tempo real. Pode ser também intensiva em recursos, exigindo gerenciamento cuidadoso de infraestrutura. A arquitetura centralizada do agendador e os múltiplos componentes exigem infraestrutura dedicada com padrões de deployment complexos.

A necessidade de reestruturar o código em objetos DAG, operadores e mecanismos como XCom para passagem de dados entre tarefas gera sobrecarga de desenvolvimento significativa. Para equipes que não estão familiarizadas com a abstração de DAG do Airflow, a produtividade inicial pode ser baixa. Além disso, a arquitetura centralizada do scheduler pode se tornar um gargalo de desempenho em pipelines com muitas tarefas paralelas.

Prefect: Orquestração moderna e centrada em Python

Filosofia e evolução

O Prefect surgiu como uma resposta direta às limitações do Airflow, posicionando-se frequentemente como uma alternativa mais moderna e menos burocrática. A filosofia central do Prefect é que workflows reais do mundo real nem sempre cabem em estruturas de DAG pré-planejadas e estáticas: às vezes é preciso atualizar a definição de um trabalho com base em informações de tempo de execução, por exemplo, pulando um ramo do workflow.

A versão 2.0 do Prefect, lançada em 2022, representou uma virada conceitual ao remover a restrição de que os workflows precisem ser escritos explicitamente como DAGs, abraçando completamente o fluxo de controle nativo do Python: condicionais if/else, laços while e tudo que torna o Python, Python. Em 2024, o Prefect 3.0 expandiu ainda mais essa abordagem ao tornar o backend de eventos e automações open source, permitindo que usuários representem nativamente workflows orientados a eventos e obtenham observabilidade adicional sobre sua execução.

A arquitetura do Prefect é descrita como direta e elegante: o workflow é código Python. Quando executado, um agente na infraestrutura do usuário inicializa um container, o código é executado, e o SDK do Prefect envia atualizações de status. O DAG pode ser construído dinamicamente conforme o código é executado. Precisa gerar 100 tarefas paralelas com base em uma consulta de banco de dados? Basta escrever um laço for. O ambiente de execução é efêmero, com cada execução recebendo um estado limpo.

Modelo híbrido de execução

Uma diferença arquitetural importante do Prefect em relação ao Airflow é seu modelo híbrido de orquestração. O Prefect separa orquestração de execução: a orquestração é gerenciada pela plataforma Prefect Cloud ou por um servidor auto-hospedado, enquanto a execução ocorre na infraestrutura do próprio usuário. Trabalhadores (“workers”) consultam a API do Prefect por conexões de saída exclusivamente, sem necessidade de acesso de entrada à rede do usuário. O código, os dados e os segredos permanecem na infraestrutura do usuário.

Esse modelo tem implicações práticas significativas para segurança e custos. Equipes que migraram do Airflow para o Prefect relataram reduções de 60 a 70% nos custos de infraestrutura. Em um caso documentado, a troca de uma plataforma baseada em Airflow pelo Prefect resultou em redução de 73,78% nos custos de faturamento de infraestrutura. A razão é que o modelo híbrido faz o usuário pagar apenas pela computação quando os workflows estão sendo executados, ao contrário da arquitetura centralizada do Airflow, que exige infraestrutura dedicada permanentemente ativa.

Dinâmica e orientação a eventos

O Prefect é particularmente adequado para times de IA modernos que trabalham com agentes e sistemas de raciocínio. Isso ocorre porque agentes de IA são máquinas de estado que decidem seu próximo passo em tempo de execução, enquanto orquestradores tradicionais exigem DAGs pré-compilados. O Prefect segue o fluxo de controle do Python com laços while, ramificações em tempo de execução e lógica condicional. A ausência de grafos pré-compilados significa que máquinas de estado de agentes funcionam nativamente.

Outras capacidades relevantes para ML incluem suporte a workflows interativos, onde agentes podem pausar e aguardar entrada humana com tipo seguro por meio de formulários gerados automaticamente na interface; fluxos de aprovação, circuitos de feedback e portões de conformidade funcionando nativamente sem infraestrutura personalizada; e wrapping de agentes de IA com execução durável, incluindo reexecuções automáticas, cache de resultados e observabilidade em nível de tarefa.

A comunidade do Prefect registrou crescimento expressivo. Em 2024, o repositório oficial do Prefect no GitHub alcançou mais de 15.000 estrelas, sendo classificado como o terceiro projeto de orquestração de workflows mais estrelado do ano. A atividade de desenvolvimento também foi intensa, com mais de 10.000 commits registrados ao longo de 2024.

Casos de uso ideais

O Prefect se destaca para equipes que precisam de orquestração flexível e nativa em Python, para pipelines que envolvem lógica dinâmica difícil de expressar como DAGs estáticos, e para organizações que desejam manter controle total sobre sua infraestrutura de execução enquanto delegam a lógica de orquestração para uma plataforma gerenciada. A facilidade de desenvolvimento local antes do deployment em produção, sem configurações complexas, é outro ponto forte muito citado por praticantes.

Metaflow: A abordagem centrada no cientista de dados

Origem na Netflix e open source

O Metaflow ocupa um nicho distinto no ecossistema de orquestração de ML. Desenvolvido originalmente pela Netflix para atender às necessidades de desenvolvedores e cientistas de dados que trabalham em projetos de ML, IA e ciência de dados da vida real, o Metaflow foi tornado open source em 2019. Desde então, foi adotado por centenas de empresas em diversos setores, desde GenAI de última geração até ciência de dados orientada a negócios, estatísticas e pesquisa operacional.

A filosofia central do Metaflow é explicitamente humanista: ser uma estrutura centrada no ser humano para ciência de dados. Isso significa que o design prioriza a produtividade do cientista de dados, permitindo escrever pipelines em Python de forma natural e escalável, sem sacrificar funcionalidades avançadas como versionamento, execução distribuída ou rastreamento de artefatos. Conhecimento básico de Python é suficiente para começar; não há necessidade de aprender outras linguagens de domínio específico.

Na Netflix, o Metaflow suporta mais de 3.000 projetos de IA e ML, executa centenas de milhões de trabalhos de computação de alto desempenho e com uso intensivo de dados, processando petabytes de dados e gerenciando dezenas de petabytes de modelos e artefatos para centenas de usuários nas equipes de IA, ML, ciência de dados e engenharia.

Gestão de artefatos e reprodutibilidade

Uma das características mais diferenciadas do Metaflow é seu armazenamento de artefatos endereçado por conteúdo embutido. Em termos simples, isso significa que o Metaflow pode carregar e armazenar artefatos como variáveis de instância Python comuns. Enquanto em muitos outros frameworks o carregamento e armazenamento de artefatos é deixado como exercício para o usuário, o que o força a decidir o que deve ou não ser persistido, o Metaflow remove essa sobrecarga cognitiva.

Variáveis criadas em um passo podem ser usadas diretamente no próximo sem serialização manual, graças a um sistema de persistência automático interno gerenciado pelo Metaflow, que permite recuperar artefatos entre passos de forma transparente por meio da API cliente do Metaflow (Metaflow Client). Isso favorece a rastreabilidade e a reprodutibilidade dos workflows, já que todos os artefatos são registrados automaticamente.

O Metaflow também oferece uma forma direta de versionar e auditar execuções de treinamento. Por meio da API cliente, é possível instanciar um determinado passo de um fluxo anterior passando apenas o nome do fluxo, o ID de execução e o nome do passo. Isso significa que toda vez que um fluxo é executado, o Metaflow automaticamente versiona e registra a execução usando uma taxonomia padrão. Como resultado, é possível rastrear a linhagem de qualquer modelo dado, desde os dados brutos até a exportação final.

Escalabilidade e integração com nuvem

O Metaflow é descrito como uma estrutura nativa de nuvem que aproveita a elasticidade da nuvem por design, tanto para computação quanto para armazenamento. Os workflows podem ser executados localmente ou escalados automaticamente em serviços de nuvem como AWS Batch, Step Functions ou Kubernetes, embora a integração seja especialmente otimizada para AWS. Para os usuários, escalar de um laptop para a nuvem é tão simples quanto adicionar um único decorador ao código.

A Netflix hospeda seu principal data lake no S3 como tabelas Apache Iceberg e usa Apache Spark para ETL. A biblioteca Fast Data do Metaflow permite acesso rápido, escalável e robusto ao data warehouse da Netflix, aproveitando componentes de alto desempenho do ecossistema Python de dados. Essa biblioteca permite processar terabytes de dados coletivamente e codificar relações complexas entre títulos, atores e outros atributos de conteúdo.

O orquestrador de produção da Netflix, Maestro, desempenha papel crítico no gerenciamento de projetos Metaflow em produção. Ele suporta escalabilidade e alta disponibilidade e permite integração perfeita de fluxos Metaflow com outros sistemas por meio de acionamento por eventos. O Metaflow também oferece um serviço integrado de hospedagem de modelos que fornece uma interface fácil de usar sobre a infraestrutura de microsserviços existente da Netflix, permitindo que cientistas de dados movam rapidamente seu trabalho da experimentação para um serviço web de nível de produção acessível por API REST.

Posicionamento e limitações

O Metaflow é especialmente adequado para equipes de ciência de dados que desejam se concentrar em modelagem em vez de infraestrutura, para organizações que precisam de rastreabilidade e reprodutibilidade automáticas de experimentos, e para projetos que fazem uso intensivo da AWS. A facilidade de uso é um diferencial marcante: o suporte a workflows preferidos por cientistas de dados, partindo de Jupyter Notebooks e depois desenvolvendo com Metaflow, com teste e depuração local enquanto os resultados são armazenados e rastreados automaticamente, reduz significativamente o atrito de adoção.

Entre as limitações, está o fato de que a integração é especialmente otimizada para AWS, sendo que uso em outras nuvens como GCP ou Azure pode exigir mais configuração manual. Organizar projetos grandes com Metaflow pode ser desafiador, e o código pode se tornar confuso devido ao uso excessivo de decoradores. O suporte nativo para Windows não está disponível, exigindo que usuários Windows usem o Subsistema do Windows para Linux (WSL).

Análise comparativa: quando usar cada ferramenta

Maturidade e adoção

Em termos de adoção, o Apache Airflow domina o ecossistema com margem expressiva. Em 2024, o Airflow registrou impressionantes 320 milhões de downloads no PyPI, dez vezes mais do que seu concorrente mais próximo. O repositório do Airflow e o do Dagster lideraram em atividade de pull requests, processando cada um mais de 10.000 PRs de seus contribuidores, com o Prefect logo atrás. O Airflow e o Dagster lideraram o ecossistema em contribuidores ativos, com mais de 20 cada um.

Essa diferença de maturidade tem consequências práticas. O Airflow possui uma comunidade maior, mais recursos disponíveis além da documentação oficial, e mais integrações prontas para uso. Para organizações que já usam o Airflow para workflows de engenharia de dados, aproveitar o conhecimento existente e a tooling desenvolvida ao longo do tempo para também orquestrar pipelines de ML é uma vantagem significativa.

Curva de aprendizado e experiência do desenvolvedor

O Prefect é frequentemente descrito como “Airflow, mas mais agradável”. Possui uma interface mais limpa, configuração mais fácil e menos obstáculos porque é fundamentalmente melhor construído para um ambiente de dados mais moderno e dinâmico. É uma escolha sólida para equipes que estão começando com orquestração ou para qualquer pessoa cansada de cuidar de workflows desatualizados.

O Metaflow tem a curva de aprendizado mais suave para cientistas de dados que conhecem Python mas têm pouca experiência com infraestrutura. O foco deliberado em usabilidade e ergonomia, com uma API unificada para a infraestrutura, faz com que o Metaflow seja mais fácil de adotar do zero para perfis técnicos não especializados em engenharia de dados.

O Airflow exige que o desenvolvedor reestruture código Python existente em DAGs, operadores e mecanismos como XCom. Essa indireção pode ser confusa inicialmente, mas oferece grande controle e expressividade para workflows empresariais complexos. A curva é íngreme, mas a recompensa em termos de controle e visibilidade é substancial.

Reprodutibilidade e rastreamento de experimentos

A reprodutibilidade é uma das preocupações centrais do MLOps. Pesquisas mostram que a percepção favorável das práticas de MLOps, incluindo orquestração de workflows, reprodutibilidade e versionamento, corresponde a maior satisfação e confiança nos sistemas de ML, independentemente do escalonamento organizacional.

O Metaflow lidera nessa dimensão por tratar rastreamento e versionamento de artefatos como características de primeira classe, integradas ao framework sem configuração adicional. Todo experimento é automaticamente versionado e auditável. O Airflow oferece rastreabilidade por meio de execuções versionadas e registradas, mas o rastreamento de artefatos e modelos requer integração com ferramentas externas como MLflow. O Prefect oferece rastreamento de estado sólido para cada tarefa e execução, mas o rastreamento de artefatos de ML também depende de integrações externas.

Escalabilidade e contextos de deployment

O Airflow escala horizontalmente por meio de executores Celery ou Kubernetes e é adequado para pipelines que envolvem ETL complexo ou que já utilizam o Airflow para engenharia de dados. O Metaflow foi projetado para escalar de um laptop para a nuvem com mudanças mínimas de código, sendo particularmente eficiente para cargas de trabalho de treinamento de ML intensivas em computação. O Prefect oferece modelo de execução flexível que pode rodar localmente, em containers, em Kubernetes ou na nuvem com comportamento consistente, sendo especialmente eficiente em termos de custo de infraestrutura.

Adequação para diferentes perfis de equipe

A escolha da ferramenta de orquestração deve considerar o perfil predominante da equipe. Para equipes dominadas por engenheiros de dados com forte background em infraestrutura e que já gerenciam pipelines de ETL complexos, o Airflow é a escolha natural. Para equipes mistas de cientistas de dados e engenheiros de ML que desejam uma ferramenta unificada com pouca fricção de infraestrutura, o Metaflow oferece a melhor experiência. Para equipes modernas que trabalham com workflows dinâmicos, agentes de IA ou que precisam de forte controle sobre seus dados sem sacrificar a observabilidade, o Prefect é a opção mais adequada.

Uma análise comparativa de plataformas open source de orquestração de pipelines de ML, publicada como tese de bacharelado e disponível no ResearchGate, avalia várias plataformas incluindo Apache Airflow, Metaflow, Prefect e outras contra critérios tailored a contextos de negócios específicos. Os resultados mostram que não existe um único orquestrador universalmente superior: a escolha ideal depende de variáveis como tipo de carga de trabalho, experiência da equipe, requisitos de integração e restrições de custo de infraestrutura.

Desafios contemporâneos e tendências emergentes

LLMOps e a nova fronteira da orquestração

O campo está em rápida transformação. Um subconjunto emergente do MLOps, denominado LLMOps, concentra-se no desenvolvimento de pipelines em torno de aplicações de grandes modelos de linguagem (LLMs) como GPT-4 e outros. Em contraste com modelos de ML tradicionais, os LLMs frequentemente são muito grandes para serem treinados do zero, e as técnicas de LLMOps giram em torno de adaptar LLMs existentes a novos casos de uso por meio de fine-tuning e orquestração de sistemas de recuperação aumentada de geração (RAG).

O paradigma dominante no aprendizado de máquina aplicado está passando por uma transformação significativa, migrando do treinamento e inferência monolíticos e de etapa única para a orquestração de workflows complexos de múltiplos estágios. Esses workflows, englobando metodologias como Aprendizado por Reforço com Feedback Humano (RLHF), sistemas multiagente e workflows agênticos, são agora os principais impulsionadores da pesquisa e produção de LLMs. Eles são naturalmente expressos como DAGs de tarefas interdependentes de granulação fina.

O Prefect está especialmente bem posicionado para esse novo paradigma por sua capacidade de representar loops while, ramificações em tempo de execução e lógica condicional nativa, que refletem melhor a natureza das máquinas de estado dos agentes de IA do que os DAGs estáticos tradicionais. O Airflow, por sua vez, já oferece integrações com vetorbancos de dados como Weaviate para pipelines RAG automáticos.

A crise de reprodutibilidade e sua solução técnica

Uma pesquisa multivocal sobre práticas, desafios e questões abertas do MLOps, publicada no arXiv em 2025, identifica a reprodutibilidade como uma das práticas de maior impacto na satisfação com ferramentas de MLOps, com sete das relações estudadas sendo estatisticamente significativas. Oito tipos de definições para MLOps foram identificados na literatura existente, e em todas elas a reprodutibilidade aparece como desafio central.

A reprodutibilidade em ML é multidimensional: envolve reprodutibilidade do código, dos dados, do ambiente de execução e dos hiperparâmetros do modelo. Ferramentas de orquestração modernas abordam diferentes aspectos desse problema. O Metaflow resolve a reprodutibilidade de artefatos automaticamente. O Airflow resolve a reprodutibilidade de fluxo de trabalho por meio de execuções versionadas. O Prefect oferece caching de tarefas e rastreamento automático de estado. A combinação com ferramentas dedicadas como MLflow, DVC e sistemas de controle de versão de dados adiciona as camadas de reprodutibilidade que faltam em cada ferramenta isoladamente.

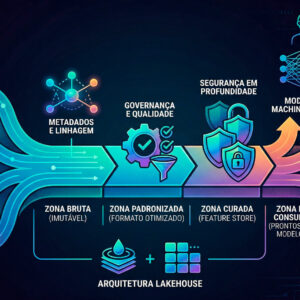

Integração com infraestrutura de dados moderna

A convergência de engenharia de dados e MLOps tornou-se a prática fundamental para construir processos de ML eficientes e seguros. Enquanto a engenharia de dados fornece as soluções necessárias para lidar com dados em termos de ingestão, transformação e armazenamento, o MLOps entrega as soluções para gerenciar modelos em termos de deployment, monitoramento e gestão. Juntos, esses campos auxiliam no tratamento dos desafios crescentes de lidar com enormes volumes de dados.

Nesse contexto, as ferramentas de orquestração precisam se integrar perfeitamente com componentes de infraestrutura como sistemas de armazenamento de objetos (S3, GCS), plataformas de computação distribuída (Kubernetes, AWS Batch), frameworks de processamento de dados (Apache Spark, Dask) e sistemas de controle de versão de dados (DVC, Delta Lake). O Airflow lidera nessa dimensão pela amplitude de seu ecossistema de operadores, mas o Metaflow e o Prefect oferecem integrações bem desenvolvidas com os serviços mais comuns.

Orquestração de workflows em produção

Um dos maiores desafios práticos é a transição de workflows de experimentação para produção. O Metaflow foi especificamente projetado para resolver esse problema: as integrações com os sistemas de produção da Netflix permitem que projetos passem do protótipo para a produção sem incorrer em sobrecarga operacional insustentável. Isso reflete uma filosofia de que diferentes projetos não devem necessariamente seguir o mesmo caminho do protótipo para a produção.

O Prefect adota uma abordagem similar ao permitir que o mesmo código seja executado localmente durante o desenvolvimento e em produção com mínimas mudanças de configuração. O Airflow, por sua vez, resolve esse problema por meio do conceito de DAG como código, que permite que a definição precisa do ambiente para uma operação de ML específica seja reprodutível, estendendo o conceito de infraestrutura como código ao ambiente de ML.

Perspectivas de pesquisa e direções futuras

A pesquisa acadêmica em orquestração de pipelines de ML está crescendo rapidamente. Uma avaliação empírica publicada no arXiv em janeiro de 2026, intitulada “An Empirical Evaluation of Modern MLOps Frameworks”, apresenta uma comparação prática e comparativa de ferramentas representativas (MLflow, Metaflow, Apache Airflow e Kubeflow Pipelines), implementando pipelines com cada ferramenta e definindo critérios objetivos para comparar desempenho, usabilidade, flexibilidade e adaptabilidade. Os autores identificam que a diversidade do ecossistema complica a tomada de decisão para equipes que buscam implementar pipelines robustos de MLOps.

Pesquisas futuras apontam para diversas direções promissoras. A automação da seleção de ferramentas de orquestração com base nas características do workflow e nos requisitos da equipe é uma área com potencial significativo. A integração mais profunda entre sistemas de orquestração e plataformas de monitoramento de modelos em produção, permitindo ciclos de retreinamento automático baseados em métricas de drift, também é um campo em desenvolvimento ativo.

A orquestração de workflows de IA agêntica representa talvez o maior desafio técnico emergente. Sistemas onde modelos de linguagem atuam como tomadores de decisão e orquestram outros modelos ou ferramentas requerem paradigmas de orquestração que vão além dos DAGs estáticos tradicionais. O Prefect está na vanguarda dessa transição com seu suporte a fluxos de controle dinâmicos, mas toda a indústria está ativamente explorando novos modelos de execução.

A sustentabilidade de projetos open source de orquestração também é um tema de pesquisa emergente. Projetos com poucos contribuidores ativos (menos de cinco) levantam preocupações de sustentabilidade. O Airflow, o Dagster e o Prefect demonstram saúde robusta nessa dimensão, mas a fragmentação do ecossistema em dezenas de ferramentas sobrepostas representa um desafio para a comunidade como um todo.

A orquestração de pipelines de ML é uma disciplina em rápida maturação, e as três ferramentas examinadas neste artigo representam abordagens distintas e complementares para um mesmo problema fundamental: como coordenar de forma confiável, reprodutível e escalável as muitas etapas que transformam dados brutos em modelos de ML em produção.

O Apache Airflow permanece como o padrão dominante da indústria, com uma base de adoção incomparável, ecossistema maduro e forte adequação para ambientes empresariais complexos. Sua curva de aprendizado é o principal obstáculo, mas as organizações que investem em dominar o Airflow colhem benefícios substanciais em controle e visibilidade.

O Prefect representa a evolução do paradigma de orquestração para as necessidades de equipes modernas que trabalham com workflows dinâmicos, agentes de IA e requisitos rigorosos de segurança de dados. Seu modelo híbrido e sua fidelidade ao Python nativo o posicionam bem para os desafios emergentes de LLMOps e workflows agênticos.

O Metaflow ocupa um nicho único como a ferramenta mais centrada no cientista de dados, com rastreamento automático de artefatos e reprodutibilidade integrada que tornam a transição de laboratório para produção significativamente menos dolorosa. Sua origem e otimização para AWS é uma consideração importante, mas a qualidade da experiência do desenvolvedor é reconhecidamente superior para o perfil de usuário que ele serve.

Em última análise, a escolha entre essas ferramentas não é uma questão de qual é objetivamente melhor, mas de qual filosofia melhor se alinha às necessidades, competências e restrições de cada organização. Muitas empresas optam por combinar ferramentas: Airflow para orquestração geral e pipelines de ETL, Metaflow para workflows de ciência de dados, e Prefect para casos de uso dinâmicos ou orientados a eventos. O que importa é que a orquestração deixe de ser um obstáculo e se torne um acelerador da entrega de valor por meio do aprendizado de máquina.

Fontes

- An Empirical Evaluation of Modern MLOps Frameworks (2026) — Avaliação comparativa empírica de MLflow, Metaflow, Apache Airflow e Kubeflow Pipelines.

https://arxiv.org/abs/2601.20415 - A Multivocal Review of MLOps Practices, Challenges and Open Issues (2025) — Revisão multivocal cobrindo 423 estudos sobre práticas, desafios e questões abertas no MLOps.

https://arxiv.org/abs/2406.09737 - Integrating Data Engineering and MLOps for Scalable and Resilient Machine Learning Pipelines — World Journal of Advanced Engineering Technology and Sciences, 2025, 14(01), 241-253.

https://doi.org/10.30574/wjaets.2025.14.1.0020 - Comparative Analysis of Open-Source ML Pipeline Orchestration Platforms (2024) — Tese de bacharelado comparando Apache Airflow, Kubeflow, Dagster, Metaflow, MLflow, Prefect e ZenML.

https://www.researchgate.net/publication/382114154 - Supporting Diverse ML Systems at Netflix (2024) — Netflix Tech Blog, descrevendo as integrações do Metaflow na plataforma de ML da Netflix.

https://netflixtechblog.com/supporting-diverse-ml-systems-at-netflix-2d2e6b6d205d - Open-Sourcing Metaflow, a Human-Centric Framework for Data Science (2019) — Netflix Tech Blog, artigo original de lançamento do Metaflow como open source.

https://netflixtechblog.com/open-sourcing-metaflow-a-human-centric-framework-for-data-science-fa72e04a5d9 - State of Open Source Workflow Orchestration Systems 2025 — Pracdata.io, análise do ecossistema de orquestração open source com métricas de adoção e saúde de projetos.

https://www.pracdata.io/p/state-of-workflow-orchestration-ecosystem-2025 - MLOps | Apache Airflow — Documentação oficial do Apache Airflow sobre uso em pipelines de MLOps.

https://airflow.apache.org/use-cases/mlops/ - Best Practices for Orchestrating MLOps Pipelines with Airflow — Astronomer Documentation, guia de melhores práticas.

https://www.astronomer.io/docs/learn/airflow-mlops - Prefect Documentation: Introduction — Documentação oficial do Prefect, incluindo histórico de evolução do produto.

https://docs.prefect.io/ - Prefect vs Airflow: Modern Workflow Orchestration — Análise comparativa da Prefect Technologies.

https://www.prefect.io/compare/airflow - Prefect vs Airflow vs ZenML: Best Platform to Run ML Pipelines — ZenML Blog, comparação aprofundada entre as plataformas.

https://www.zenml.io/blog/prefect-vs-airflow - Best ML Workflow and Pipeline Orchestration Tools 2024 — DagsHub Blog, visão geral das principais ferramentas.

https://dagshub.com/blog/best-machine-learning-workflow-and-pipeline-orchestration-tools/ - Navigating MLOps: Insights into Maturity, Lifecycle, Tools, and Careers (2025) — ArXiv preprint sobre maturidade e ciclo de vida do MLOps, incluindo LLMOps.

https://arxiv.org/abs/2503.15577 - Netflix Uses Metaflow to Manage Hundreds of AI/ML Applications at Scale (2024) — InfoQ, cobertura das integrações da plataforma de ML da Netflix.

https://www.infoq.com/news/2024/03/netflix-metaflow/