A operacionalização de modelos de Inteligência Artificial (IA) e de Aprendizado de Máquina (Machine Learning, ML) representa um dos maiores desafios técnicos da atualidade. A lacuna entre um modelo treinado em ambiente de pesquisa e um sistema confiável em produção é profunda, e foi justamente essa lacuna que impulsionou o surgimento do campo conhecido como MLOps. No centro dessa revolução operacional encontram-se duas tecnologias que se tornaram pilares do desenvolvimento de software moderno: o Docker e o Kubernetes. Este artigo examina, de forma abrangente e aprofundada, como a containerização transforma o ciclo de vida dos modelos de IA, desde o empacotamento do ambiente de execução até a orquestração em escala, passando por temas como gerenciamento de GPUs, segurança, governança e as ferramentas do ecossistema que compõem uma plataforma MLOps madura. A análise inclui os desafios atuais, as tendências emergentes e as perspectivas para os próximos anos.

O problema da operacionalização da IA

Durante décadas, o ciclo de vida de um modelo de aprendizado de máquina era tratado como um problema essencialmente científico. Cientistas de dados treinavam algoritmos em ambientes de pesquisa, mediam sua acurácia em conjuntos de dados curados e, ao fim do processo, entregavam o resultado como um artefato estático. O problema começava quando esse artefato precisava funcionar no mundo real: servidores com sistemas operacionais diferentes, versões incompatíveis de bibliotecas, dependências conflitantes e uma infraestrutura que não havia sido projetada para lidar com a natureza efêmera e computacionalmente intensiva dos modelos de IA.

Esse fenômeno ficou conhecido no setor como o problema do “funciona na minha máquina”. Um modelo treinado com uma versão específica do PyTorch, em uma distribuição Linux particular, com drivers de GPU de uma determinada versão, simplesmente se recusava a executar de forma idêntica em outro ambiente. O custo desse atrito era enorme: equipes perdiam semanas apenas configurando infraestrutura, e a velocidade de inovação sufocava antes mesmo de chegar à produção.

Foi nesse contexto que a containerização emergiu como solução estrutural. Ao encapsular não apenas o código do modelo, mas todo o seu ambiente de execução, incluindo bibliotecas, configurações, variáveis de sistema e até drivers específicos, o Docker ofereceu algo que parecia simples, mas era revolucionário: portabilidade garantida. Um contêiner que funciona em um laptop de desenvolvedor funciona da mesma forma em um servidor de produção na nuvem, em um cluster de computação de borda ou em um ambiente híbrido que combina infraestrutura local com recursos em nuvem pública.

O Kubernetes, por sua vez, resolveu o problema complementar: não bastava empacotar os modelos corretamente se não houvesse uma forma inteligente de gerenciar dezenas, centenas ou milhares desses contêineres ao mesmo tempo. A orquestração automatizada, o escalonamento elástico, a recuperação de falhas e o gerenciamento declarativo de recursos tornaram o Kubernetes o sistema nervoso central da infraestrutura moderna de IA.

Em 2025, pesquisas de mercado indicam que mais de dois terços das organizações consideram o Kubernetes essencial para aproveitar plenamente o potencial da IA, e a grande maioria já executa cargas de trabalho de IA em produção sobre essa plataforma ou planeja fazê-lo em breve. O mercado de orquestração de contêineres projeta crescimento expressivo ao longo da próxima década, impulsionado pela convergência entre microsserviços, DevOps e computação em nuvem híbrida.

Fundamentos da containerização: Docker como alicerce

O que é um contêiner

Um contêiner é uma unidade de software que empacota uma aplicação junto com todas as suas dependências, bibliotecas, arquivos de configuração e ambiente de execução em uma estrutura isolada e portátil. Diferentemente de uma máquina virtual, que virtualiza um sistema operacional completo para cada instância, um contêiner compartilha o kernel do sistema operacional hospedeiro, consumindo uma fração muito menor de recursos computacionais. Essa eficiência se traduz em densidade muito maior por nó de infraestrutura, menor tempo de inicialização e menor overhead de memória e CPU.

Para modelos de IA, essa distinção é particularmente relevante. Aplicações de inteligência artificial são notoriamente exigentes quanto às suas dependências: uma versão específica do Python, drivers de GPU como CUDA ou ROCm, frameworks como TensorFlow ou PyTorch, e dezenas de bibliotecas auxiliares precisam coexistir em versões exatas e compatíveis entre si. O Docker resolve esse caos encapsulando todo esse ecossistema em uma imagem imutável e reproduzível.

Benefícios da containerização para modelos de IA

A utilização do Docker para containerizar modelos de ML oferece uma série de benefícios cruciais para a implantação em produção. Em primeiro lugar, garante a reprodutibilidade dos modelos em diferentes ambientes, desde o desenvolvimento até a produção, eliminando o problema comum de inconsistências causadas por variações no sistema operacional, nas bibliotecas ou em suas versões. Ao empacotar o modelo com todas as suas dependências e o ambiente de execução, o Docker assegura comportamento consistente independentemente da infraestrutura subjacente.

Além da reprodutibilidade, o Docker proporciona isolamento de dependências. Diferentes projetos de IA podem ser executados em contêineres separados sem interferir uns nos outros, evitando conflitos de bibliotecas ou versões que seriam inevitáveis em um ambiente compartilhado. Uma equipe pode manter simultaneamente um modelo de processamento de linguagem natural baseado em TensorFlow 2.x e um modelo de visão computacional baseado em PyTorch, em contêineres completamente isolados no mesmo servidor, sem qualquer conflito.

A portabilidade é outro benefício central. Uma imagem Docker criada em uma estação de trabalho local pode ser transferida para qualquer ambiente compatível, seja ele um servidor local, uma instância em nuvem pública, um cluster de computação distribuída ou um dispositivo de borda. Isso elimina a necessidade de reconfigurar o ambiente de execução para cada novo ambiente de destino.

Por fim, a containerização facilita substancialmente a integração com pipelines de integração e entrega contínuas (CI/CD). Cada nova versão de um modelo pode ser construída como uma nova imagem Docker, versionada, testada automaticamente e promovida para produção sem intervenção manual, seguindo os mesmos princípios que regem o desenvolvimento de software moderno.

Docker Model Runner: A evolução para modelos nativos

Em 2025, o ecossistema Docker deu um passo significativo ao lançar o Docker Model Runner, uma ferramenta integrada que permite aos desenvolvedores executar, gerenciar e testar modelos de IA localmente usando comandos e fluxos de trabalho familiares do Docker. Diferentemente de abordagens anteriores, o Docker Model Runner se integra diretamente ao ecossistema Docker, suportando diversas arquiteturas de GPU e registros OCI para uma distribuição de modelos simplificada.

A arquitetura do Docker Model Runner é reveladora de uma mudança paradigmática. Em vez de virtualizar o ambiente inteiro, ele aproveita os recursos nativos do host, incluindo aceleração de GPU, eliminando o overhead da containerização para tarefas de inferência intensivas. Isso representa uma síntese inteligente entre os benefícios do gerenciamento containerizado e a eficiência do acesso direto ao hardware acelerador.

A principal vantagem em termos de segurança dessa abordagem é a privacidade dos dados. As solicitações de inferência nunca saem da infraestrutura local, eliminando os riscos de exfiltração de dados. Para organizações que lidam com informações confidenciais, esse modelo de execução local é essencial para a conformidade com regulamentações como o GDPR, a HIPAA e a LGPD brasileira. Em outubro de 2025, a ferramenta saiu de versão beta experimental para disponibilidade geral, e passou a suportar aceleração via Vulkan, expandindo a compatibilidade para uma gama muito mais ampla de GPUs, incluindo dispositivos integrados e aqueles fabricados pela AMD e Intel.

Uma observação importante sobre o ecossistema Docker em 2025 é a evolução do Docker Compose para suportar modelos de IA como componentes de primeira classe. Frameworks de agentes como CrewAI, LangGraph e Spring AI passaram a ser declaráveis diretamente nos arquivos de configuração, unificando o gerenciamento de serviços tradicionais, bancos de dados e modelos de IA em um único fluxo operacional.

Kubernetes: A orquestração como ciência

Arquitetura e modelo declarativo

O Kubernetes adota um modelo declarativo baseado em arquivos de configuração onde o operador descreve o estado desejado do sistema. O orquestrador compara continuamente esse estado desejado com a realidade observada e executa ações automáticas para reconciliar qualquer divergência: cria novos pods quando a demanda aumenta, reinicia contêineres que falham, redistribui cargas de trabalho quando nós ficam indisponíveis e escala recursos de acordo com métricas definidas. Essa abordagem declarativa é fundamentalmente diferente do gerenciamento imperativo tradicional, onde cada ação precisava ser comandada explicitamente.

Os principais componentes do Kubernetes incluem o cluster, que é o conjunto de nós que executam os workloads containerizados; os pods, que são as menores unidades de implantação e que contêm um ou mais contêineres; os deployments, que gerenciam o ciclo de vida e a atualização dos pods; os services, que expõem os pods como endpoints de rede estáveis; e os namespaces, que fornecem isolamento lógico dentro do cluster. Para cargas de trabalho de IA, adicionam-se ainda os persistent volumes, que garantem armazenamento durável para artefatos de modelo e conjuntos de dados de treinamento.

Kubernetes como fundação para MLOps

O Kubernetes se consolidou como fundação preferida para fluxos de trabalho de MLOps por razões que vão além da simples orquestração. A escalabilidade automática permite que serviços de inferência se expandam durante picos de demanda e se contraiam em períodos de menor uso, otimizando custos sem sacrificar disponibilidade. O balanceamento de carga distribui requisições entre múltiplas réplicas do modelo, garantindo respostas rápidas mesmo sob alta demanda. A alta disponibilidade é assegurada pela capacidade do Kubernetes de detectar falhas e redistribuir cargas automaticamente.

Para equipes de MLOps, o benefício concreto é a transformação do trabalho em um fluxo padronizado. Novos modelos passam a seguir o mesmo caminho de construção, validação e implantação, reduzindo o tempo entre a prova de conceito e o valor em produção. A combinação de orquestração de contêineres com pipelines declarativos permite que o treinamento, a implantação e a observação de dezenas de modelos deixem de ser um conjunto de scripts ad hoc para se tornarem um produto interno robusto e confiável.

Uma consideração prática relevante é que o Kubernetes, embora dominante, não é a única opção válida para orquestração. Alternativas como Docker Swarm, Amazon ECS, Podman e serviços serverless de contêineres atendem a casos de uso específicos. A melhor escolha depende de complexidade, escala, competências da equipe e metas de longo prazo da organização.

Gerenciamento de GPUs no Kubernetes: O problema central

Limitação do modelo tradicional

Cargas de trabalho de IA são intensamente dependentes de unidades de processamento gráfico (GPUs), e o gerenciamento eficiente dessas unidades em um cluster Kubernetes representa um dos maiores desafios técnicos do campo. O modelo tradicional do Kubernetes trata GPUs como recursos inteiros e indivisíveis: um pod solicita uma ou mais GPUs, e o agendador aloca aquelas GPUs exclusivamente para aquele pod, independentemente de quanta capacidade de fato será utilizada.

Essa abordagem, embora simples de implementar, é fundamentalmente inadequada para a diversidade das cargas de trabalho de IA modernas. Muitas tarefas de inferência, por exemplo, consomem apenas uma fração dos recursos de uma GPU de ponta. Um modelo quantizado de 8 bilhões de parâmetros executando inferência em tempo real pode consumir apenas 15% da memória de uma GPU A100 de 80 GB e 30 a 35% da capacidade computacional. Em um cluster de produção com 50 serviços de inferência, cada um consumindo aproximadamente 30% de uma GPU, a organização provisiona 50 GPUs completas quando a demanda real poderia ser atendida com 15 a 20 GPUs com co-localização inteligente de cargas de trabalho. O custo financeiro dessa ineficiência, em ambientes de nuvem com preços da ordem de 3 a 4 dólares por hora por GPU, pode facilmente superar centenas de milhares de dólares anuais para uma plataforma de IA de médio porte.

Estratégias avançadas de compartilhamento de GPU

O ecossistema Kubernetes evoluiu significativamente para endereçar esse problema, introduzindo mecanismos sofisticados de compartilhamento e particionamento de GPU.

O GPU time-slicing divide o poder de processamento de uma única GPU entre múltiplas cargas de trabalho por meio de rápida alternância entre elas. Múltiplos jobs podem aproveitar a mesma GPU, compartilhando recursos em rajadas. Segundo benchmarks da NVIDIA apresentados na KubeCon North America 2024, o time-slicing de GPU pode aumentar a utilização em aproximadamente três vezes para cargas de trabalho leves, sem impacto significativo em latência ou throughput. A limitação principal dessa abordagem é a ausência de isolamento garantido de recursos, o que pode causar interferência entre cargas de trabalho concorrentes e latência imprevisível.

O Multi-Instance GPU (MIG) é uma tecnologia da NVIDIA que particiona fisicamente uma GPU em instâncias isoladas com garantias de hardware. Um A100, por exemplo, pode ser dividido em até sete instâncias independentes, cada uma com sua própria memória e capacidade de computação garantidas. O MIG é ideal para ambientes multi-tenant onde o isolamento de desempenho é uma exigência, mas apresenta a limitação de ser estático: a configuração é definida durante a inicialização do nó e mudá-la geralmente requer reinicialização. Adicionalmente, o MIG está disponível apenas em certas GPUs de data center, como a família Ampere e posteriores da NVIDIA.

O Multi-Process Service (MPS) permite que múltiplos processos CUDA compartilhem uma GPU de forma mais eficiente do que o time-slicing simples, reduzindo o overhead de troca de contexto. É particularmente eficaz para cargas de trabalho de inferência que toleram alguma variação de latência em troca de maior throughput agregado.

Avanços recentes: NVIDIA KAI Scheduler e Dynamic Resource Allocation

Em janeiro de 2025, a NVIDIA abriu o código-fonte do KAI (Kubernetes AI) Scheduler, um agendador avançado projetado especificamente para a otimização de cargas de trabalho de GPU. O KAI Scheduler introduz alocação fracionada de GPU e gerenciamento de recursos orientado a políticas, permitindo que organizações maximizem a utilização sem causar conflitos entre workloads. Ele se tornou rapidamente uma referência para ambientes de produção que precisam conciliar eficiência e estabilidade.

No nível do próprio Kubernetes, a API de Dynamic Resource Allocation (DRA) representa uma mudança fundamental na forma como recursos especializados são gerenciados. O DRA elimina a dependência de drivers de terceiros para validação de alocação, permitindo que o Kubernetes gerencie e aloque diretamente recursos como GPUs, FPGAs e outros aceleradores de hardware. O agendador central (kube-scheduler) passa a gerenciar a alocação de recursos sem a necessidade de interação com drivers externos, reduzindo a latência de agendamento e acelerando a tomada de decisão.

O NVIDIA GPU Operator continua sendo a solução de referência para ambientes de produção em 2025. Ele automatiza o gerenciamento de todos os componentes de software necessários da NVIDIA, incluindo drivers, o container toolkit e o device plugin, que expõe GPUs como recursos agendáveis pelo Kubernetes. Sua integração com ferramentas de monitoramento como DCGM e Prometheus permite visibilidade granular sobre a utilização de GPU em todo o cluster.

O ecossistema MLOps sobre Kubernetes

Kubeflow: A plataforma unificada

O Kubeflow é uma plataforma open-source projetada nativamente para Kubernetes, com o objetivo de simplificar a implantação e o gerenciamento de fluxos de trabalho de ML. Ele funciona como uma coleção de microsserviços que cobrem o ciclo completo de vida do ML, desde a exploração de dados até o monitoramento em produção.

Os componentes principais do Kubeflow incluem os Pipelines, que são motores de fluxo de trabalho composíveis para gerenciar workflows de ML de ponta a ponta por meio de execução baseada em grafos acíclicos dirigidos (DAGs); o Katib, responsável pela otimização de hiperparâmetros; o Trainer, que simplifica fluxos de trabalho de treinamento distribuído para frameworks como TensorFlow, PyTorch e XGBoost; e o KServe, a plataforma de servência de modelos em produção.

Em cada pipeline do Kubeflow, cada etapa do workflow de ML é executada dentro de um contêiner. Essa abordagem containerizada proporciona três benefícios fundamentais: isolamento entre etapas, ambientes reproduzíveis e a capacidade de usar requisitos de tempo de execução diferentes para diferentes estágios do pipeline. Enquanto uma etapa de pré-processamento pode usar uma imagem baseada em Python puro, a etapa de treinamento pode usar uma imagem com TensorFlow e suporte a CUDA, e a etapa de avaliação pode usar uma imagem completamente diferente, tudo dentro do mesmo pipeline coerente.

A versão 1.10 do Kubeflow, lançada em março de 2025, introduziu recursos críticos para a operação de Grandes Modelos de Linguagem (LLMs). A plataforma passou a incluir otimização de hiperparâmetros especificamente projetada para fine-tuning de modelos de fundação, o novo componente Trainer 2.0 para fluxos de trabalho de treinamento distribuído de modelos de grande escala, e integrações aprimoradas do Model Registry com o KServe. Melhorias de segurança, incluindo contêineres sem root (rootless) e compatibilidade com CISO, endereçam os requisitos de governança que empresas enfrentam ao implantar agentes de IA em produção.

KServe: Servência de modelos em escala

O KServe é uma plataforma open-source de servência de modelos para Kubernetes que padroniza a forma como modelos de ML são implantados, escalados e gerenciados em produção. É um projeto em fase de incubação na Cloud Native Computing Foundation (CNCF) e componente central do Kubeflow. Sua arquitetura serverless ajusta automaticamente os recursos com base na demanda, minimizando o overhead operacional e os custos em períodos de baixa utilização.

O KServe suporta múltiplos frameworks de ML, incluindo TensorFlow, PyTorch, XGBoost e Scikit-Learn, além de frameworks de IA generativa. Recursos como aceleração por GPU com gerenciamento otimizado de memória para modelos grandes, cache inteligente de modelos para reduzir tempos de carregamento, e offloading de KV Cache para CPU e disco para lidar com sequências mais longas, posicionam o KServe como uma plataforma capaz de atender tanto a modelos preditivos tradicionais quanto a LLMs de última geração.

Um exemplo concreto do impacto do KServe foi documentado em estudos de caso de MLOps: antes de sua adoção, implantações manuais resultavam em desempenho inconsistente, quedas frequentes e problemas de escalabilidade durante picos de carga. Com a arquitetura serverless do KServe, organizações relataram redução de custos de recursos da ordem de 40%, uma vez que os recursos passaram a ser escalonados automaticamente com base na demanda, garantindo utilização otimizada.

MLflow: Rastreamento e governança de experimentos

O MLflow é uma plataforma open-source para gerenciar o ciclo de vida de ML de ponta a ponta. Enquanto o Kubeflow se concentra na orquestração de infraestrutura, o MLflow foca na rastreabilidade e na governança dos experimentos e dos modelos. Ele permite que equipes acompanhem parâmetros, métricas e artefatos de cada experimento, comparem diferentes versões de um modelo e registrem o modelo aprovado em um repositório centralizado com metadados ricos.

A integração entre MLflow e Kubernetes é particularmente valiosa. Um modelo treinado e registrado no MLflow pode ser empacotado como imagem Docker usando ferramentas nativas da plataforma e implantado no Kubernetes via KServe, criando uma cadeia completa e rastreável desde o experimento inicial até o endpoint de inferência em produção. Cada passo dessa cadeia é auditável: sabe-se com qual conjunto de dados o modelo foi treinado, quais hiperparâmetros foram usados, quais métricas de avaliação foram alcançadas e quem aprovou a promoção para produção.

O MLflow 3, lançado em junho de 2025, representou uma evolução fundamental em direção às operações de IA generativa. A plataforma passou a tratar prompts e agentes de IA como entidades de primeira classe ao lado dos modelos tradicionais, com rastreamento abrangente baseado em OpenTelemetry para depuração de fluxos de trabalho complexos de agentes.

Seldon Core e outras ferramentas de servência

O Seldon Core é outra solução relevante que roda sobre Kubernetes e facilita a gestão de modelos como microsserviços. Ele fornece logs detalhados de previsões, monitoramento de latência e suporte a fluxos de testes A/B para comparar modelos simultaneamente em produção. Sua arquitetura permite que o mesmo modelo seja servido com diferentes configurações de recursos, facilitando a comparação de custo-benefício de diferentes estratégias de implantação.

Para cenários de treinamento distribuído em grande escala, o Ray e o Volcano são frequentemente usados em conjunto com o Kubernetes. O Ray facilita a execução de tarefas de treinamento distribuído em múltiplos nós, enquanto o Volcano adiciona semânticas de agendamento em grupo (gang scheduling), garantindo que todos os workers de um job de treinamento sejam alocados simultaneamente ou aguardem juntos na fila, evitando deadlocks causados pela alocação parcial de recursos.

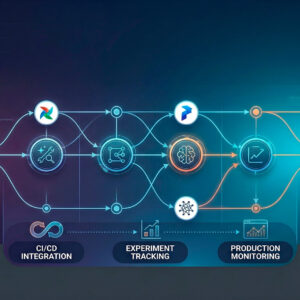

Pipelines de CI/CD para modelos de IA

A necessidade de automação contínua

O deploy de modelos de IA em produção não é um evento estático: modelos precisam ser constantemente revisados, retreinados e monitorados para evitar a perda de qualidade ao longo do tempo. O fenômeno conhecido como data drift ocorre quando os dados de produção passam a ter características diferentes dos dados de treinamento. O concept drift, por sua vez, ocorre quando o próprio “conceito” do problema muda, ou seja, a relação entre as variáveis de entrada e a saída desejada se transforma. Se o modelo foi treinado com dados que não representam mais a realidade, sua performance decai de forma silenciosa e potencialmente catastrófica.

Para endereçar esses desafios, MLOps insere práticas de desenvolvimento de software no ciclo de vida do modelo, criando pipelines automatizados de treinamento, teste e implantação, além de estratégias de monitoramento e versionamento de dados. Sem MLOps, cada nova versão de modelo demanda enorme esforço manual e corre o risco de apresentar divergências entre o ambiente de desenvolvimento e o de produção.

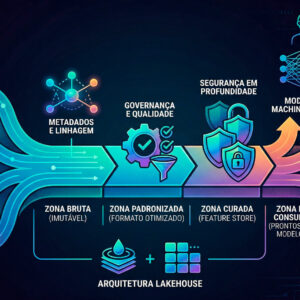

Estrutura de um pipeline MLOps sobre Kubernetes

Um pipeline de MLOps maduro sobre Kubernetes envolve várias etapas interconectadas. A fase de treinamento utiliza jobs em lote submetidos ao cluster, empregando nós com GPU e volumes persistentes para os dados de treinamento. Após a conclusão, o modelo é registrado em um repositório de modelos com seus artefatos e metadados. A fase de avaliação verifica o desempenho do modelo em dados de validação e decide, com base em critérios objetivos, se o modelo está apto para produção.

A fase de construção de imagem empacota o modelo aprovado, junto com seu código de servência e dependências, em uma imagem Docker que é publicada em um registro de contêineres. A fase de implantação aplica as configurações declarativas ao cluster Kubernetes, promovendo a nova versão de forma controlada, seja por meio de implantações blue/green, que mantêm duas versões em paralelo, ou de canary releases, que direcionam progressivamente o tráfego para a nova versão enquanto monitoram métricas de qualidade.

O monitoramento contínuo fecha o ciclo: métricas de desempenho do modelo são coletadas em tempo real e comparadas com limiares predefinidos. Quando uma degradação é detectada, alertas são disparados e, em pipelines altamente automatizados, um novo ciclo de retreinamento pode ser iniciado automaticamente.

Ferramentas como Tekton fornecem capacidades de CI/CD nativas ao Kubernetes, permitindo que cada estágio do pipeline seja expresso como um contêiner independente com entradas e saídas bem definidas. Apache Airflow, quando implantado sobre Kubernetes, oferece orquestração de fluxos de trabalho mais complexos, incluindo paralelismo, dependências condicionais e reprocessamento de dados históricos.

Segurança e governança em ambientes containerizados de IA

Vetores de risco específicos

Ambientes baseados em contêineres e Docker introduzem novos vetores de risco que exigem práticas específicas de segurança. É comum que equipes acelerem a adoção técnica e só depois descubram problemas com imagens inseguras, segredos expostos ou falta de rastreabilidade. Para modelos de IA, os riscos são amplificados pelo fato de que esses sistemas frequentemente processam dados sensíveis, seja dados pessoais de usuários em sistemas de recomendação, informações financeiras em modelos de detecção de fraude ou dados de saúde em sistemas de diagnóstico assistido.

Os principais vetores de risco incluem o uso de imagens base não verificadas ou com vulnerabilidades conhecidas, a exposição inadvertida de segredos e credenciais dentro das imagens Docker, configurações inadequadas de controle de acesso no cluster Kubernetes, a ausência de isolamento de rede entre serviços e namespaces, e a falta de auditoria sobre quem pode publicar ou modificar imagens de modelos. Pesquisas de mercado indicam que uma parcela significativa das organizações adia projetos de contêineres e Kubernetes justamente por preocupações de segurança, que vão desde erros de configuração até ataques à cadeia de suprimentos de imagens.

Boas práticas de segurança

A primeira linha de defesa é o estabelecimento de um catálogo de imagens base aprovadas, mantido pelo time de plataforma ou segurança. Essas imagens devem passar por varredura frequente de vulnerabilidades, usando ferramentas integradas ao pipeline de CI. O princípio do menor privilégio deve ser aplicado a todos os contêineres: nenhum processo deve executar com mais permissões do que as estritamente necessárias para sua função. A adoção de contêineres sem root (rootless) reduz significativamente a superfície de ataque.

O gerenciamento de segredos é um ponto crítico. Soluções como HashiCorp Vault ou cofres nativos dos provedores de nuvem evitam que senhas, tokens e chaves de API fiquem codificados dentro das imagens Docker ou expostos como variáveis de ambiente públicas. O controle de acesso baseado em papéis (RBAC) do Kubernetes deve ser configurado cuidadosamente para que cada serviço acesse apenas os recursos para os quais está explicitamente autorizado.

A segmentação de rede entre serviços usando políticas de rede do Kubernetes impede que uma potencial comprometimento de um serviço se propague lateralmente pelo cluster. O monitoramento de comportamento anômalo em tempo de execução, usando ferramentas como Falco, permite detectar atividades suspeitas dentro dos contêineres mesmo quando elas não correspondem a vulnerabilidades conhecidas.

Em organizações sujeitas a regulamentações de privacidade, como o GDPR na Europa ou a LGPD no Brasil, a containerização pode ser uma aliada poderosa. A execução local de modelos de inferência, sem que os dados precisem trafegar por APIs de terceiros, elimina riscos de exfiltração e facilita a demonstração de conformidade. Essa é uma das principais motivações para a crescente adoção da IA self-hosted em setores regulados como saúde, finanças e setor público.

Governança de modelos

A governança de modelos vai além da segurança técnica: envolve a rastreabilidade completa do ciclo de vida de cada modelo, desde os dados de treinamento até as previsões em produção. Ferramentas como o Model Registry do Kubeflow e o MLflow asseguram que cada modelo implantado seja descoberto, reproduzível e governado. Políticas claras sobre quem pode aprovar a promoção de modelos para produção, quais métricas de qualidade precisam ser satisfeitas e como as decisões do modelo são auditadas são componentes essenciais de uma estratégia de governança madura.

Em 2025, com a proliferação de modelos de IA generativa e agentes autônomos, a governança ganhou uma dimensão adicional de urgência. A capacidade de rastrear quais versões de um modelo produziram quais previsões, em quais condições e com quais dados de entrada, tornou-se não apenas uma boa prática, mas uma exigência regulatória emergente em diversas jurisdições.

Casos de uso setoriais e padrões de implantação

Varejo e e-commerce

No varejo, a containerização de modelos de IA viabilizou arquiteturas que eram impraticáveis poucos anos atrás. Considere o cenário de uma grande varejista que mantém uma equipe de MLOps responsável por modelos de recomendação de produtos, previsão de demanda e detecção de fraude. Esses modelos precisam ser orquestrados em diferentes estágios, treinamento, inferência e versionamento, em múltiplas nuvens e em instâncias com CPU, GPU e até computação de borda em lojas físicas. Sem uma arquitetura containerizada e orquestrada, cada novo modelo se torna um projeto isolado e custoso. Com Kubernetes e uma plataforma MLOps bem estruturada, novos modelos seguem o mesmo caminho padronizado de construção, validação e implantação.

Saúde e ciências da vida

Na área de saúde, os requisitos de privacidade e conformidade regulatória tornam a containerização local especialmente valiosa. Modelos de análise de imagens médicas, como diagnóstico por visão computacional, podem ser implantados diretamente em hospitais e clínicas usando contêineres Docker, garantindo que os dados dos pacientes nunca saiam da infraestrutura institucional. O Kubernetes gerencia o escalonamento automático desses serviços de acordo com a demanda, seja em um turno de alta movimentação no setor de radiologia ou em uma campanha de triagem em massa.

Indústria e IoT

Na manufatura e na Internet das Coisas Industrial, a computação de borda emerge como fronteira importante para a IA containerizada. Modelos de manutenção preditiva precisam analisar dados de sensores de vibração e temperatura em tempo real, com latência na ordem de milissegundos, o que torna inviável o envio de dados para a nuvem a cada leitura. Distribuições leves do Kubernetes, como K3s e MicroK8s, permitem a orquestração de modelos de IA containerizados em dispositivos de borda com recursos limitados, desde gateways industriais até câmeras inteligentes.

Implementações avançadas de borda utilizam tecnologias de containerização como o Docker para empacotar aplicações, garantindo que estas funcionem de forma consistente em diferentes arquiteturas de dispositivos, desde unidades Raspberry Pi a gateways industriais. Essa portabilidade é fundamental em ambientes onde a diversidade de hardware é a regra, não a exceção.

Serviços financeiros

No setor financeiro, a combinação de requisitos de baixa latência, alta disponibilidade e conformidade regulatória rigorosa torna os modelos containerizados sobre Kubernetes uma escolha natural. Modelos de pontuação de crédito, detecção de fraude em tempo real e precificação de ativos precisam responder em frações de segundo, com garantias de disponibilidade de 99,99% e rastreabilidade completa de todas as decisões. A arquitetura declarativa do Kubernetes, combinada com ferramentas de rastreamento como o MLflow, fornece exatamente esse nível de auditabilidade e controle.

Desafios persistentes e limitações

Complexidade operacional

Apesar dos enormes benefícios, a adoção de Docker e Kubernetes para MLOps não é isenta de desafios. A curva de aprendizado é substancial: configurar e operar um cluster Kubernetes de produção exige conhecimentos profundos em rede, armazenamento, segurança e sistemas distribuídos que muitas equipes de ciência de dados simplesmente não possuem. A necessidade de integrar competências de DevOps com as de dados e ML criou uma demanda por perfis profissionais raros e disputados.

A complexidade dos pipelines de dados representa outro obstáculo significativo. Cargas de trabalho de IA requerem acesso a conjuntos de dados de grande volume que podem estar armazenados em locais variados. Garantir localidade de dados, minimizar transferências de rede e integrar pipelines de ingestão com o cluster Kubernetes de forma eficiente é um problema não trivial que exige planejamento cuidadoso.

Gerenciamento de versões e dependências

O controle de versões de modelos e a garantia de implantações suaves entre versões é outro desafio recorrente. Sem um sistema robusto de registro de modelos e práticas de GitOps, é fácil perder o rastro de qual versão de um modelo está em produção, em qual hardware foi treinado e com quais hiperparâmetros. A integração entre o registro de modelos, o repositório de código e o sistema de orquestração é um problema de engenharia que requer investimento deliberado.

Custos e eficiência de GPU

O problema da subutilização de GPU, discutido anteriormente, é ao mesmo tempo um dos maiores desafios e uma das maiores oportunidades de otimização. Mesmo com estratégias avançadas de compartilhamento, clusters bem administrados frequentemente lutam para superar 20 a 30% de utilização de GPU porque as abstrações do Kubernetes não refletem a forma como as cargas de trabalho de IA realmente consomem recursos computacionais e de memória. Esse teto de eficiência é consequência direta da alocação estática. A solução sustentável é o gerenciamento dinâmico e consciente da carga de trabalho baseado no consumo real, o que exige camadas de inteligência que o Kubernetes nativo ainda não fornece de forma satisfatória.

Integração de pipelines de dados

A integração entre o ciclo de vida dos dados e o ciclo de vida dos modelos permanece um problema em aberto. Feature stores, como o Feast, tentam centralizar o gerenciamento das variáveis processadas, evitando retrabalho e inconsistências entre diferentes modelos. Mas a integração dessas ferramentas com sistemas de orquestração como o Kubeflow e com o ambiente de produção Kubernetes ainda requer configuração não trivial e expertise especializado.

Tendências e perspectivas para o futuro

IA Generativa e LLMs sobre Kubernetes

A explosão dos Grandes Modelos de Linguagem (LLMs) abriu uma nova dimensão de desafios para a containerização de IA. Modelos com bilhões de parâmetros não cabem em uma única GPU e precisam de estratégias sofisticadas de paralelismo de modelo e de dados para treinamento e inferência distribuídos. O Kubernetes está se adaptando a esses requisitos por meio de frameworks como o vLLM e o TGI (Text Generation Inference) que otimizam a servência de LLMs com técnicas como paginação de atenção e agendamento de batches contínuo.

A servência eficiente de LLMs exige uma camada de gerenciamento de recursos ainda mais sofisticada do que modelos tradicionais. O KV Cache, que armazena resultados intermediários de atenção para acelerar a geração de tokens, pode consumir grandes quantidades de memória GPU de forma dinâmica e imprevisível. O KServe 0.14 e versões posteriores introduziram suporte a KV Cache offloading para CPU e disco, permitindo que sequências mais longas sejam processadas sem esgotar a memória GPU disponível.

IA de borda e distribuição federada

A computação de borda representa a próxima fronteira para a IA containerizada. Distribuições leves do Kubernetes, combinadas com hardware de inferência cada vez mais poderoso e eficiente energeticamente, estão tornando viável a execução de modelos sofisticados em locais que antes eram exclusivo domínio de sistemas baseados em nuvem. Veículos autônomos, câmeras inteligentes, equipamentos industriais e dispositivos médicos portáteis são todos candidatos a executar IA containerizada na borda.

O aprendizado federado, que treina modelos de forma distribuída sem centralizar os dados dos participantes, é particularmente promissor para cenários regulados como saúde e finanças. Kubernetes pode coordenar os processos de agregação de gradientes em pipelines federados, garantindo que cada nó de treinamento, seja ele um hospital, uma filial bancária ou um dispositivo IoT, contribua para o modelo global sem expor dados locais.

Observabilidade e FinOps para IA

À medida que as implantações de IA sobre Kubernetes amadurecem, a observabilidade e a otimização de custos emergem como disciplinas críticas. A integração de métricas de desempenho de modelo, métricas de infraestrutura e métricas de negócio em painéis unificados permite que equipes correlacionem degradação de modelo com mudanças de infraestrutura, identifiquem gargalos de custo e tomem decisões baseadas em dados sobre alocação de recursos.

A prática de FinOps aplicada a cargas de trabalho de IA envolve definir budgets por equipe ou produto, estabelecer alertas de custo por cluster, e conectar essas métricas a indicadores de negócio como custo por previsão ou custo por mil requisições de inferência. Essa visibilidade é fundamental para justificar investimentos em infraestrutura e para identificar oportunidades de otimização que podem representar economias substanciais em ambientes de grande escala.

Agentes de IA e novas abstrações

Em fevereiro de 2026, o Docker lançou o Gordon, um agente de IA integrado ao Docker Desktop e à linha de comando que tem acesso ao ambiente de contêineres e pode auxiliar na depuração e otimização de configurações. Embora seja um passo inicial, ele sinaliza uma direção importante: a IA será cada vez mais utilizada para gerenciar a própria infraestrutura de IA, criando loops de automação onde sistemas inteligentes monitoram, diagnosticam e corrigem problemas em seus pares containerizados.

O suporte oficial do Docker Compose a frameworks de agentes como CrewAI e LangGraph reflete a crescente complexidade dos sistemas de IA modernos, que frequentemente combinam múltiplos modelos, ferramentas externas e memória persistente em arquiteturas de múltiplos agentes. Gerenciar essa complexidade requer abstrações de orquestração que vão além dos contêineres individuais e começam a tratar sistemas multi-agente como unidades de implantação coesas.

A containerização de modelos de IA com Docker e Kubernetes transformou fundamentalmente a maneira como organizações desenvolvem, implantam e operam sistemas inteligentes. O que antes era um conjunto fragmentado de práticas ad hoc se tornou, progressivamente, uma disciplina de engenharia com padrões estabelecidos, ferramentas maduras e uma comunidade global ativa.

O Docker resolveu o problema da portabilidade e da reprodutibilidade: um modelo empacotado corretamente se comporta de forma idêntica em qualquer ambiente. O Kubernetes resolveu o problema da escala e da operação: centenas de modelos podem ser gerenciados, atualizados e monitorados de forma declarativa e automatizada. O ecossistema MLOps construído sobre essas fundações, com Kubeflow, KServe, MLflow e dezenas de ferramentas complementares, resolveu o problema do ciclo de vida completo: da experimentação à produção, com rastreabilidade, governança e automação contínua.

Os desafios que permanecem são reais e substanciais. A subutilização de GPU representa bilhões de dólares desperdiçados anualmente. A complexidade operacional mantém barreiras de entrada elevadas. A integração de pipelines de dados com ambientes de inferência ainda exige trabalho cuidadoso. E a governança de modelos de IA generativa coloca questões éticas e regulatórias que a tecnologia, por si só, não pode resolver.

Mas a direção é clara. O Kubernetes e o Docker deixaram de ser ferramentas de infraestrutura para se tornarem a gramática compartilhada da IA moderna em produção. As organizações que investem em dominar essa gramática e as práticas de MLOps que a acompanham não estão apenas ganhando eficiência operacional: estão construindo a capacidade de transformar continuamente o potencial dos modelos de IA em valor real para seus negócios e para a sociedade.

Fontes

- Collabnix Team. MLOps on Kubernetes: CI/CD for Machine Learning Models in 2024. Collabnix, 2024.

https://collabnix.com/mlops-on-kubernetes-ci-cd-for-machine-learning-models-in-2024/ - Collabnix Team. Kubernetes and AI: Mastering ML Workloads in 2025. Collabnix, 2025.

https://collabnix.com/kubernetes-and-ai-the-ultimate-guide-to-orchestrating-machine-learning-workloads-in-2025/ - Collabnix Team. Kubernetes and GPU: The Complete Guide to AI/ML Acceleration in 2025. Collabnix, 2025.

https://collabnix.com/kubernetes-and-gpu-the-complete-guide-to-ai-ml-acceleration-in-2025/ - Thiagosr. Deploy de Modelos de IA/ML com Docker e Kubernetes: Um Tutorial Passo a Passo com Melhores Práticas e Desafios. Medium, maio de 2025.

https://medium.com/@thiago2002sr/deploy-de-modelos-de-ia-ml-com-docker-e-kubernetes- - Bosch Tech Brasil. MLOps na Prática: Desafios e Boas Práticas para Colocar Modelos de IA em Produção. Medium, maio de 2025.

https://medium.com/@boschtechbr/mlops-na-pratica - Locaweb Blog. Deploy de modelos de Machine Learning em produção: do Jupyter Notebook ao sistema escalável. Locaweb, outubro de 2025.

https://www.locaweb.com.br/blog/temas/codigo-aberto/deploy-de-modelos-de-machine-learning-em-producao - DataCamp. Executor de Modelo Docker: Execute modelos de IA localmente com facilidade. DataCamp, dezembro de 2025.

https://www.datacamp.com/pt/tutorial/docker-model-runner - Pazini, R. F. Docker Compose para Agentes de IA: O que realmente mudou. DEV Community, março de 2026.

https://dev.to/rflpazini/docker-compose-para-agentes-de-ia - Kubeflow Blog. From Raw Data to Model Serving: A Blueprint for the AI/ML Lifecycle with Kubeflow. Kubeflow, julho de 2025.

https://blog.kubeflow.org/fraud-detection-e2e/ - KServe GitHub. KServe: Standardized Distributed Generative and Predictive AI Inference Platform for Scalable, Multi-Framework Deployment on Kubernetes. CNCF, 2025.

https://github.com/kserve/kserve - Portworx. What is Kubeflow? Intro to ML on Kubernetes. Portworx Knowledge Hub, janeiro de 2026.

https://portworx.com/knowledge-hub/what-is-kubeflow-an-introduction/ - ZenML Blog. Kubeflow vs MLflow vs ZenML: Which MLOps Platform Is the Best? ZenML, novembro de 2025.

https://www.zenml.io/blog/kubeflow-vs-mlflow - ApXML. Advanced GPU Scheduling and Sharing in Kubernetes. ApXML Courses, 2024.

https://apxml.com/courses/advanced-ai-infrastructure-design-optimization - RiseUnion. Kubernetes DRA: Revolutionary GPU Resource Management. The Rise Union, dezembro de 2024.

https://www.theriseunion.com/en/blog/Kubernetes-Dynamic-Resource-Allocation.html - vCluster Blog. Optimizing GPU Scheduling in Kubernetes with NVIDIA KAI and vCluster. Loft Labs, 2025.

https://www.vcluster.com/blog/gpu-scheduling-with-nvidia-kai-and-vcluster - DebugG.ai. Kubernetes GPU Scheduling in 2025: Practical Patterns for AI Infrastructure. DebugG, 2025.

https://debugg.ai/resources/kubernetes-gpu-scheduling-2025-kueue-volcano-mig - Rafay Systems. Rethinking GPU Allocation in Kubernetes. Rafay Blog, novembro de 2025.

https://rafay.co/ai-and-cloud-native-blog/rethinking-gpu-allocation-in-kubernetes - ScaleOps. Kubernetes GPU Optimization for Real-Time AI Inference. ScaleOps Blog, dezembro de 2025.

https://scaleops.com/blog/ai-infra-for-production-why-gpu-resource-management-in-kubernetes-demands-a-new-approach/ - Cast AI. GPU Sharing in Kubernetes: How to Cut Costs and Boost GPU Utilization. Cast AI Blog, setembro de 2025.

https://cast.ai/blog/gpu-sharing-kubernetes-cost-optimization/ - Ajeetraina. Kubernetes and GPU: The Complete Guide to Running AI/ML Workloads at Scale. Blog pessoal, dezembro de 2025.

https://www.ajeetraina.com/kubernetes-and-gpu-the-complete-guide-to-running-ai-ml-workloads-at-scale/ - ClubMartech. Orquestração de Contêineres: Kubernetes, IA e Eficiência 2025. ClubMartech Blog, 2025.

https://clubmartech.com.br/blog/tecnologia-122/ - Ultralytics. O que é Edge AI? Benefícios, casos de uso e YOLO. Ultralytics Glossary, 2025.

https://www.ultralytics.com/pt/glossary/edge-ai - MinIO Blog. Deploying Models to Kubernetes with AIStor, MLflow and KServe. MinIO Blog, 2025.

https://blog.min.io/deploying-models-to-kubernetes-with-aistor-mlflow-and-kserve/