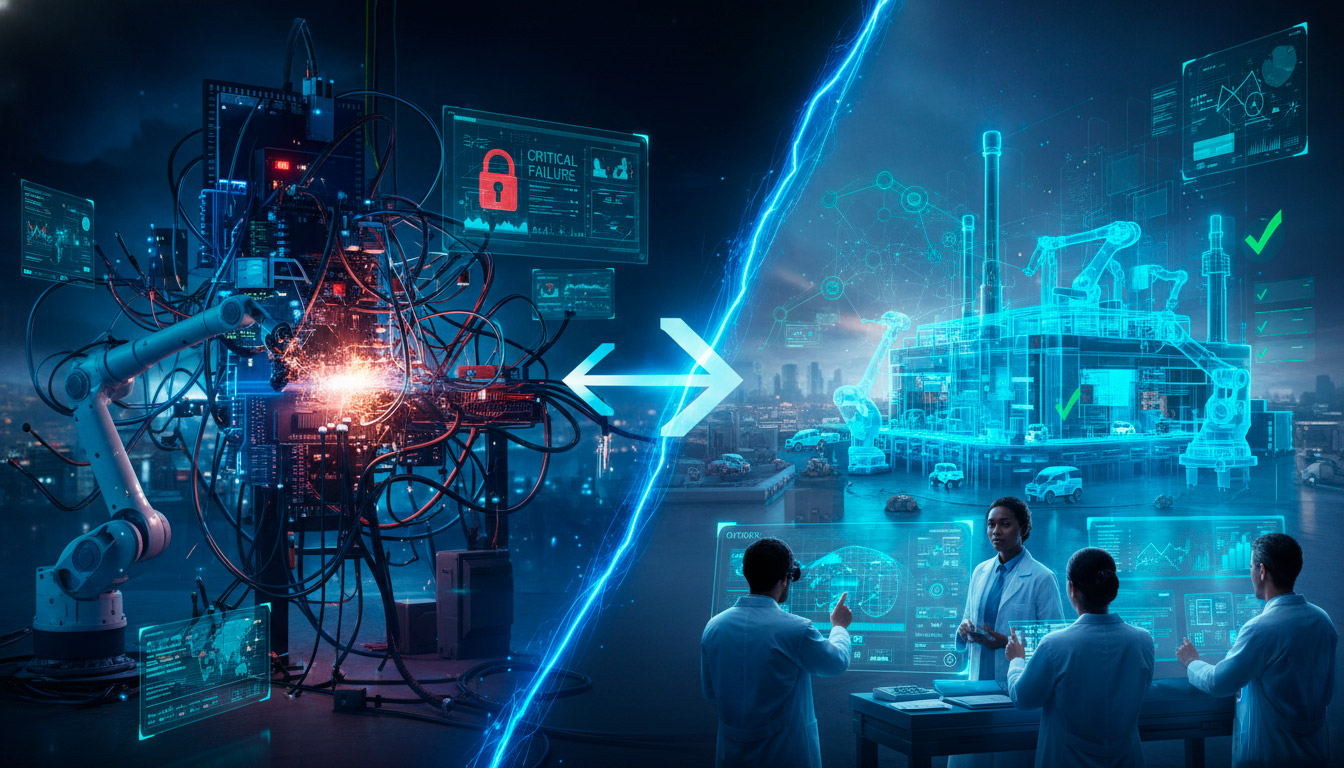

Um sistema de IA que funciona em laboratório pode falhar de forma crítica em produção. Não é exagero — é um padrão documentado repetidamente na literatura científica internacional. Este artigo mostra, com rigor acadêmico e linguagem direta, como a simulação computacional avançada e os Digital Twins emergiram como a resposta mais poderosa da engenharia a esse problema. Da NASA às fábricas da BMW, dos algoritmos de diagnóstico médico aos veículos autônomos da Waymo: testando primeiro no ambiente virtual, errando barato, implantando com confiança.

O paradoxo da IA no mundo real

Imagine que você é engenheiro-chefe de um hospital de grande porte. Após dois anos de desenvolvimento e um investimento de R$ 4 milhões, seu sistema de IA para auxílio ao diagnóstico oncológico está pronto. Os resultados no laboratório são deslumbrantes: 94% de acurácia, superando a média dos radiologistas humanos. No dia da implantação, há champanhe. Três meses depois, uma auditoria revela que o sistema falha sistematicamente em pacientes acima de 75 anos — precisamente a faixa etária com maior prevalência de câncer.

O que houve? O modelo nunca viu dados representativos dessa população durante o treinamento. Em laboratório, ele era brilhante. No mundo real, ele era perigoso.

Este não é um exemplo inventado para assustar. É a síntese de dezenas de incidentes documentados na literatura científica internacional. O padrão tem nome técnico: deployment gap — a lacuna entre o que um sistema de IA faz quando testado em ambiente controlado e o que ele faz quando implantado no mundo real.

A pergunta que paira sobre toda a indústria é simples e brutal: como você testa, com rigor científico, um sistema de IA antes de liberá-lo ao mundo?

A resposta mais poderosa emergiu de uma convergência inesperada entre engenharia aeroespacial, manufatura avançada e ciência da computação. Ela tem dois nomes: simulação computacional de alta fidelidade e, em sua forma mais sofisticada, Digital Twin.

A pesquisa publicada na Springer Nature — International Journal of Precision Engineering (2025) é direta: a integração de IA com Digital Twins “revolucionou a indústria ao permitir a criação de sistemas autônomos, adaptativos e resilientes que transcendem as réplicas digitais estáticas”. Não é promessa futurista. É infraestrutura operacional hoje.

Dado de contexto: Pesquisa bibliométrica publicada no PMC/NCBI registrou crescimento anual de 30,66% nas publicações sobre Digital Twins entre 2018 e 2024, com pico de 233 artigos apenas em 2023. O tema saiu do nicho para o mainstream científico em menos de uma década.

Que é um digital Twin, de verdade

É tentador tratar Digital Twin como sinônimo de simulação. É um erro que vai custar caro se você o cometer numa decisão de arquitetura. A diferença entre os dois conceitos define tudo.

A história começa na NASA

Em 2002, o Dr. Michael Grieves, do Florida Institute of Technology, articulou pela primeira vez o conceito em um workshop sobre Product Lifecycle Management. A ideia era elegante: criar um espelho digital de um produto físico que co-evoluísse com seu gêmeo real ao longo de toda sua vida útil.

Uma década depois, em 2012, os engenheiros Edward Glaessgen e David Stargel publicaram o paper seminal que mudou tudo: “The Digital Twin Paradigm for Future NASA and U.S. Air Force Vehicles”. A premissa era poderosa — por que esperar uma falha catastrófica numa aeronave quando é possível simulá-la virtualmente primeiro?

Com a Indústria 4.0, o conceito se expandiu exponencialmente. Sensores IoT, computação em nuvem, machine learning e poder de processamento massivamente paralelo transformaram Digital Twins de protótipos conceituais em infraestruturas operacionais em tempo real.

Linha do tempo do conceito

- 2002 — Dr. Michael Grieves (Florida Tech): Primeira articulação formal do Digital Twin no contexto de gerenciamento do ciclo de vida de produtos.

- 2012 — NASA e U.S. Air Force: Paper de Glaessgen e Stargel estabelece o DT como estratégia central de manutenção preditiva para aeronaves e espaçonaves.

- 2018–2020 — Indústria 4.0: IoT, cloud e machine learning transformam Digital Twins de conceito acadêmico em infraestrutura industrial operacional.

- 2024–2025 — IA + DT: Digital Twins tornam-se o ambiente de teste preferido para validação de sistemas de IA antes de implantação em ambientes críticos.

Simulação clássica vs. Digital Twin: a distinção que muda tudo

A simulação clássica — modelos de elementos finitos, simulações Monte Carlo, ambientes de teste de software — opera com modelos matemáticos estáticos. Você define parâmetros, roda o modelo, analisa os resultados. O modelo não aprende. Não se atualiza. Não “envelhece” junto com o sistema que representa. É uma fotografia.

O Digital Twin, em contraste, é dinâmico, bidirecional e auto-atualizante. Ele recebe dados contínuos do sistema físico via sensores IoT, atualiza seu estado interno em tempo real, executa análises preditivas e, em versões avançadas, envia comandos de volta ao sistema real. É uma relação simbiótica — não uma fotografia, mas um espelho vivo.

Analogia prática: Uma simulação clássica é como um mapa impresso: preciso no momento em que foi desenhado, mas estático. Se uma rua muda, o mapa não sabe. Um Digital Twin é como um GPS em tempo real: recebe dados contínuos de tráfego, recalcula rotas, aprende com padrões históricos e sincroniza com o mundo físico a cada segundo. A mesma diferença existe entre testar IA com datasets históricos e testá-la dentro de um Digital Twin que espelha o ambiente de produção ao vivo.

Os seis componentes essenciais de um Digital Twin para IA

O survey publicado no arXiv por Liu e David (2025), analisando 22 estudos primários, identificou a estrutura de referência de um Digital Twin funcional para validação de IA:

- Modelo Físico de Alta Fidelidade: Representação computacional do ambiente — física de corpos rígidos, dinâmica de fluidos, comportamento humano simulado.

- Camada de Sincronização em Tempo Real: Interface bidirecional com sensores do sistema físico, mantendo o gêmeo atualizado com latência mínima.

- Motor de Inferência de IA: O sistema em teste rodando dentro do ambiente simulado, tomando decisões e recebendo feedback.

- Sistema de Injeção de Falhas: Capacidade de introduzir cenários anômalos, edge cases e condições adversariais de forma controlada e repetível.

- Camada de Observabilidade Total: Instrumentação completa de todas as variáveis — muito além do possível num ambiente físico real.

- Loop de Aprendizado Contínuo: As descobertas no ambiente simulado alimentam o retreinamento e refinamento do modelo de IA.

Por que os projetos de IA falham

Uma parcela significativa dos modelos de IA que funcionam em laboratório nunca chegam à produção — ou falham nos primeiros meses após implantação. Não é problema de algoritmo. É problema de mundo real.

O cemitério dos modelos perfeitos

A literatura científica chama esse fenômeno por vários nomes técnicos: distribution shift (deriva de distribuição), concept drift (deriva de conceito), domain gap (lacuna de domínio). Todos descrevem a mesma verdade fundamental: os dados do mundo real são mais complexos, mais ruidosos e mais imprevisíveis do que qualquer dataset de treinamento pode capturar.

A pesquisa da Springer Nature — Discover Artificial Intelligence (2024) documentou um caso paradigmático: um sistema de controle de climatização baseado em IA prometia 14% de economia de energia nas simulações. Na implantação real, encontrou três problemas que nenhuma simulação havia previsto: incompatibilidade com sistemas de gerenciamento predial legados, o “problema da caixa-preta” que impediu os operadores de confiar nas decisões do sistema, e necessidade de retreinamento contínuo a custo operacional proibitivo.

Os seis vetores de falha mais documentados

- Deriva de Distribuição (Distribution Shift): O ambiente real apresenta padrões estatísticos diferentes do conjunto de treinamento. Um detector de fraudes treinado com dados de 2022 pode falhar com padrões de fraude emergentes em 2024.

- Edge Cases e Cenários Raros: Situações incomuns que o modelo nunca encontrou durante o treinamento. Uma IA de diagnóstico pode falhar em pacientes com múltiplas comorbidades raras — precisamente os casos mais graves e urgentes.

- Integração com Sistemas Legados: A IA precisa interagir com infraestruturas pré-existentes que não foram projetadas para esse tipo de integração, gerando incompatibilidades imprevisíveis.

- Falta de Interpretabilidade e Confiança: Operadores recusam-se a confiar em sistemas cujas decisões não conseguem entender, gerando resistência à adoção ou uso incorreto.

- Vieses Latentes: Discriminações sistemáticas embutidas nos dados de treinamento que só se manifestam em produção, quando o sistema encontra populações sub-representadas.

- Ataques Adversariais: Vulnerabilidades a inputs maliciosamente construídos para enganar o modelo — críticos em aplicações de segurança, saúde e finanças.

O custo real: Modelos de crédito com vieses não detectados perpetuaram discriminações raciais em decisões de empréstimo nos EUA, resultando em processos judiciais e danos reputacionais bilionários. Sistemas de triagem médica demonstraram desempenho radicalmente diferente entre populações étnicas distintas. Em ambos os casos, a causa raiz foi a mesma: falta de validação sistemática em ambientes que replicassem a diversidade do mundo real.

O termo informal que circula entre engenheiros de IA é preciso na sua brutalidade: “deploy and pray” — implantar e rezar. Essa é a alternativa à simulação rigorosa. E o custo dessa oração, quando ela não é atendida, é pago por usuários reais, com consequências reais.

Simulação como solução técnica

Não existe uma única “simulação”. Existe um espectro contínuo de abordagens, cada uma com seus trade-offs entre custo computacional, fidelidade e aplicabilidade. Entender onde cada abordagem brilha é tão importante quanto a decisão de simular.

Nível 1 — Ambientes virtuais tridimensionais

Mundos digitais tridimensionais, construídos sobre motores como Unreal Engine ou Unity, permitem testar sistemas de IA em cenários fotorrealistas antes de qualquer contato com hardware físico. A Waymo realizou mais de 20 bilhões de milhas de teste em simulação — uma escala impossível de alcançar em testes reais. Cada quilômetro simulado custa uma fração de centavo; cada quilômetro real custa dezenas de dólares e carrega riscos de segurança.

Nível 2 — Síntese de dados e ambientes generativos

Uma das fronteiras mais ativas da pesquisa atual é usar IA Generativa para ampliar o espaço de cenários de teste. Como documentado no Frontiers in Artificial Intelligence (2025): “a IA Generativa pode efetivamente simular cenários de manufatura para testar e validar modelos preditivos sem interromper operações no mundo real”.

Isso resolve um paradoxo fundamental: você precisa de dados raros para treinar o modelo a lidar com situações raras — mas, por definição, dados raros são difíceis de coletar. A IA Generativa cria dados sintéticos estatisticamente fiéis ao domínio real, sem as limitações éticas ou logísticas da coleta real.

Nível 3 — Hardware-in-the-Loop (HIL)

Para sistemas embarcados e de controle em tempo real, as arquiteturas HIL testam software de IA em conjunto com hardware real ou simulado de forma determinística, capturando tanto o comportamento computacional quanto as restrições físicas do sistema. É o método preferido para certificação de sistemas de IA em aviação e dispositivos médicos.

Exemplo prático: a falha que a simulação encontrou

A pesquisa publicada no Frontiers in Robotics and AI (2024) documenta um caso revelador: pesquisadores utilizaram simulação para testar um sistema de navegação de robôs móveis antes da implantação física. Durante o terceiro cenário de teste virtual, encontraram um problema crítico de configuração no navigation stack que havia passado despercebido por mais de um ano, apesar de estar em uso por múltiplos grupos de estudantes.

Custo de encontrar esse problema na simulação: algumas horas de processamento computacional. Custo de encontrá-lo no hardware real: danos físicos ao robô, potencial lesão a estudantes e meses de diagnóstico.

O framework de 3 fases

O paper da Springer Nature (2025) sobre integração IA-DT propõe um framework sistemático em três fases que se tornou referência metodológica no campo:

- Fase 1 — Virtualização e sincronização: Criação do modelo virtual com todos os parâmetros relevantes e estabelecimento do pipeline de sincronização bidirecional em tempo real.

- Fase 2 — Monitoramento e consciência situacional: O sistema de IA opera no ambiente virtual com telemetria completa de todas as suas decisões. Anomalias são detectadas e catalogadas antes que causem dano.

- Fase 3 — Injeção de falhas e otimização: Cenários adversariais, edge cases e falhas são introduzidos sistematicamente. O sistema aprende, e os insights alimentam ciclos de retreinamento.

Este framework representa uma mudança de paradigma: de “teste como etapa final” para teste como processo contínuo ao longo de todo o ciclo de vida do sistema de IA.

Os casos reais que mudam o jogo

Caso 1: Veículos Autônomos — o laboratório da complexidade

Nenhum domínio torna a necessidade de simulação mais óbvia do que o dos veículos autônomos. O espaço de estados possíveis numa via urbana — pedestres, ciclistas, clima variável, sinalizações danificadas, motoristas imprudentes — é literalmente infinito. Nenhuma empresa do mundo tem recursos para testar um veículo autônomo em cada combinação possível de cenários reais.

A Waymo opera o simulador Carcraft, capaz de rodar dezenas de milhares de veículos virtuais simultaneamente. A BMW utiliza a plataforma NATM (Natural Autonomous Testing Methodology), adotada também pelo Euro NCAP, que combina catálogos de cenários, simulações, testes em pista e testes no mundo real numa estratégia multicamadas de validação.

O mercado global de soluções de simulação para veículos autônomos foi avaliado em USD 1 bilhão em 2024, com projeção de crescimento a CAGR de 10,6% até 2034 (GM Insights, 2025). O crescimento é impulsionado não por modismo, mas por necessidade técnica e regulatória incontornável.

Caso 2: Saúde — quando errar não é opção

O setor de saúde apresenta o argumento mais convincente para a simulação: as consequências de uma falha não são financeiras — são humanas.

Pesquisa publicada no PMC/NCBI (2025) documenta o conceito de “ghost reader”: um novo sistema de IA opera em paralelo com o processo real de diagnóstico, sem interferir no atendimento, permitindo que seu desempenho seja avaliado em condições reais antes de qualquer decisão de implantação. O sistema observa cada caso clínico e faz sua inferência, mas não age. Médicos tomam as decisões reais. Ao final, a performance do sistema é avaliada em comparação com os diagnósticos confirmados — criando um dataset de validação de altíssima qualidade sem qualquer risco ao paciente.

A pesquisa do PMC / Society for Risk Analysis (2024) identificou o conceito de “inatenção simulatória” — a falha em usar simulação de forma sistemática para explorar, treinar e testar sistemas de IA em saúde. A conclusão dos pesquisadores: a simulação é central para o desenvolvimento seguro de IA médica. Não opcional. Central.

Caso 3: Manufatura — onde o conceito amadureceu

A manufatura é o setor onde Digital Twins atingiram maior maturidade operacional. Fábricas da Siemens, Bosch e BMW operam com gêmeos digitais de linhas de produção inteiras, testando novos algoritmos de controle de qualidade e sistemas de detecção de defeitos antes de qualquer implementação física.

O Frontiers in Artificial Intelligence (2025) documenta como sistemas de manufatura aditiva utilizam Digital Twins com machine learning para detecção de defeitos em tempo real. O modelo de IA é treinado e validado no Digital Twin. A linha de produção real só vê o sistema quando ele já foi aprovado no ambiente virtual.

Exemplo prático — Manufatura Aditiva: Uma fábrica de peças aeroespaciais precisa treinar seu sistema de detecção de defeitos para identificar microtrincas em ligas metálicas. Problema: microtrincas reais são raras — não há dados suficientes para treinar o modelo. Com IA Generativa integrada ao Digital Twin da linha de produção, a equipe gera 50.000 imagens sintéticas de alta fidelidade de peças com diferentes tipos, tamanhos e orientações de microtrincas. O modelo é treinado nesses dados sintéticos, validado no Digital Twin, e só então implantado. Resultado: acurácia de detecção 40% superior à do modelo anterior.

Caso 4: Cibersegurança — campo de batalha virtual

Pesquisa da International Conference on Intelligent Algorithms for Computational Intelligence Systems (2024) demonstra como Digital Twins integrados com Large Language Models e ferramentas de penetration testing criam ambientes de treinamento para sistemas de defesa cibernética. Em vez de testar defesas em produção — onde um ataque real tem consequências reais — cria-se um campo de batalha virtual onde sistemas de IA defensivos são expostos a ataques simulados de altíssima fidelidade. Falhas são encontradas, corrigidas e testadas novamente, tudo sem qualquer impacto em sistemas reais.

IA Generativa + Digital Twin: A convergência explosiva

Se o Digital Twin representou um salto qualitativo na capacidade de testar sistemas de IA, a chegada da IA Generativa criou uma sinergia de consequências ainda não totalmente mensuradas pela indústria.

A McKinsey, por meio de sua divisão QuantumBlack, publicou análise que resume a situação: “IA Generativa pode estruturar inputs e sintetizar outputs de Digital Twins, e Digital Twins podem fornecer um ambiente robusto de teste e aprendizado para IA Generativa.” A consultoria conclui que a combinação “produz sinergias que reduzem custos, aceleram a implantação e fornecem substancialmente mais valor do que qualquer uma poderia oferecer isoladamente”.

O que essa convergência torna possível

- Geração automática de cenários de teste: LLMs descrevem cenários adversariais em linguagem natural; IA Generativa os converte em ambientes simulados concretos dentro do Digital Twin. O que antes levava semanas de engenharia agora leva horas.

- Síntese de dados dirigida por hipóteses: Em vez de gerar dados aleatórios, a IA Generativa cria dados sintéticos direcionados especificamente a cobrir gaps identificados no dataset de treinamento.

- Explicabilidade aumentada: LLMs auxiliam na interpretação das decisões do sistema de IA sendo testado, tornando o processo de auditoria acessível a stakeholders não técnicos.

- Digital Twin autoadaptativo: O gêmeo digital não apenas recebe dados do sistema físico — ele aprende com insights gerados pela IA Generativa, criando um loop de melhoria contínua.

O survey de Liu e David (arXiv, 2025) destaca que “volume e qualidade insuficientes de dados são desafios particularmente prementes na adoção de IA moderna” — e que Digital Twins com capacidades generativas abrem novos caminhos para superar essa limitação fundamental.

Os desafios que ninguém conta

Um artigo honesto não celebra apenas os sucessos. Os desafios desta tecnologia são reais, documentados e ainda não completamente superados.

Desafio 1: A lacuna Sim-to-Real

Todo Digital Twin é necessariamente uma simplificação da realidade. A questão não é se existem simplificações — é se as simplificações feitas comprometem a validade das conclusões. Um modelo que ignora determinadas condições climáticas pode declarar um sistema de IA “aprovado” quando ele, na verdade, falha sob chuva intensa ou temperatura extrema.

A pesquisa do Frontiers in Robotics and AI (2024) sintetiza o dilema: “simulação e mundo real têm propriedades complementares — e nenhuma das duas é suficiente isoladamente”. Técnicas como Domain Randomization, Adaptive Sim-to-Real Transfer e modelos de calibração bayesiana estão mitigando esse problema, mas não o eliminam completamente.

Desafio 2: O custo de entrada

Construir um Digital Twin de alta fidelidade requer engenharia especializada, infraestrutura computacional robusta (frequentemente GPUs de alto desempenho) e expertise de domínio para validar que o modelo representa adequadamente a realidade. Para organizações menores, esse custo pode ser proibitivo. A tendência de democratização via cloud — com plataformas como NVIDIA Omniverse, Microsoft Azure Digital Twins e AWS IoT TwinMaker — está reduzindo o custo de entrada de forma progressiva.

Desafio 3: Privacidade e degurança dos dados

Digital Twins frequentemente requerem dados sensíveis para calibração: registros médicos, dados operacionais proprietários, informações de infraestrutura crítica. Isso cria tensões com regulações de privacidade como a LGPD no Brasil e o GDPR na Europa. Técnicas como Federated Learning e privacidade diferencial estão sendo integradas a arquiteturas de Digital Twin, mas ainda representam fronteira de pesquisa, não solução completamente madura.

Desafio 4: O paradoxo da validação circular

Se você usa o Digital Twin para validar o sistema de IA, quem valida o Digital Twin? Este problema de validação circular exige que as organizações mantenham programas paralelos de validação que comparam periodicamente o comportamento do gêmeo digital com observações do sistema físico real. Confiar cegamente no modelo virtual sem calibração contínua é substituir um risco por outro.

Perspectiva regulatória: O EU AI Act, em vigor desde agosto de 2024, estabelece que sistemas de IA de alto risco devem cumprir requisitos de gestão de risco, governança de dados, documentação técnica, transparência, supervisão humana e robustez. Simulação e Digital Twins emergem como ferramentas essenciais para demonstrar conformidade — transformando-se de vantagem competitiva em obrigação regulatória para qualquer empresa que opere no mercado europeu.

Framework prático de implementação

Para organizações que desenvolvem ou implantam sistemas de IA, o seguinte framework de implementação progressiva em cinco etapas é construído sobre as melhores práticas documentadas na literatura científica.

- Mapeamento de riscos e cenários críticos: Antes de construir qualquer simulação, identifique sistematicamente os cenários de falha mais perigosos no domínio de aplicação. Use análise FMEA (Failure Mode and Effects Analysis) e workshops com especialistas de domínio para criar um catálogo de cenários prioritários. Pergunta central: o que pode dar errado, e qual é o custo se der?

- Seleção da fidelidade apropriada: Nem todo teste requer um Digital Twin completo. Determine o nível de fidelidade necessário para cada categoria de risco. Uma simulação de dados pode ser suficiente para testar deriva de distribuição; um DT físico completo pode ser necessário para testar comportamento de robôs. Dimensione o investimento de acordo com o risco.

- Construção e calibração do modelo virtual: Desenvolva o modelo virtual, calibre-o contra dados do sistema físico real e estabeleça métricas de validação da própria simulação. Esta etapa é frequentemente subestimada. Um Digital Twin mal calibrado é mais perigoso que nenhum Digital Twin.

- Campanha de testes sistemática: Execute testes cobrindo três categorias: cenários normais (para validar performance baseline), cenários adversariais (para identificar pontos de falha) e cenários de transição (para validar comportamento sob mudanças graduais de condição). Documente tudo com rastreabilidade completa — regulações futuras vão exigir isso.

- Loop contínuo de melhoria: Estabeleça um processo permanente de atualização do Digital Twin com dados do sistema físico em produção, retreinamento do modelo com insights da simulação e expansão contínua do catálogo de cenários de teste. O Digital Twin não é uma etapa — é uma infraestrutura permanente.

O horizonte: Para onde isso vai

Digital Twins de segunda geração: autônomos e auto-evolutivos

A próxima fronteira é o Digital Twin que não apenas espelha a realidade, mas a antecipa. Combinando simulação física avançada com modelos de IA capazes de raciocínio causal, esses gêmeos de segunda geração identificam automaticamente cenários de maior risco, geram testes direcionados a vulnerabilidades e propõem modificações ao sistema de IA original — criando um ciclo de melhoria quase autônomo.

Democratização pelo Cloud

NVIDIA Omniverse, Microsoft Azure Digital Twins e AWS IoT TwinMaker já estão criando ecossistemas que permitem a organizações de médio porte acessar capacidades antes reservadas a grandes corporações. À medida que Simulation-as-a-Service amadurece, o custo de entrada continuará caindo, tornando esta abordagem acessível mesmo para startups com projetos de IA críticos.

Padronização e certificação global

A pesquisa da Springer (2025) destaca “a necessidade urgente de padrões globais e arquiteturas escaláveis” para Digital Twins habilitados por IA. ISO, IEEE e órgãos regulatórios setoriais estão trabalhando nessa direção. Nos próximos anos, espera-se um framework de certificação robusto para sistemas de IA validados por Digital Twin — o que tornará essa abordagem não apenas uma boa prática, mas um requisito formal de conformidade.

Metaverso industrial e simulação imersiva

Interfaces de realidade aumentada e virtual estão sendo integradas a Digital Twins, criando ambientes imersivos onde engenheiros podem “entrar” no modelo e interagir com ele de forma intuitiva. Estudos sobre interseções inteligentes documentam “dashboards gamificados de VR e interfaces metaverso” que democratizam o acesso de stakeholders não técnicos ao processo de validação — permitindo que gestores, reguladores e usuários finais participem da revisão do comportamento do sistema.

A ética de simular

Há uma dimensão frequentemente ignorada no debate sobre validação de IA: a dimensão ética. Implantar um sistema de IA sem validação adequada não é apenas uma decisão técnica irresponsável. É uma escolha ética. É a escolha de transferir o risco do laboratório controlado para o mundo real — onde pessoas reais pagam o preço das falhas.

A tecnologia de simulação e Digital Twin representa, em seu núcleo, uma escolha ética diferente: a escolha de absorver o custo da incerteza antes de transferi-lo ao mundo. É a escolha de errar virtualmente em vez de errar realmente. É a escolha de aprender com falhas simuladas em vez de aprender com falhas humanas.

O campo ainda tem desafios substanciais: a lacuna sim-to-real, o custo de implementação, os problemas de privacidade e os desafios de escalabilidade são reais e não devem ser minimizados. Mas a trajetória é clara e irreversível.

Em 2025, Digital Twins e simulação de alta fidelidade deixaram definitivamente de ser ferramentas opcionais de vanguarda para se tornarem infraestrutura essencial de qualquer programa de IA responsável. A pergunta que cada organização que desenvolve ou implanta sistemas de IA precisará responder não será mais “por que usar simulação?” — será “como justificar não usar?”.

E a resposta honesta, à luz da evidência acadêmica e dos casos reais documentados neste artigo, é que não há justificativa aceitável. O gêmeo digital não é o futuro da IA responsável. É o presente.

Síntese final: Simulação avançada e Digital Twins representam a fronteira mais importante da governança responsável de IA. Com crescimento de publicações de 30,66% ao ano, mercado avaliado em USD 1 bilhão e respaldo de frameworks regulatórios como o EU AI Act, essas tecnologias transitaram de opcional para essencial. Organizações que ainda não as incorporaram ao seu processo de desenvolvimento estão, silenciosamente, acumulando riscos que um dia se materializarão em falhas reais — com consequências reais.

Fontes

- Liu, X.; David, I. (2025). AI Simulation by Digital Twins: Systematic Survey. arXiv preprint arXiv:2506.06580. Disponível em: https://arxiv.org/abs/2506.06580

- Springer Nature (2025). AI-Enabled Digital Twin Integration in Industry 4.0 and 5.0. International Journal of Precision Engineering and Manufacturing-Green Technology. DOI: 10.1007/s40684-025-00750-z

- Glaessgen, E.; Stargel, D. (2012). The Digital Twin Paradigm for Future NASA and U.S. Air Force Vehicles. 53rd AIAA/ASME/ASCE/AHS/ASC Structures, Structural Dynamics and Materials Conference.

- Grieves, M.; Vickers, J. (2017). Digital Twin: Mitigating Unpredictable, Undesirable Emergent Behavior in Complex Systems. Transdisciplinary Perspectives on Complex Systems. Springer. pp. 85–113.

- PMC/NCBI (2025). A Technological Review of Digital Twins and Artificial Intelligence for Personalized and Predictive Healthcare. Disponível em: https://pmc.ncbi.nlm.nih.gov/articles/PMC12294331/

- Springer Nature — Discover AI (2024). Challenges with Developing and Deploying AI Models in Industrial Systems. DOI: 10.1007/s44163-024-00151-2

- PMC / Society for Risk Analysis (2024). Managing Risk and Resilience in Autonomous and Intelligent Systems: Safety in AI Healthcare. Risk Analysis. Disponível em: https://pmc.ncbi.nlm.nih.gov/articles/PMC12032380/

- Frontiers in Robotics and AI (2024). Composable and Executable Scenarios for Simulation-Based Testing of Mobile Robots. Vol. 11. DOI: 10.3389/frobt.2024.1363281

- Frontiers in Artificial Intelligence (2025). Generative and Predictive AI for Digital Twin Systems in Manufacturing. DOI: 10.3389/frai.2025.1655470

- McKinsey / QuantumBlack (2024). Digital Twins and Generative AI: A Powerful Pairing. Disponível em: https://www.mckinsey.com/capabilities/tech-and-ai/our-insights/tech-forward/digital-twins-and-generative-ai-a-powerful-pairing

- arXiv (2025). Digital Twins for Intelligent Intersections: A Literature Review. arXiv:2510.05374.

- IACIS (2024). Enabling Cyber Security Education through Digital Twins and Generative AI. DOI: 10.1109/IACIS61494.2024.10721892

- Springer Nature (2024). Testing Autonomous Vehicles and AI: Cybersecurity, Transparency, Robustness and Fairness. European Transport Research Review. DOI: 10.1186/s12544-025-00732-x

- GM Insights (2025). Autonomous Vehicle Simulation Solutions Market Report, 2034. Disponível em: https://www.gminsights.com

- MulticoreWare (2024). The Validation Conundrum: Challenges and Advancements in Testing Autonomous Vehicles. Disponível em: https://multicorewareinc.com

- Scientific Reports / Nature (2026). Digital Twin-Based Intelligent Risk Assessment and Decision Support System. DOI: 10.1038/s41598-026-36111-2

- European Parliament (2024). EU Artificial Intelligence Act. Vigência: agosto de 2024. Official Journal of the European Union.

- Jyeniskhan, N. et al. (2025). Digital Twin System for Additive Manufacturing with ML for Real-Time Defect Detection. Springer Nature — IJPEM-GT. DOI: 10.1007/s40684-025-00750-z

- arXiv (2024). AI Risk Categorization Decoded (AIR 2024): From Government Regulations to Corporate Policies. arXiv:2406.17864.

- Grewal et al. (2024). Predicting Safety Misbehaviours in Autonomous Driving Systems Using Uncertainty Quantification. IEEE ICST 2024.

- cal-tek.eu / EMSS (2024). Artificial Intelligence and Digital Twin for Effective Risk Management in an Experimental Plant. Proceedings of I3M/EMSS 2024.

- Powertechjournal (2025). Cooperative AI Agents for Fully Autonomous Deployment Pipelines. International Journal of Engineering Research and Science.